%EC%B9%B4%EB%A9%94%EB%9D%BC

-

초당 9,120프레임 포착 곤충눈 모사 카메라 개발

곤충의 겹눈은 빠르게 움직이는 물체를 병렬적으로 감지하고, 어두운 환경에서는 감도를 높이기 위해 시각세포가 여러 시간의 신호를 합쳐서 반응해 움직임을 결정한다. KAIST 연구진이 곤충의 생체를 모사하여 기존 고속 카메라가 직면했던 프레임 속도와 감도 간의 한계를 극복한 저비용 고속 카메라를 개발하는데 성공했다.

우리 대학 바이오및뇌공학과 정기훈·전산학과 김민혁 교수 연구팀이 곤충의 시각 구조에서 영감을 받아 초고속 촬영과 고감도를 동시에 구현한 새로운 생체모사 카메라를 개발했다고 16일 밝혔다.

고속 및 저조도 환경에서의 고품질 이미징은 많은 응용 분야에서 중요한 과제이다. 기존의 고속 카메라는 빠른 움직임을 포착하는 데 강점을 가지고 있지만, 프레임율을 높일수록 빛을 수집할 수 있는 시간이 줄어들어 저조도 환경에서는 감도가 부족한 문제가 발생해왔다.

이를 해결하기 위해 연구팀은 곤충의 시각 기관처럼, 여러 개의 광학 채널과 시간 합산을 활용하는 방식을 채택했다. 기존 단안 카메라 시스템과 달리, 생체 모사 카메라는 겹눈을 통해 서로 다른 시간대의 프레임을 병렬적으로 획득할 수 있다.

이 과정에서 각 프레임이 중첩되는 시간 동안 빛을 합산함으로써 신호대잡음비를 증가시킬 수 있다. 연구팀은 이러한 방식을 적용한 생체 모사 카메라가 기존의 고속 카메라 대비 최대 40배 더 어두운 물체까지 포착할 수 있었다고 밝혔다.

또한 연구팀은 카메라의 속도를 크게 향상하기 위해 ‘채널 분할’ 기술을 도입하여 패키징에 사용된 이미지센서보다 수천 배 빠른 프레임률을 획득할 수 있었다. 이에 더해 ‘압축 이미지 복원’ 알고리즘을 활용해 합산된 프레임에서 발생할 수 있는 흐림 현상을 제거하며, 선명한 이미지를 재구성했다.

연구팀은 제작된 생체 모사 카메라는 두께 1mm 이하의 매우 얇고, 작은 크기에도 불구하고 초당 9,120프레임을 촬영할 수 있고, 낮은 조도에서도 선명한 이미지를 제공한다.

향후 연구팀은 3D 이미징 및 초해상도 이미징을 위한 고급 이미지 처리 알고리즘을 통해 바이오의료 응용뿐 아니라 모바일 등 다양한 카메라 응용 기술을 개발할 예정이라고 밝혔다.

제1 저자인 바이오및뇌공학과 김현경 박사과정은 “제작된 곤충 눈 카메라가 작은 크기임에도 불구하고 고속 및 저조도 촬영에서 뛰어난 성능을 발휘하는 것을 실험적으로 검증했다”라며, “이 카메라는 이동식 카메라 시스템, 보안 감시, 의료 영상 등 다양한 분야에서의 응용 가능성을 열었다”라고 말했다.

바이오및뇌공학과 김현경 박사과정이 제1 저자로 참여한 이번 연구는 국제 학술지 `사이언스 어드밴시스(Science Advances)'에 1월 출판됐다. (논문명 : Biologically-inspired microlens array camera for high-speed and high-sensitivity imaging)

DOI: https://doi.org/10.1126/sciadv.ads3389

한편 이번 연구는 국방기술진흥연구소, 과학기술정보통신부, 그리고 산업통상자원부의 지원을 받아 수행됐다.

2025.01.16 조회수 4603

초당 9,120프레임 포착 곤충눈 모사 카메라 개발

곤충의 겹눈은 빠르게 움직이는 물체를 병렬적으로 감지하고, 어두운 환경에서는 감도를 높이기 위해 시각세포가 여러 시간의 신호를 합쳐서 반응해 움직임을 결정한다. KAIST 연구진이 곤충의 생체를 모사하여 기존 고속 카메라가 직면했던 프레임 속도와 감도 간의 한계를 극복한 저비용 고속 카메라를 개발하는데 성공했다.

우리 대학 바이오및뇌공학과 정기훈·전산학과 김민혁 교수 연구팀이 곤충의 시각 구조에서 영감을 받아 초고속 촬영과 고감도를 동시에 구현한 새로운 생체모사 카메라를 개발했다고 16일 밝혔다.

고속 및 저조도 환경에서의 고품질 이미징은 많은 응용 분야에서 중요한 과제이다. 기존의 고속 카메라는 빠른 움직임을 포착하는 데 강점을 가지고 있지만, 프레임율을 높일수록 빛을 수집할 수 있는 시간이 줄어들어 저조도 환경에서는 감도가 부족한 문제가 발생해왔다.

이를 해결하기 위해 연구팀은 곤충의 시각 기관처럼, 여러 개의 광학 채널과 시간 합산을 활용하는 방식을 채택했다. 기존 단안 카메라 시스템과 달리, 생체 모사 카메라는 겹눈을 통해 서로 다른 시간대의 프레임을 병렬적으로 획득할 수 있다.

이 과정에서 각 프레임이 중첩되는 시간 동안 빛을 합산함으로써 신호대잡음비를 증가시킬 수 있다. 연구팀은 이러한 방식을 적용한 생체 모사 카메라가 기존의 고속 카메라 대비 최대 40배 더 어두운 물체까지 포착할 수 있었다고 밝혔다.

또한 연구팀은 카메라의 속도를 크게 향상하기 위해 ‘채널 분할’ 기술을 도입하여 패키징에 사용된 이미지센서보다 수천 배 빠른 프레임률을 획득할 수 있었다. 이에 더해 ‘압축 이미지 복원’ 알고리즘을 활용해 합산된 프레임에서 발생할 수 있는 흐림 현상을 제거하며, 선명한 이미지를 재구성했다.

연구팀은 제작된 생체 모사 카메라는 두께 1mm 이하의 매우 얇고, 작은 크기에도 불구하고 초당 9,120프레임을 촬영할 수 있고, 낮은 조도에서도 선명한 이미지를 제공한다.

향후 연구팀은 3D 이미징 및 초해상도 이미징을 위한 고급 이미지 처리 알고리즘을 통해 바이오의료 응용뿐 아니라 모바일 등 다양한 카메라 응용 기술을 개발할 예정이라고 밝혔다.

제1 저자인 바이오및뇌공학과 김현경 박사과정은 “제작된 곤충 눈 카메라가 작은 크기임에도 불구하고 고속 및 저조도 촬영에서 뛰어난 성능을 발휘하는 것을 실험적으로 검증했다”라며, “이 카메라는 이동식 카메라 시스템, 보안 감시, 의료 영상 등 다양한 분야에서의 응용 가능성을 열었다”라고 말했다.

바이오및뇌공학과 김현경 박사과정이 제1 저자로 참여한 이번 연구는 국제 학술지 `사이언스 어드밴시스(Science Advances)'에 1월 출판됐다. (논문명 : Biologically-inspired microlens array camera for high-speed and high-sensitivity imaging)

DOI: https://doi.org/10.1126/sciadv.ads3389

한편 이번 연구는 국방기술진흥연구소, 과학기술정보통신부, 그리고 산업통상자원부의 지원을 받아 수행됐다.

2025.01.16 조회수 4603 -

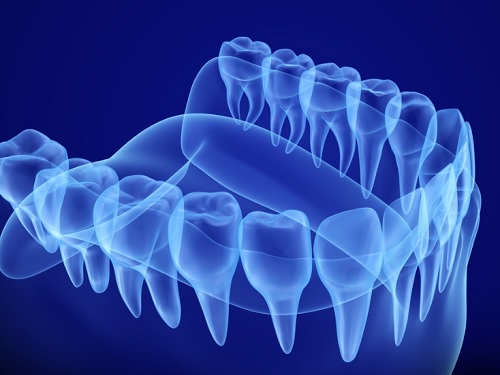

3차원 구강 스캐닝을 휴대용 카메라로?

치과 치료를 위해 치아 및 구상조직 형태의 석고 등으로 모형을 만드는 인상채득(Impression)을 디지털 방식으로 간편하게 수행할 수 있는 3D 구강 스캐너가 최근 주목받고 있다.

우리 대학 바이오및뇌공학과 정기훈 교수 연구팀이 3차원 구강 스캐닝에 적합한 휴대형 라이트필드 카메라를 개발하는 데 성공했다고 6일 밝혔다.

기존 구강 스캐너는 큰 크기와 낮은 정확도로 인해 여전히 사용 빈도가 낮아, 적용 범위를 넓히고 실용적인 사용을 위해서는 소형화와 손움직임에 의한 동작 잡음 개선 등이 필요한 상황이다.

이미지 센서의 픽셀에 도달하는 빛의 세기만을 기록하는 일반적인 카메라와 달리 라이트필드 카메라 (light-field camera)는 *마이크로렌즈 어레이를 이미지센서 앞에 배치하여 들어오는 빛의 방향을 구분한다. 따라서, 한 번의 촬영으로 3차원 광학이미지를 획득할 수 있을 뿐만 아니라 간단한 구조를 가지기 때문에 초소형 제작이 가능하다.

☞ 마이크로렌즈 어레이(microlens arrays): 수십에서 수백 마이크로미터 정도 직경의 미세렌즈를 배열하여 만든 광학 소자

연구팀은 3차원 구강 스캐닝을 위해 주 렌즈, 고체 잠입 마이크로렌즈 어레이, 이미지센서 등을 이용한 동작잡음이 없는 초소형 고심도 라이트필드 카메라 (deep focus light-field camera)를 설계·제작했다. 핵심아이디어는 저굴절률의 고분자 코팅을 통해 마이크로렌즈의 초점거리를 향상한 고체 잠입 마이크로렌즈다. 제작된 라이트필드 카메라는 피사계 심도가 높아, 손떨림에도 둔감하고, 한 번 촬영으로 더 많은 3차원 영상정보를 쉽게 획득할 수 있다.

연구팀은 설계한 라이트필드 카메라 기반의 구강 스캐너를 이용한 휴대 촬영을 통해 손동작 잡음 없이 구강 모형의 3차원 재구성 영상 획득에 성공했다. 특히, 큰 피사계 심도를 가져 쉬운 휴대 작동이 가능하고 고대비 이미지를 획득해 높은 3차원 재구성 정확도를 보인다. 이를 통해 기존 구강 스캐너에서 주로 쓰이는 복잡한 광학계가 아닌 소형화에 적합한 간단한 구조의 라이트필드 카메라를 이용해 높은 정확도의 3차원 구강 스캐닝이 가능함을 연구팀은 확인했다.

정기훈 교수는 “연구팀이 개발한 라이트필드 카메라는 구강 스캐닝 뿐만 아니라 생체 내 3차원 이미징을 위한 새로운 플랫폼으로 활용될 수 있을 것으로 기대된다”며 “내시경, 현미경 등의 다양한 바이오·의료분야는 물론 3차원 산업용 검사장비에 활용하게 될 것”이라고 연구의 의미를 설명했다.

우리 대학 바이오및뇌공학과 권재명 박사과정 학생이 주도한 이번 연구 결과는 국제 학술지 `에이피엘 바이오엔지니어링(APL Bioengineering)'에 최근 게재됐다. (논문명: Deep focus light-field camera for handheld 3D intraoral scanning using crosstalk-free solid immersion microlens arrays).

한편 이번 연구는 과학기술정보통신부 및 ㈜바텍의 지원을 받아 수행되었고, ㈜마이크로픽스 (연구실 창업)을 통해 기술사업화를 진행 중이다.

2023.09.06 조회수 6800

3차원 구강 스캐닝을 휴대용 카메라로?

치과 치료를 위해 치아 및 구상조직 형태의 석고 등으로 모형을 만드는 인상채득(Impression)을 디지털 방식으로 간편하게 수행할 수 있는 3D 구강 스캐너가 최근 주목받고 있다.

우리 대학 바이오및뇌공학과 정기훈 교수 연구팀이 3차원 구강 스캐닝에 적합한 휴대형 라이트필드 카메라를 개발하는 데 성공했다고 6일 밝혔다.

기존 구강 스캐너는 큰 크기와 낮은 정확도로 인해 여전히 사용 빈도가 낮아, 적용 범위를 넓히고 실용적인 사용을 위해서는 소형화와 손움직임에 의한 동작 잡음 개선 등이 필요한 상황이다.

이미지 센서의 픽셀에 도달하는 빛의 세기만을 기록하는 일반적인 카메라와 달리 라이트필드 카메라 (light-field camera)는 *마이크로렌즈 어레이를 이미지센서 앞에 배치하여 들어오는 빛의 방향을 구분한다. 따라서, 한 번의 촬영으로 3차원 광학이미지를 획득할 수 있을 뿐만 아니라 간단한 구조를 가지기 때문에 초소형 제작이 가능하다.

☞ 마이크로렌즈 어레이(microlens arrays): 수십에서 수백 마이크로미터 정도 직경의 미세렌즈를 배열하여 만든 광학 소자

연구팀은 3차원 구강 스캐닝을 위해 주 렌즈, 고체 잠입 마이크로렌즈 어레이, 이미지센서 등을 이용한 동작잡음이 없는 초소형 고심도 라이트필드 카메라 (deep focus light-field camera)를 설계·제작했다. 핵심아이디어는 저굴절률의 고분자 코팅을 통해 마이크로렌즈의 초점거리를 향상한 고체 잠입 마이크로렌즈다. 제작된 라이트필드 카메라는 피사계 심도가 높아, 손떨림에도 둔감하고, 한 번 촬영으로 더 많은 3차원 영상정보를 쉽게 획득할 수 있다.

연구팀은 설계한 라이트필드 카메라 기반의 구강 스캐너를 이용한 휴대 촬영을 통해 손동작 잡음 없이 구강 모형의 3차원 재구성 영상 획득에 성공했다. 특히, 큰 피사계 심도를 가져 쉬운 휴대 작동이 가능하고 고대비 이미지를 획득해 높은 3차원 재구성 정확도를 보인다. 이를 통해 기존 구강 스캐너에서 주로 쓰이는 복잡한 광학계가 아닌 소형화에 적합한 간단한 구조의 라이트필드 카메라를 이용해 높은 정확도의 3차원 구강 스캐닝이 가능함을 연구팀은 확인했다.

정기훈 교수는 “연구팀이 개발한 라이트필드 카메라는 구강 스캐닝 뿐만 아니라 생체 내 3차원 이미징을 위한 새로운 플랫폼으로 활용될 수 있을 것으로 기대된다”며 “내시경, 현미경 등의 다양한 바이오·의료분야는 물론 3차원 산업용 검사장비에 활용하게 될 것”이라고 연구의 의미를 설명했다.

우리 대학 바이오및뇌공학과 권재명 박사과정 학생이 주도한 이번 연구 결과는 국제 학술지 `에이피엘 바이오엔지니어링(APL Bioengineering)'에 최근 게재됐다. (논문명: Deep focus light-field camera for handheld 3D intraoral scanning using crosstalk-free solid immersion microlens arrays).

한편 이번 연구는 과학기술정보통신부 및 ㈜바텍의 지원을 받아 수행되었고, ㈜마이크로픽스 (연구실 창업)을 통해 기술사업화를 진행 중이다.

2023.09.06 조회수 6800 -

마스크 하나로 선명한 3D 홀로그래픽 센서 구현

일반카메라에 비해 홀로그래픽 카메라는 물체의 3D 정보를 획득하는 능력 덕분에 현실감 있는 영상을 제공한다. 하지만 기존 홀로그래픽 카메라 기술은 광파(光波)의 간섭 현상을 이용하여 빛의 파장·굴절률 등을 측정하는 장치인 간섭계를 사용하여 복잡하고 주변 환경에 민감한 단점이 있다.

우리 대학 물리학과 박용근 교수 연구팀이 3차원 홀로그래피 이미징 센서 기술의 새로운 도약을 이뤘다고 23일 발표했다.

연구팀은 복잡한 간섭계를 사용하지 않는 혁신적인 홀로그래피 카메라 기술을 발표했다. 이 기술은 마스크를 이용해 빛의 위상 정보를 정밀하게 측정하며, 이에 따라 물체의 3D 정보를 더욱 정확하게 재구성할 수 있다.

연구팀은 제시한 혁신적인 방법은 수학적으로 특정 조건을 만족하는 마스크를 일반 카메라에 추가하고, 이를 통해 측정한 레이저 산란광을 컴퓨터 상에서 분석하는 방식이다. 복잡한 간섭계가 필요하지 않고, 더욱 단순화된 광학 시스템을 통해 빛의 위상 정보를 효과적으로 획득한다. 이 기술에서는 물체 뒤 위치한 두 렌즈 사이의 특별한 마스크가 중요한 역할을 한다. 이 마스크는 빛의 특정 부분을 선별적으로 필터링하며, 렌즈를 통과하는 빛의 강도는 일반적인 상업용 카메라로 측정될 수 있다. 이 기술은 카메라로부터 받아온 이미지 데이터와 마스크의 독특한 패턴을 결합해, 알고리즘 처리를 통해 물체의 세밀한 3D 정보를 복원한다.

이러한 방식은 어떤 위치의 물체든 선명하게 3차원으로 촬영하는 능력을 갖추고 있다. 실제 구현을 위해서는, 일반적인 이미지 센서에 단순한 디자인의 마스크를 추가하는 것으로 레이저 홀로그래피 3D 이미지 센서 구현이 가능하다. 이에 따라 광학 시스템의 설계와 제작이 더욱 간편해진다. 특히 이 새로운 기술은 빠른 움직임의 물체에도 선명한 홀로그래픽 이미지 촬영이 가능해 활용 범위가 넓어질 것으로 예상된다.

물리학과 오정훈 박사가 제1 저자로 참여한 이 연구 결과는 국제적인 학술지 '네이처 커뮤니케이션즈 (Nature Communications)' 8월 12일 字에 출판됐다. (논문명: Non-interferometric stand-alone single-shot holographic camera using reciprocal diffractive imaging)

제1 저자인 물리학과 오정훈 박사는 “제안하는 홀로그래픽 카메라의 모듈은 일반 카메라에 필터를 추가하는 방식으로 구현될 수 있으므로, 실용화된다면 일상생활에서 비전문가가 손쉽게 사용할 수 있을 것이다”라며, “특히 기존의 원격 감지 기술들을 대체할 수 있다는 높은 잠재력을 가지고 있다”라고 말했다.

한편 이번 연구는 연구재단의 리더연구사업, 과학기술정보통신부의 홀로그램핵심기술지원사업, 나노 및 소재 기술개발사업의 지원을 받아 수행됐다.

2023.08.23 조회수 7949

마스크 하나로 선명한 3D 홀로그래픽 센서 구현

일반카메라에 비해 홀로그래픽 카메라는 물체의 3D 정보를 획득하는 능력 덕분에 현실감 있는 영상을 제공한다. 하지만 기존 홀로그래픽 카메라 기술은 광파(光波)의 간섭 현상을 이용하여 빛의 파장·굴절률 등을 측정하는 장치인 간섭계를 사용하여 복잡하고 주변 환경에 민감한 단점이 있다.

우리 대학 물리학과 박용근 교수 연구팀이 3차원 홀로그래피 이미징 센서 기술의 새로운 도약을 이뤘다고 23일 발표했다.

연구팀은 복잡한 간섭계를 사용하지 않는 혁신적인 홀로그래피 카메라 기술을 발표했다. 이 기술은 마스크를 이용해 빛의 위상 정보를 정밀하게 측정하며, 이에 따라 물체의 3D 정보를 더욱 정확하게 재구성할 수 있다.

연구팀은 제시한 혁신적인 방법은 수학적으로 특정 조건을 만족하는 마스크를 일반 카메라에 추가하고, 이를 통해 측정한 레이저 산란광을 컴퓨터 상에서 분석하는 방식이다. 복잡한 간섭계가 필요하지 않고, 더욱 단순화된 광학 시스템을 통해 빛의 위상 정보를 효과적으로 획득한다. 이 기술에서는 물체 뒤 위치한 두 렌즈 사이의 특별한 마스크가 중요한 역할을 한다. 이 마스크는 빛의 특정 부분을 선별적으로 필터링하며, 렌즈를 통과하는 빛의 강도는 일반적인 상업용 카메라로 측정될 수 있다. 이 기술은 카메라로부터 받아온 이미지 데이터와 마스크의 독특한 패턴을 결합해, 알고리즘 처리를 통해 물체의 세밀한 3D 정보를 복원한다.

이러한 방식은 어떤 위치의 물체든 선명하게 3차원으로 촬영하는 능력을 갖추고 있다. 실제 구현을 위해서는, 일반적인 이미지 센서에 단순한 디자인의 마스크를 추가하는 것으로 레이저 홀로그래피 3D 이미지 센서 구현이 가능하다. 이에 따라 광학 시스템의 설계와 제작이 더욱 간편해진다. 특히 이 새로운 기술은 빠른 움직임의 물체에도 선명한 홀로그래픽 이미지 촬영이 가능해 활용 범위가 넓어질 것으로 예상된다.

물리학과 오정훈 박사가 제1 저자로 참여한 이 연구 결과는 국제적인 학술지 '네이처 커뮤니케이션즈 (Nature Communications)' 8월 12일 字에 출판됐다. (논문명: Non-interferometric stand-alone single-shot holographic camera using reciprocal diffractive imaging)

제1 저자인 물리학과 오정훈 박사는 “제안하는 홀로그래픽 카메라의 모듈은 일반 카메라에 필터를 추가하는 방식으로 구현될 수 있으므로, 실용화된다면 일상생활에서 비전문가가 손쉽게 사용할 수 있을 것이다”라며, “특히 기존의 원격 감지 기술들을 대체할 수 있다는 높은 잠재력을 가지고 있다”라고 말했다.

한편 이번 연구는 연구재단의 리더연구사업, 과학기술정보통신부의 홀로그램핵심기술지원사업, 나노 및 소재 기술개발사업의 지원을 받아 수행됐다.

2023.08.23 조회수 7949 -

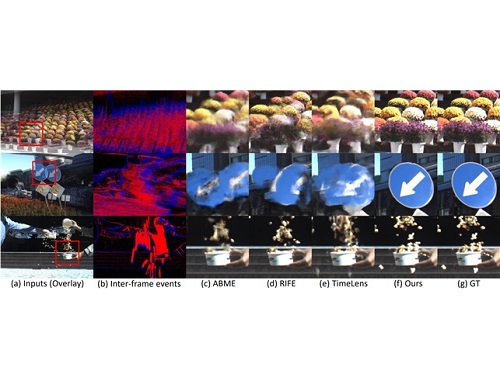

세계 최고 수준의 이벤트 카메라 기반 비디오 보간 기술 개발

비디오 보간은 비디오 사이의 새로운 프레임을 생성하여 프레임률을 높이고 비디오 내 부드러운 모션을 구현하는 기술이다. 전 세계적으로 많은 연구진이 RGB 카메라만을 사용하여 비디오 보간을 수행하였다. 하지만, 프레임 사이의 움직임 정보의 부재로 인하여 복잡한 상황에서 비디오 보간 성능의 한계를 지닌다. 특히, 현실적인 상황에서 발생하는 비선형적인 움직임에 대해서는 비디오 보간 성능이 크게 하락하는 문제점이 존재한다.

우리 대학 기계공학과 윤국진 교수팀은 인간의 시신경을 모방한 이벤트 카메라와 RGB 카메라를 동시에 사용할 수 있는 하이브리드 카메라 시스템을 구축하고 세계 최고 수준의 이벤트 카메라 기반 초고속 비디오 보간 기술을 개발했다. 본 연구는 기존의 비디오 보간 방법 대비 35% 이상의 세계 최고 성능을 달성하였고, 복잡하고 극심한 움직임 속에서도 높은 성능으로 30FPS 비디오를 10000FPS 이상의 초고속 비디오로 합성할 수 있다.

이벤트 카메라는 인간의 시신경을 모방한 카메라로서, 영상의 밝기 변화만을 감지한다. 이러한 특성으로 인하여 이벤트 카메라는 micro 초 단위의 시간 해상도와 높은 dynamic range의 정보를 제공하여 기존의 RGB 카메라가 가지지 못하는 장점을 가지고 있다. 따라서, 이벤트 카메라는 RGB video 프레임 사이의 정확한 움직임 정보를 포착할 수 있어 일반 RGB 카메라와 이벤트 카메라를 동시적으로 사용하면 정확도 높은 초고속 비디오를 생성할 수 있다.

기존의 이벤트 카메라 기반 비디오 보간 연구는 이벤트 카메라에서 나오는 이벤트 정보만을 사용하여 프레임 사이의 광학 흐름을 추정하거나 프레임 사이의 움직임을 근사하는 방법을 사용하였다. 하지만, 이벤트 정보는 공간적으로 희박하고 밝기 정보만을 기록하기 때문에 이벤트만을 사용한 광학 흐름 추정 방법의 결과가 좋지 못한 점을 연구팀은 주목했다. 이를 극복하기 위해 연구팀은 기존의 RGB 이미지와 이벤트 정보를 동시적으로 사용하는 이미지-이벤트 비대칭 양방향 움직임 추정 기법을 제안하였다. 이벤트는 풍부한 움직임의 궤적정보를 제공하는 장점과 이미지의 풍부한 시각 정보의 각 장점을 잘 융합하여 서로 다른 정보의 장단점을 보완 및 융합한 광학 흐름 추정 방법을 제안하여 그 우수성을 입증하였다.

또한, 설계 및 제작한 빔 스플리터 기반 이벤트-RGB 하이브리드 카메라 시스템을 사용하여 이벤트 카메라를 이용한 모션-기반 비디오 보간 기술 데이터셋을 구축하였다. 기존의 이벤트 카메라를 이용한 비디오 보간 데이터셋의 경우, 카메라 움직임이 존재하지 않는 문제와 낮은 프레임 레이트/해상도로 인하여 딥러닝 알고리즘의 학습 및 이벤트 카메라 기반 비디오 보간 기술 개발 및 평가에 한계점을 지닌다. 제안된 데이터셋의 경우 이벤트 카메라 기반 비디오 향상 연구 커뮤니티에 큰 기여를 할 수 있을 것으로 예상된다.

이번 연구는 고품질의 높은 프레임률을 가지는 비디오 생성이 가능하여, 기존의 초고속 카메라로 비디오 촬영이 어려운 광량이 부족한 환경 및 아주 빠른 물체의 움직임을 분석이 필요한 여러 상황 등에서 널리 사용될 수 있을 것으로 기대된다.

이번 연구는 윤국진 교수 연구실의 김태우 박사과정(제1 저자), 채유정 박사과정(제2 저자), 장현걸 석사과정(제3 저자)이 참여하였고, 올해 캐나다 밴쿠버에서 6월 18일에 열릴 컴퓨터 비전 및 패턴인식 분야의 국제 저명학술지인 CVPR 2023(IEEE Conference on Computer Vision and Pattern Recognition)에 highlight 논문(2.5% acceptance rate)으로 게재될 예정이다.

이 연구는 중견 연구자개발 과제의 지원을 받아 수행되었다. 윤국진 교수 연구팀은 다년간 이벤트 카메라에 관련된 연구를 수행해오면서 이벤트 카메라를 이용한 여러 가지 컴퓨터 비전 분야에 핵심 연구 들을 수행하여 오고 있으며, 앞으로도 이벤트 카메라 연구 커뮤니티에 이바지하기 위하여 지속적인 연구를 수행할 예정이다.

※ 논문명 : Event-based Video Frame Interpolation with Cross-Modal Asymmetric Bidirectional Motion Fields

※ 저자 정보 : 윤국진 (KAIST, 교신저자), 김태우(KAIST, 제1 저자), 채유정(KAIST, 제2 저자), 장현걸(KAIST, 제3 저자) - 총 4명

2023.04.05 조회수 7055

세계 최고 수준의 이벤트 카메라 기반 비디오 보간 기술 개발

비디오 보간은 비디오 사이의 새로운 프레임을 생성하여 프레임률을 높이고 비디오 내 부드러운 모션을 구현하는 기술이다. 전 세계적으로 많은 연구진이 RGB 카메라만을 사용하여 비디오 보간을 수행하였다. 하지만, 프레임 사이의 움직임 정보의 부재로 인하여 복잡한 상황에서 비디오 보간 성능의 한계를 지닌다. 특히, 현실적인 상황에서 발생하는 비선형적인 움직임에 대해서는 비디오 보간 성능이 크게 하락하는 문제점이 존재한다.

우리 대학 기계공학과 윤국진 교수팀은 인간의 시신경을 모방한 이벤트 카메라와 RGB 카메라를 동시에 사용할 수 있는 하이브리드 카메라 시스템을 구축하고 세계 최고 수준의 이벤트 카메라 기반 초고속 비디오 보간 기술을 개발했다. 본 연구는 기존의 비디오 보간 방법 대비 35% 이상의 세계 최고 성능을 달성하였고, 복잡하고 극심한 움직임 속에서도 높은 성능으로 30FPS 비디오를 10000FPS 이상의 초고속 비디오로 합성할 수 있다.

이벤트 카메라는 인간의 시신경을 모방한 카메라로서, 영상의 밝기 변화만을 감지한다. 이러한 특성으로 인하여 이벤트 카메라는 micro 초 단위의 시간 해상도와 높은 dynamic range의 정보를 제공하여 기존의 RGB 카메라가 가지지 못하는 장점을 가지고 있다. 따라서, 이벤트 카메라는 RGB video 프레임 사이의 정확한 움직임 정보를 포착할 수 있어 일반 RGB 카메라와 이벤트 카메라를 동시적으로 사용하면 정확도 높은 초고속 비디오를 생성할 수 있다.

기존의 이벤트 카메라 기반 비디오 보간 연구는 이벤트 카메라에서 나오는 이벤트 정보만을 사용하여 프레임 사이의 광학 흐름을 추정하거나 프레임 사이의 움직임을 근사하는 방법을 사용하였다. 하지만, 이벤트 정보는 공간적으로 희박하고 밝기 정보만을 기록하기 때문에 이벤트만을 사용한 광학 흐름 추정 방법의 결과가 좋지 못한 점을 연구팀은 주목했다. 이를 극복하기 위해 연구팀은 기존의 RGB 이미지와 이벤트 정보를 동시적으로 사용하는 이미지-이벤트 비대칭 양방향 움직임 추정 기법을 제안하였다. 이벤트는 풍부한 움직임의 궤적정보를 제공하는 장점과 이미지의 풍부한 시각 정보의 각 장점을 잘 융합하여 서로 다른 정보의 장단점을 보완 및 융합한 광학 흐름 추정 방법을 제안하여 그 우수성을 입증하였다.

또한, 설계 및 제작한 빔 스플리터 기반 이벤트-RGB 하이브리드 카메라 시스템을 사용하여 이벤트 카메라를 이용한 모션-기반 비디오 보간 기술 데이터셋을 구축하였다. 기존의 이벤트 카메라를 이용한 비디오 보간 데이터셋의 경우, 카메라 움직임이 존재하지 않는 문제와 낮은 프레임 레이트/해상도로 인하여 딥러닝 알고리즘의 학습 및 이벤트 카메라 기반 비디오 보간 기술 개발 및 평가에 한계점을 지닌다. 제안된 데이터셋의 경우 이벤트 카메라 기반 비디오 향상 연구 커뮤니티에 큰 기여를 할 수 있을 것으로 예상된다.

이번 연구는 고품질의 높은 프레임률을 가지는 비디오 생성이 가능하여, 기존의 초고속 카메라로 비디오 촬영이 어려운 광량이 부족한 환경 및 아주 빠른 물체의 움직임을 분석이 필요한 여러 상황 등에서 널리 사용될 수 있을 것으로 기대된다.

이번 연구는 윤국진 교수 연구실의 김태우 박사과정(제1 저자), 채유정 박사과정(제2 저자), 장현걸 석사과정(제3 저자)이 참여하였고, 올해 캐나다 밴쿠버에서 6월 18일에 열릴 컴퓨터 비전 및 패턴인식 분야의 국제 저명학술지인 CVPR 2023(IEEE Conference on Computer Vision and Pattern Recognition)에 highlight 논문(2.5% acceptance rate)으로 게재될 예정이다.

이 연구는 중견 연구자개발 과제의 지원을 받아 수행되었다. 윤국진 교수 연구팀은 다년간 이벤트 카메라에 관련된 연구를 수행해오면서 이벤트 카메라를 이용한 여러 가지 컴퓨터 비전 분야에 핵심 연구 들을 수행하여 오고 있으며, 앞으로도 이벤트 카메라 연구 커뮤니티에 이바지하기 위하여 지속적인 연구를 수행할 예정이다.

※ 논문명 : Event-based Video Frame Interpolation with Cross-Modal Asymmetric Bidirectional Motion Fields

※ 저자 정보 : 윤국진 (KAIST, 교신저자), 김태우(KAIST, 제1 저자), 채유정(KAIST, 제2 저자), 장현걸(KAIST, 제3 저자) - 총 4명

2023.04.05 조회수 7055 -

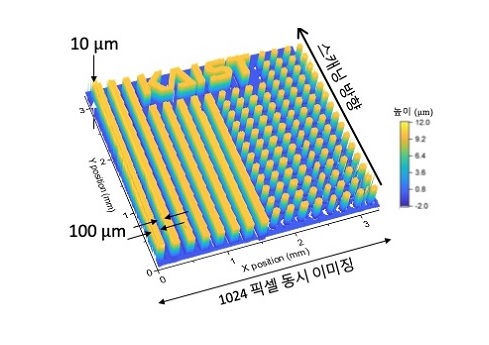

반도체 소자 내의 복잡한 움직임을 관측할 수 있는 초고속 카메라 개발

우리 대학 김정원 교수 연구팀이 반도체 소자 내의 미세 구조와 동적 특성을 고해상도로 측정할 수 있는 초고속 카메라 기술을 개발하였다고 밝혔다.

기존에는 볼 수 없었던 반도체 소자 내에서의 빠르고 불규칙적인 복잡한 움직임을 이제 초고속 카메라로 관측할 수 있게 되었다.

기계공학과 나용진 박사가 제 1저자로 참여하고 기계공학과 유홍기, 이정철 교수팀 및 한국표준과학연구원(KRISS) 서준호, 강주식 박사팀이 참여한 공동연구팀의 이번 논문은 국제학술지 ‘빛: 과학과 응용(Light: Science & Applications)’ [IF=20.257] 2월 15일 字에 게재됐다. (논문명: Massively parallel electro-optic sampling of space-encoded optical pulses for ultrafast multi-dimensional imaging)

최근 마이크로 및 나노 소자들의 복잡도와 기능성이 급격하게 향상됨에 따라 이들 소자 내의 미세 구조와 동적인 움직임을 실시간으로 정확하게 측정해야 할 필요성이 급증하고 있다. 미세 구조 측정 측면에서는 다양한 3차원 집적회로와 소자들의 발전으로 더 큰 웨이퍼 영역에 대해 더 높은 분해능 및 측정속도를 가지는 계측 기술이 반도체 산업에서 중요해지고 있다. 한편 동적 특성의 측정은 마이크로 및 나노 소자 내에서의 물리현상들을 이해하고 다양한 응용 분야들로 발전시키는 데 중요하다. 특히 다양한 역학 현상의 관측을 위해서는 더 높은 해상도, 더 빠른 측정속도 및 더 큰 측정범위를 필요로 하지만 기존의 측정 기술들은 여러가지 한계들을 가지고 있었다.

이번 연구는 기존의 한계를 극복한 새로운 초고속 카메라 기술을 개발하였다. 100펨토초(10조분이 1초) 정도의 매우 짧은 펄스폭을 가지는 빛 펄스를 1000개 이상의 다른 색을 가지는 펄스들로 쪼갠 후, 각기 다른 색을 가진 펄스들을 이용하여 서로 다른 공간적 위치에서의 높낮이를 정밀하게 측정할 수 있는 기술이다. 구현한 기술은 초당 2.6억개의 픽셀들에 대한 높낮이의 차이를 최고 330피코미터(30억분의 1미터) 수준까지 측정할 수 있을 정도로 빠르고 정밀하다. 연구팀은 이를 이용하여 복잡한 3차원 형상을 고속으로 정밀하고 정확하게 측정할 수 있는 초고속 카메라 기능을 선보였고, 기존의 측정 기술로는 관측하기 어렵던 복잡하고 비반복적인 고속의 동역학 현상들을 성공적으로 관측할 수 있었다.

이번에 개발한 초고속 카메라 기술의 고속 형상 이미징 속도와 높은 공간 분해능을 이용하면 반도체 공정이나 3D 프린팅 과정을 실시간으로 모니터링하며 공정을 제어할 수 있어 점점 고도화 및 집적화 되는 공정의 수율을 크게 향상시킬 수 있을 것으로 기대된다. 또한 다양한 진폭이 존재하면서 동시에 매우 빠른 순간 속도를 갖는 미세 구조의 움직임을 포착할 수 있음을 보여, 기존에 관찰하지 못했던 복잡한 비선형(nonlinear) 및 과도(transient)의 물리 현상들을 탐구하는 차세대 계측 기술로 발전할 수 있을 것으로 기대된다.

김정원 교수는 “이번 연구에서는 1차원적인 선 모양의 빛을 스캔해서 움직이는 방식으로 2차원 표면의 높낮이를 측정하였으나, 향후에는 2차원 표면의 높낮이를 스캔 없이 한번에 측정할 수 있는 방식으로 기술을 발전시킬 예정”이라고 밝혔다.

한편 이번 연구는 과학기술정보통신부와 한국연구재단이 추진하는 중견후속연구, 선도연구센터, 기초연구실 및 중견연구 사업의 지원을 받아 수행됐다.

2023.03.02 조회수 10042

반도체 소자 내의 복잡한 움직임을 관측할 수 있는 초고속 카메라 개발

우리 대학 김정원 교수 연구팀이 반도체 소자 내의 미세 구조와 동적 특성을 고해상도로 측정할 수 있는 초고속 카메라 기술을 개발하였다고 밝혔다.

기존에는 볼 수 없었던 반도체 소자 내에서의 빠르고 불규칙적인 복잡한 움직임을 이제 초고속 카메라로 관측할 수 있게 되었다.

기계공학과 나용진 박사가 제 1저자로 참여하고 기계공학과 유홍기, 이정철 교수팀 및 한국표준과학연구원(KRISS) 서준호, 강주식 박사팀이 참여한 공동연구팀의 이번 논문은 국제학술지 ‘빛: 과학과 응용(Light: Science & Applications)’ [IF=20.257] 2월 15일 字에 게재됐다. (논문명: Massively parallel electro-optic sampling of space-encoded optical pulses for ultrafast multi-dimensional imaging)

최근 마이크로 및 나노 소자들의 복잡도와 기능성이 급격하게 향상됨에 따라 이들 소자 내의 미세 구조와 동적인 움직임을 실시간으로 정확하게 측정해야 할 필요성이 급증하고 있다. 미세 구조 측정 측면에서는 다양한 3차원 집적회로와 소자들의 발전으로 더 큰 웨이퍼 영역에 대해 더 높은 분해능 및 측정속도를 가지는 계측 기술이 반도체 산업에서 중요해지고 있다. 한편 동적 특성의 측정은 마이크로 및 나노 소자 내에서의 물리현상들을 이해하고 다양한 응용 분야들로 발전시키는 데 중요하다. 특히 다양한 역학 현상의 관측을 위해서는 더 높은 해상도, 더 빠른 측정속도 및 더 큰 측정범위를 필요로 하지만 기존의 측정 기술들은 여러가지 한계들을 가지고 있었다.

이번 연구는 기존의 한계를 극복한 새로운 초고속 카메라 기술을 개발하였다. 100펨토초(10조분이 1초) 정도의 매우 짧은 펄스폭을 가지는 빛 펄스를 1000개 이상의 다른 색을 가지는 펄스들로 쪼갠 후, 각기 다른 색을 가진 펄스들을 이용하여 서로 다른 공간적 위치에서의 높낮이를 정밀하게 측정할 수 있는 기술이다. 구현한 기술은 초당 2.6억개의 픽셀들에 대한 높낮이의 차이를 최고 330피코미터(30억분의 1미터) 수준까지 측정할 수 있을 정도로 빠르고 정밀하다. 연구팀은 이를 이용하여 복잡한 3차원 형상을 고속으로 정밀하고 정확하게 측정할 수 있는 초고속 카메라 기능을 선보였고, 기존의 측정 기술로는 관측하기 어렵던 복잡하고 비반복적인 고속의 동역학 현상들을 성공적으로 관측할 수 있었다.

이번에 개발한 초고속 카메라 기술의 고속 형상 이미징 속도와 높은 공간 분해능을 이용하면 반도체 공정이나 3D 프린팅 과정을 실시간으로 모니터링하며 공정을 제어할 수 있어 점점 고도화 및 집적화 되는 공정의 수율을 크게 향상시킬 수 있을 것으로 기대된다. 또한 다양한 진폭이 존재하면서 동시에 매우 빠른 순간 속도를 갖는 미세 구조의 움직임을 포착할 수 있음을 보여, 기존에 관찰하지 못했던 복잡한 비선형(nonlinear) 및 과도(transient)의 물리 현상들을 탐구하는 차세대 계측 기술로 발전할 수 있을 것으로 기대된다.

김정원 교수는 “이번 연구에서는 1차원적인 선 모양의 빛을 스캔해서 움직이는 방식으로 2차원 표면의 높낮이를 측정하였으나, 향후에는 2차원 표면의 높낮이를 스캔 없이 한번에 측정할 수 있는 방식으로 기술을 발전시킬 예정”이라고 밝혔다.

한편 이번 연구는 과학기술정보통신부와 한국연구재단이 추진하는 중견후속연구, 선도연구센터, 기초연구실 및 중견연구 사업의 지원을 받아 수행됐다.

2023.03.02 조회수 10042 -

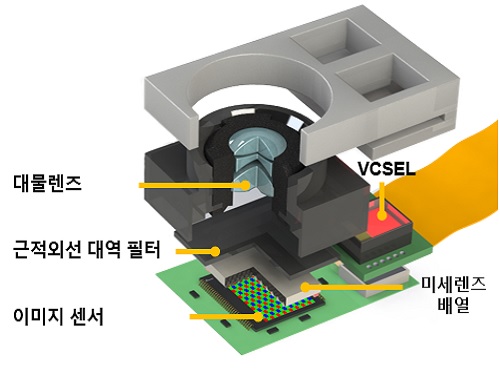

3차원 표정인식용 인공지능 라이트필드 카메라 개발

우리 대학 바이오및뇌공학과 정기훈, 이도헌 교수 공동연구팀이 근적외선 기반 라이트필드 카메라와 인공지능기술을 융합하여 얼굴의 감정표현을 구분하는 기술을 개발했다고 7일 밝혔다.

라이트필드 카메라는 일반적인 카메라와 다르게 미세렌즈 배열(Microlens arrays)을 이미지센서 앞에 삽입해 손에 들 수 있을 정도로 작은 크기이지만 한 번의 촬영으로 빛의 공간 및 방향 정보를 획득한다. 이를 통해 다시점 영상, 디지털 재초점, 3차원 영상 획득 등 다양한 영상 재구성이 가능하고 많은 활용 가능성으로 주목받고 있는 촬영 기술이다.

그러나 기존의 라이트필드 카메라는 실내조명에 의한 그림자와 미세렌즈 사이의 광학 크로스토크(Optical crosstalk)에 의해 이미지의 대비도 및 3차원 재구성의 정확도가 낮아지는 한계점이 있다.

연구팀은 라이트필드 카메라에 근적외선 영역의 수직 공진형 표면 발광 레이저(VCSEL) 광원과 근적외선 대역필터를 적용해 기존 라이트필드 카메라가 갖는 조명 환경에 따라 3차원 재구성의 정확도가 낮아지는 문제를 해결했다. 이를 통해 얼굴 정면 기준 0도, 30도, 60도 각도의 외부 조명에 대해, 근적외선 대역필터를 사용한 경우 최대 54%까지 영상 재구성 오류를 줄일 수 있었다. 또한, 가시광선 및 근적외선 영역을 흡수하는 광 흡수층을 미세렌즈 사이에 제작하면서 광학 크로스토크를 최소화해 원시 영상의 대비도를 기존 대비 약 2.1배 정도로 획기적으로 향상하는 데 성공했다.

이를 통해 기존 라이트필드 카메라의 한계를 극복하고 3차원 표정 영상 재구성에 최적화된 근적외선 기반 라이트필드 카메라(NIR-LFC, NIR-based light-field camera) 개발에 성공했다. 연구팀은 개발한 카메라를 통해 피험자의 다양한 감정표정을 가진 얼굴의 3차원 재구성 이미지를 조명 환경과 관계없이 고품질로 획득할 수 있었다.

획득한 3차원 얼굴 이미지로부터 기계 학습을 통해 성공적으로 표정을 구분할 수 있었고, 분류 결과의 정확도는 평균 85% 정도로 2차원 이미지를 이용했을 때보다 통계적으로 유의미하게 높은 정확도를 보였다. 이뿐만 아니라, 연구팀은 표정에 따른 얼굴의 3차원 거리 정보의 상호의존성을 계산한 결과를 통해, 라이트필드 카메라가 인간이나 기계가 표정을 판독할 때 어떤 정보를 활용하는지에 대한 단서를 제공할 수 있음을 확인했다.

정기훈 교수는 "연구팀이 개발한 초소형 라이트필드 카메라는 정량적으로 인간의 표정과 감정을 분석하기 위한 새로운 플랫폼으로 활용될 수 있을 것으로 기대된다ˮ며 "모바일 헬스케어, 현장 진단, 사회 인지, 인간-기계 상호작용 등의 분야에서 활용될 것ˮ이라고 연구의 의미를 설명했다.

우리 대학 바이오및뇌공학과 배상인 박사과정 졸업생이 주도한 이번 연구 결과는 국제저명학술지 `어드밴스드 인텔리전트 시스템즈(Advanced Intelligent Systems)'에 2021년 12월 16일 온라인 게재됐다. (논문명: Machine-Learned Light-Field Camera that Reads Facial Expression from High-Contrast and Illumination Invariant 3D Facial Images).

한편 이번 연구는 과학기술정보통신부 및 산업통상자원부의 지원을 받아 수행됐다.

2022.01.07 조회수 11322

3차원 표정인식용 인공지능 라이트필드 카메라 개발

우리 대학 바이오및뇌공학과 정기훈, 이도헌 교수 공동연구팀이 근적외선 기반 라이트필드 카메라와 인공지능기술을 융합하여 얼굴의 감정표현을 구분하는 기술을 개발했다고 7일 밝혔다.

라이트필드 카메라는 일반적인 카메라와 다르게 미세렌즈 배열(Microlens arrays)을 이미지센서 앞에 삽입해 손에 들 수 있을 정도로 작은 크기이지만 한 번의 촬영으로 빛의 공간 및 방향 정보를 획득한다. 이를 통해 다시점 영상, 디지털 재초점, 3차원 영상 획득 등 다양한 영상 재구성이 가능하고 많은 활용 가능성으로 주목받고 있는 촬영 기술이다.

그러나 기존의 라이트필드 카메라는 실내조명에 의한 그림자와 미세렌즈 사이의 광학 크로스토크(Optical crosstalk)에 의해 이미지의 대비도 및 3차원 재구성의 정확도가 낮아지는 한계점이 있다.

연구팀은 라이트필드 카메라에 근적외선 영역의 수직 공진형 표면 발광 레이저(VCSEL) 광원과 근적외선 대역필터를 적용해 기존 라이트필드 카메라가 갖는 조명 환경에 따라 3차원 재구성의 정확도가 낮아지는 문제를 해결했다. 이를 통해 얼굴 정면 기준 0도, 30도, 60도 각도의 외부 조명에 대해, 근적외선 대역필터를 사용한 경우 최대 54%까지 영상 재구성 오류를 줄일 수 있었다. 또한, 가시광선 및 근적외선 영역을 흡수하는 광 흡수층을 미세렌즈 사이에 제작하면서 광학 크로스토크를 최소화해 원시 영상의 대비도를 기존 대비 약 2.1배 정도로 획기적으로 향상하는 데 성공했다.

이를 통해 기존 라이트필드 카메라의 한계를 극복하고 3차원 표정 영상 재구성에 최적화된 근적외선 기반 라이트필드 카메라(NIR-LFC, NIR-based light-field camera) 개발에 성공했다. 연구팀은 개발한 카메라를 통해 피험자의 다양한 감정표정을 가진 얼굴의 3차원 재구성 이미지를 조명 환경과 관계없이 고품질로 획득할 수 있었다.

획득한 3차원 얼굴 이미지로부터 기계 학습을 통해 성공적으로 표정을 구분할 수 있었고, 분류 결과의 정확도는 평균 85% 정도로 2차원 이미지를 이용했을 때보다 통계적으로 유의미하게 높은 정확도를 보였다. 이뿐만 아니라, 연구팀은 표정에 따른 얼굴의 3차원 거리 정보의 상호의존성을 계산한 결과를 통해, 라이트필드 카메라가 인간이나 기계가 표정을 판독할 때 어떤 정보를 활용하는지에 대한 단서를 제공할 수 있음을 확인했다.

정기훈 교수는 "연구팀이 개발한 초소형 라이트필드 카메라는 정량적으로 인간의 표정과 감정을 분석하기 위한 새로운 플랫폼으로 활용될 수 있을 것으로 기대된다ˮ며 "모바일 헬스케어, 현장 진단, 사회 인지, 인간-기계 상호작용 등의 분야에서 활용될 것ˮ이라고 연구의 의미를 설명했다.

우리 대학 바이오및뇌공학과 배상인 박사과정 졸업생이 주도한 이번 연구 결과는 국제저명학술지 `어드밴스드 인텔리전트 시스템즈(Advanced Intelligent Systems)'에 2021년 12월 16일 온라인 게재됐다. (논문명: Machine-Learned Light-Field Camera that Reads Facial Expression from High-Contrast and Illumination Invariant 3D Facial Images).

한편 이번 연구는 과학기술정보통신부 및 산업통상자원부의 지원을 받아 수행됐다.

2022.01.07 조회수 11322 -

초고속 전자카메라의 성능을 한층 더 높여

우리 대학 기계공학과 김정원 교수 연구팀이 한국원자력연구원 초고속 방사선 연구실과의 공동 연구를 통해 극초단 전자 펄스의 타이밍을 10펨토초(100조분의 1초) 안정도로 측정하고 제어하는 기술을 개발, 이를 적용해 초고속 전자카메라(전자회절장치)의 성능을 한층 더 높이는 데 성공했다고 5일 밝혔다.

이 새로운 타이밍 안정화 기술을 이용하면 초고속 전자 회절(ultrafast electron diffraction, UED) 기법의 분석 능력을 크게 개선해 그래핀 등의 2차원 물질과 같은 첨단 물질들의 새로운 성질들을 규명할 수 있는 핵심 기술이 될 것으로 기대된다.

신준호 박사(現 원자력(연))가 제1 저자로서 우리 대학 박사과정 중 수행한 연구 결과를 발표한 이번 성과는 국제학술지 `레이저 앤드 포토닉스 리뷰즈(Laser & Photonics Reviews; IF=10.655)'의 2021년 2월호 표지논문(front cover)으로 2월 11일 字 게재됐다. (논문명: Sub-10-fs timing for ultrafast electron diffraction with THz-driven streak camera)

극초단 전자 펄스를 기반으로 한 회절 분석 기법(UED)은 전자 펄스의 짧은 펄스폭(수십 펨토초)과 광속에 가까운 속도(99.2%)를 활용해 태양광 소자, 차세대 전기·전자 소재 개발 등 미래 첨단 산업 분야를 위한 연구에 활용되고 있다.

한국원자력연구원은 이미 세계에서 가장 성능이 우수한 전자카메라를 보유하고 있으며, 이 기술 개발을 통해 기존 전자 회절 기법의 분해능 개선뿐만 아니라 이전에는 불가능했던 원자 내의 전자 동역학 관측에도 도전하게 됐다.

기존의 전자 펄스의 타이밍 안정화 기술들은 전자를 생성하는 고주파 마이크로파 신호와 레이저를 개별적으로 안정화했으나, 전자 펄스 자체의 타이밍을 장시간 안정화하지는 못하는 한계점이 있었다.

연구팀은 이러한 한계들을 극복하기 위해 테라헤르츠파 스트리킹(streaking) 기술로 전자 펄스의 타이밍을 측정하고 제어하는 시스템을 구현했다.

이러한 테라헤르츠파 스트리킹 기술의 선결 조건으로 먼저 전자 펄스를 발생시키는 데 필요한 레이저와 마이크로파 신호들의 정밀한 측정과 제어가 이뤄져야 하며, 연구팀은 이를 위해 레이저와 마이크로파 간의 정밀 동기화 시스템, 광 펄스의 모니터링 시스템, 자석 기반 전자 펄스 압축 시스템 등 다양한 레이저-마이크로파-전자빔 안정화 장치들을 하나씩 구현하고 최적화했다.

최종적으로 측정한 전자 펄스와 테라헤르츠파 사이의 시간 차이는 모터를 활용해 제어하고 보정했으며, 그 결과 세계 최초로 전자 펄스의 타이밍을 5.5펨토초 수준으로 4,600초 동안 안정화할 수 있었다. 이는 기존의 세계 최고 성능보다 4배 이상 향상된 시간 안정도다.

김정원 교수는 "지속적으로 이루어지고 있는 전자 펄스의 타이밍 안정도 개선과 초고속 전자카메라의 성능 향상이 다양한 태양광 소재 개발이나 전자구름 관측 등 차세대 기초 및 산업 연구 수요를 맞출 수 있을 것ˮ이라고 전망했다.

한편 이번 연구는 한국원자력연구원 주요사업과 한국연구재단 중견연구지원사업의 지원을 받아 수행됐다.

2021.03.09 조회수 93511

초고속 전자카메라의 성능을 한층 더 높여

우리 대학 기계공학과 김정원 교수 연구팀이 한국원자력연구원 초고속 방사선 연구실과의 공동 연구를 통해 극초단 전자 펄스의 타이밍을 10펨토초(100조분의 1초) 안정도로 측정하고 제어하는 기술을 개발, 이를 적용해 초고속 전자카메라(전자회절장치)의 성능을 한층 더 높이는 데 성공했다고 5일 밝혔다.

이 새로운 타이밍 안정화 기술을 이용하면 초고속 전자 회절(ultrafast electron diffraction, UED) 기법의 분석 능력을 크게 개선해 그래핀 등의 2차원 물질과 같은 첨단 물질들의 새로운 성질들을 규명할 수 있는 핵심 기술이 될 것으로 기대된다.

신준호 박사(現 원자력(연))가 제1 저자로서 우리 대학 박사과정 중 수행한 연구 결과를 발표한 이번 성과는 국제학술지 `레이저 앤드 포토닉스 리뷰즈(Laser & Photonics Reviews; IF=10.655)'의 2021년 2월호 표지논문(front cover)으로 2월 11일 字 게재됐다. (논문명: Sub-10-fs timing for ultrafast electron diffraction with THz-driven streak camera)

극초단 전자 펄스를 기반으로 한 회절 분석 기법(UED)은 전자 펄스의 짧은 펄스폭(수십 펨토초)과 광속에 가까운 속도(99.2%)를 활용해 태양광 소자, 차세대 전기·전자 소재 개발 등 미래 첨단 산업 분야를 위한 연구에 활용되고 있다.

한국원자력연구원은 이미 세계에서 가장 성능이 우수한 전자카메라를 보유하고 있으며, 이 기술 개발을 통해 기존 전자 회절 기법의 분해능 개선뿐만 아니라 이전에는 불가능했던 원자 내의 전자 동역학 관측에도 도전하게 됐다.

기존의 전자 펄스의 타이밍 안정화 기술들은 전자를 생성하는 고주파 마이크로파 신호와 레이저를 개별적으로 안정화했으나, 전자 펄스 자체의 타이밍을 장시간 안정화하지는 못하는 한계점이 있었다.

연구팀은 이러한 한계들을 극복하기 위해 테라헤르츠파 스트리킹(streaking) 기술로 전자 펄스의 타이밍을 측정하고 제어하는 시스템을 구현했다.

이러한 테라헤르츠파 스트리킹 기술의 선결 조건으로 먼저 전자 펄스를 발생시키는 데 필요한 레이저와 마이크로파 신호들의 정밀한 측정과 제어가 이뤄져야 하며, 연구팀은 이를 위해 레이저와 마이크로파 간의 정밀 동기화 시스템, 광 펄스의 모니터링 시스템, 자석 기반 전자 펄스 압축 시스템 등 다양한 레이저-마이크로파-전자빔 안정화 장치들을 하나씩 구현하고 최적화했다.

최종적으로 측정한 전자 펄스와 테라헤르츠파 사이의 시간 차이는 모터를 활용해 제어하고 보정했으며, 그 결과 세계 최초로 전자 펄스의 타이밍을 5.5펨토초 수준으로 4,600초 동안 안정화할 수 있었다. 이는 기존의 세계 최고 성능보다 4배 이상 향상된 시간 안정도다.

김정원 교수는 "지속적으로 이루어지고 있는 전자 펄스의 타이밍 안정도 개선과 초고속 전자카메라의 성능 향상이 다양한 태양광 소재 개발이나 전자구름 관측 등 차세대 기초 및 산업 연구 수요를 맞출 수 있을 것ˮ이라고 전망했다.

한편 이번 연구는 한국원자력연구원 주요사업과 한국연구재단 중견연구지원사업의 지원을 받아 수행됐다.

2021.03.09 조회수 93511 -

해상도 높인 초박형 4D 카메라 개발

우리 대학 바이오및뇌공학과 정기훈 교수 연구팀이 금속 나노 광 흡수층을 통해 고해상도 4D 영상 구현이 가능한 초박형 라이트필드 카메라를 개발했다고 4일 밝혔다.

`라이트필드 카메라'는 곤충의 시각 구조에서 발견되는 형태에 착안해 미세렌즈와 대물렌즈를 결합한 진보된 형태의 카메라다. 한 번의 2차원 촬영으로 빛의 공간 뿐만 아니라 방향까지 4차원 정보를 동시에 획득한다. 그러나 기존 라이트필드 카메라는 미세렌즈 배열의 *광학 크로스토크(Optical crosstalk)로 인한 해상도 저하와 대물렌즈의 위치로 인한 크기의 한계가 존재한다.

☞ 광학 크로스토크(Optical Crosstalk): 어떤 통신회선의 전기 신호가 다른 통신회선과 전자기적으로 결합해 혼선을 일으키는 통신 용어를 크로스토크라고 하며, 광학에서는 한 렌즈를 통과한 빛이 다른 렌즈로부터 들어온 빛과 겹쳐 생기는 현상으로 영상이 중첩되어 촬영되는 것을 의미한다.

연구팀이 개발한 `4D 카메라'는 나노 두께의 광 흡수 구조를 미세렌즈 배열(Microlens arrays) 사이에 삽입해 대비도 및 해상도를 높였으며, 기존의 카메라가 가지는 외부 광원, 추가 센서 부착의 한계를 극복할 수 있다. 이러한 특징을 이용해 의료영상, 생체인식, 모바일 카메라 또는 다양한 가상현실/증강현실 카메라 분야에 적용 가능할 것으로 기대된다.

연구팀은 미세렌즈 배열의 광학 크로스토크를 제거하기 위해 200나노미터(nm) 두께 수준의 금속-유전체-금속 박막으로 이루어진 광 흡수층을 렌즈 사이에 배치하고, 대물렌즈와 미세렌즈 사이의 간격을 일정 수준으로 줄여 초박형 라이트필드 카메라를 개발하는 데 성공했다.

높은 광학적 손실성과 낮은 분산성을 갖는 크로뮴(Cr) 금속과 높은 투과율을 갖는 유리층을 나노미터 두께로 적층한 구조(Cr–SiO2–Cr)는 가시광선 영역의 빛을 완전히 흡수할 수 있다. 나노 광 흡수층을 미세렌즈 배열 사이에 배치해 미세렌즈들 사이의 광학 크로스토크를 제거하고 고 대비 및 고해상도 3차원 영상을 획득하는 데 도움을 준다.

연구팀은 광 흡수 구조를 갖는 미세렌즈 배열을 포토리소그래피(Photolithography), 리프트 오프(Lift-off), 열 재유동(Thermal reflow) 공정을 통해 양산 제작했다. 또한, 라이트필드 카메라의 전체 두께를 최소화하기 위해 미세렌즈의 방향을 이미지센서 방향의 역방향으로 배치하고 대물렌즈와 미세렌즈 사이 거리를 2.1mm 수준으로 줄여, 전체 5.1mm의 두께를 갖는다. 이는 현재까지 개발된 라이트필드 카메라 중 가장 얇은 두께다.

나노 광 흡수 구조를 갖는 미세렌즈에 의해 이미지센서에 기록되는 원시 영상은 기존 미세렌즈를 통한 영상에 비해 높은 대비도와 해상도를 가지며, 연구팀은 이를 영상처리 기법을 통해 시점 영상 및 3차원 영상으로 재구성했을 때 향상된 정확도를 가짐을 확인했다.

정기훈 교수는 "초박형이면서 고해상도의 라이트필드 카메라를 제작하는 새로운 방법을 제시했다ˮ며 "이 카메라는 생체인식, 의료 내시경, 휴대폰 카메라와 같이 다시점(Multi-view), 재초점(Refocusing)을 요구하는 초소형 영상장치로 통합돼, 초소형 4D 카메라의 새로운 플랫폼으로 활용될 것ˮ이라고 말했다.

우리 대학 바이오및뇌공학과 배상인 박사과정이 주도한 이번 연구 결과는 국제 학술지 `어드밴스드 옵티컬 머티리얼즈(Advanced Optical Materials)'에 1월 20일 字 게재됐다. (논문명: High Contrast Ultrathin Light-field Camera using inverted Microlens arrays with Metal-Insulator-Metal Optical Absorber)

한편 이번 연구는 과학기술정보통신부의 개인연구지원사업, 산업 통산 자원부의 기술혁신프로그램, 보건복지부의 보건의료기술연구개발사업으로 수행됐다.

2021.02.04 조회수 83686

해상도 높인 초박형 4D 카메라 개발

우리 대학 바이오및뇌공학과 정기훈 교수 연구팀이 금속 나노 광 흡수층을 통해 고해상도 4D 영상 구현이 가능한 초박형 라이트필드 카메라를 개발했다고 4일 밝혔다.

`라이트필드 카메라'는 곤충의 시각 구조에서 발견되는 형태에 착안해 미세렌즈와 대물렌즈를 결합한 진보된 형태의 카메라다. 한 번의 2차원 촬영으로 빛의 공간 뿐만 아니라 방향까지 4차원 정보를 동시에 획득한다. 그러나 기존 라이트필드 카메라는 미세렌즈 배열의 *광학 크로스토크(Optical crosstalk)로 인한 해상도 저하와 대물렌즈의 위치로 인한 크기의 한계가 존재한다.

☞ 광학 크로스토크(Optical Crosstalk): 어떤 통신회선의 전기 신호가 다른 통신회선과 전자기적으로 결합해 혼선을 일으키는 통신 용어를 크로스토크라고 하며, 광학에서는 한 렌즈를 통과한 빛이 다른 렌즈로부터 들어온 빛과 겹쳐 생기는 현상으로 영상이 중첩되어 촬영되는 것을 의미한다.

연구팀이 개발한 `4D 카메라'는 나노 두께의 광 흡수 구조를 미세렌즈 배열(Microlens arrays) 사이에 삽입해 대비도 및 해상도를 높였으며, 기존의 카메라가 가지는 외부 광원, 추가 센서 부착의 한계를 극복할 수 있다. 이러한 특징을 이용해 의료영상, 생체인식, 모바일 카메라 또는 다양한 가상현실/증강현실 카메라 분야에 적용 가능할 것으로 기대된다.

연구팀은 미세렌즈 배열의 광학 크로스토크를 제거하기 위해 200나노미터(nm) 두께 수준의 금속-유전체-금속 박막으로 이루어진 광 흡수층을 렌즈 사이에 배치하고, 대물렌즈와 미세렌즈 사이의 간격을 일정 수준으로 줄여 초박형 라이트필드 카메라를 개발하는 데 성공했다.

높은 광학적 손실성과 낮은 분산성을 갖는 크로뮴(Cr) 금속과 높은 투과율을 갖는 유리층을 나노미터 두께로 적층한 구조(Cr–SiO2–Cr)는 가시광선 영역의 빛을 완전히 흡수할 수 있다. 나노 광 흡수층을 미세렌즈 배열 사이에 배치해 미세렌즈들 사이의 광학 크로스토크를 제거하고 고 대비 및 고해상도 3차원 영상을 획득하는 데 도움을 준다.

연구팀은 광 흡수 구조를 갖는 미세렌즈 배열을 포토리소그래피(Photolithography), 리프트 오프(Lift-off), 열 재유동(Thermal reflow) 공정을 통해 양산 제작했다. 또한, 라이트필드 카메라의 전체 두께를 최소화하기 위해 미세렌즈의 방향을 이미지센서 방향의 역방향으로 배치하고 대물렌즈와 미세렌즈 사이 거리를 2.1mm 수준으로 줄여, 전체 5.1mm의 두께를 갖는다. 이는 현재까지 개발된 라이트필드 카메라 중 가장 얇은 두께다.

나노 광 흡수 구조를 갖는 미세렌즈에 의해 이미지센서에 기록되는 원시 영상은 기존 미세렌즈를 통한 영상에 비해 높은 대비도와 해상도를 가지며, 연구팀은 이를 영상처리 기법을 통해 시점 영상 및 3차원 영상으로 재구성했을 때 향상된 정확도를 가짐을 확인했다.

정기훈 교수는 "초박형이면서 고해상도의 라이트필드 카메라를 제작하는 새로운 방법을 제시했다ˮ며 "이 카메라는 생체인식, 의료 내시경, 휴대폰 카메라와 같이 다시점(Multi-view), 재초점(Refocusing)을 요구하는 초소형 영상장치로 통합돼, 초소형 4D 카메라의 새로운 플랫폼으로 활용될 것ˮ이라고 말했다.

우리 대학 바이오및뇌공학과 배상인 박사과정이 주도한 이번 연구 결과는 국제 학술지 `어드밴스드 옵티컬 머티리얼즈(Advanced Optical Materials)'에 1월 20일 字 게재됐다. (논문명: High Contrast Ultrathin Light-field Camera using inverted Microlens arrays with Metal-Insulator-Metal Optical Absorber)

한편 이번 연구는 과학기술정보통신부의 개인연구지원사업, 산업 통산 자원부의 기술혁신프로그램, 보건복지부의 보건의료기술연구개발사업으로 수행됐다.

2021.02.04 조회수 83686 -

딥러닝 기반 실시간 기침 인식 카메라 개발

우리 대학 기계공학과 박용화 교수 연구팀이 ㈜에스엠 인스트루먼트와 공동으로 실시간으로 기침 소리를 인식하고 기침하는 사람의 위치를 이미지로 표시해주는 '기침 인식 카메라'를 개발했다고 3일 밝혔다.

작년 말부터 시작된 세계적 유행성 전염병인 코로나19가 최근 미국·중국·유럽 등 세계 각국에서 재확산되는 추세로 접어들면서 비접촉방식으로 전염병을 감지하는 기술에 대한 수요가 증가하고 있다.

코로나19의 대표적인 증상이 발열과 기침인데, 현재 발열은 열화상 카메라를 이용해 직접 접촉을 하지 않고도 체온을 쉽게 판별할 수 있다. 문제는 비접촉방식으로는 기침하는 사람의 증상을 쉽사리 파악하기 어렵다는 점이다. 박 교수 연구팀은 이런 문제를 해결하기 위해 기침 소리를 실시간으로 인식하는 딥러닝 기반의 기침 인식 모델을 개발했다. 또한 열화상 카메라와 같은 원리로 기침 소리와 기침하는 사람의 시각화를 위해 기침 인식 모델을 음향 카메라에 적용, 기침 소리와 기침하는 사람의 위치, 심지어 기침 횟수까지를 실시간으로 추적하고 기록이 가능한 '기침 인식 카메라'를 개발했다.

연구팀은 기침 인식 카메라가 사람이 밀집한 공공장소에서 전염병의 유행을 감지하거나 병원에서 환자의 상태를 상시 모니터링 가능한 의료용 장비로 활용될 것으로 기대하고 있다.

연구팀은 기침 인식 모델 개발을 위해 *합성 곱 신경망(convolutional neural network, CNN)을 기반으로 *지도학습(supervised learning)을 적용했다. 1초 길이 음향신호의 특징(feature)을 입력 신호로 받아, 1(기침) 또는 0(그 외)의 2진 신호를 출력하고 학습률의 최적화를 위해 일정 기간 학습률이 정체되면 학습률 값을 낮추도록 설정했다.

이어서 기침 인식 모델의 훈련 및 평가를 위해 구글과 유튜브 등에서 연구용으로 활발히 사용 중인 공개 음성데이터 세트인 `오디오세트(Audioset)'를 비롯해 `디맨드(DEMAND)'와 `이티에스아이(ETSI)', `티미트(TIMIT)' 등에서 데이터 세트를 수집했다. 이 중 `오디오세트'는 훈련 및 평가 데이터 세트 구성을 위해 사용했고 다른 데이터 세트의 경우 기침 인식 모델이 다양한 배경 소음을 학습할 수 있도록 데이터 증강(data augmentation)을 위한 배경 소음으로 사용했다.

☞ 합성 곱 신경망(convolutional neural network): 시각적 이미지를 분석하는 데 사용되는 인공신경망(생물학의 신경망에서 영감을 얻은 통계학적 학습 알고리즘)의 한 종류

☞ 지도학습(Supervised Learning): 훈련 데이터(Training Data)로부터 하나의 함수를 유추해내기 위한 기계 학습(Machine Learning)의 한 방법

데이터 증강을 위해 배경 소음을 15%~75%의 비율로 `오디오세트'에 섞은 후, 다양한 거리에 적응할 수 있게 음량을 0.25~1.0배로 조정했다. 훈련 및 평가 데이터 세트는 증강된 데이터 세트를 9:1 비율로 나눠 구성했으며, 시험 데이터 세트는 따로 사무실에서 녹음한 것을 사용했다.

모델 최적화를 위해서는 '스펙트로그램(spectrogram)' 등 5개의 음향 특징과 7개의 최적화 기기(optimizer)를 사용해 학습을 진행하고 시험 데이터 세트의 정확도를 측정, 성능을 확인한 결과 87.4%의 시험 정확도를 얻을 수 있었다.

연구팀은 이어 학습된 기침 인식 모델을 소리를 수집하는 마이크로폰 어레이와 카메라 모듈로 구성되는 음향 카메라에 적용했다. 그 결과 수집된 데이터는 음원의 위치를 계산하는 빔 형성 과정을 거쳐 기침 인식 모델이 기침 소리로 인식할 경우 기침 소리가 난 위치에 기침 소리임을 나타내는 등고선과 라벨이 각각 표시된다.

박 교수팀은 마지막 단계로 기침 인식 카메라의 예비 테스트를 진행한 결과, 여러 잡음 환경에서도 기침 소리와 그 이외의 소리로 구분이 가능하며 기침하는 사람과 그 사람의 위치, 횟수 등을 실시간으로 추적해 현장에서의 적용 가능성을 확인했다. 이들은 추후 병원 등 실사용 환경에서 추가 학습이 이뤄진다면 정확도는 87.4%보다 더 높아질 것으로 기대하고 있다.

박용화 교수는 "코로나19가 지속적으로 전파되고 있는 상황에서 공공장소와 다수 밀집 시설에 기침 인식 카메라를 활용하면 전염병의 방역 및 조기 감지에 큰 도움이 될 것ˮ이라고 말했다. 박 교수는 이어 "특히 병실에 적용하면 환자의 상태를 24시간 기록해 치료에 활용할 수 있기 때문에 의료진의 수고를 줄이고 환자 상태를 더 정밀하게 파악할 수 있을 것ˮ 이라고 강조했다.

한편, 이번 연구는 에너지기술평가원(산업통상자원부)의 지원을 받아 수행됐다.

2020.08.03 조회수 32180

딥러닝 기반 실시간 기침 인식 카메라 개발

우리 대학 기계공학과 박용화 교수 연구팀이 ㈜에스엠 인스트루먼트와 공동으로 실시간으로 기침 소리를 인식하고 기침하는 사람의 위치를 이미지로 표시해주는 '기침 인식 카메라'를 개발했다고 3일 밝혔다.

작년 말부터 시작된 세계적 유행성 전염병인 코로나19가 최근 미국·중국·유럽 등 세계 각국에서 재확산되는 추세로 접어들면서 비접촉방식으로 전염병을 감지하는 기술에 대한 수요가 증가하고 있다.

코로나19의 대표적인 증상이 발열과 기침인데, 현재 발열은 열화상 카메라를 이용해 직접 접촉을 하지 않고도 체온을 쉽게 판별할 수 있다. 문제는 비접촉방식으로는 기침하는 사람의 증상을 쉽사리 파악하기 어렵다는 점이다. 박 교수 연구팀은 이런 문제를 해결하기 위해 기침 소리를 실시간으로 인식하는 딥러닝 기반의 기침 인식 모델을 개발했다. 또한 열화상 카메라와 같은 원리로 기침 소리와 기침하는 사람의 시각화를 위해 기침 인식 모델을 음향 카메라에 적용, 기침 소리와 기침하는 사람의 위치, 심지어 기침 횟수까지를 실시간으로 추적하고 기록이 가능한 '기침 인식 카메라'를 개발했다.

연구팀은 기침 인식 카메라가 사람이 밀집한 공공장소에서 전염병의 유행을 감지하거나 병원에서 환자의 상태를 상시 모니터링 가능한 의료용 장비로 활용될 것으로 기대하고 있다.

연구팀은 기침 인식 모델 개발을 위해 *합성 곱 신경망(convolutional neural network, CNN)을 기반으로 *지도학습(supervised learning)을 적용했다. 1초 길이 음향신호의 특징(feature)을 입력 신호로 받아, 1(기침) 또는 0(그 외)의 2진 신호를 출력하고 학습률의 최적화를 위해 일정 기간 학습률이 정체되면 학습률 값을 낮추도록 설정했다.

이어서 기침 인식 모델의 훈련 및 평가를 위해 구글과 유튜브 등에서 연구용으로 활발히 사용 중인 공개 음성데이터 세트인 `오디오세트(Audioset)'를 비롯해 `디맨드(DEMAND)'와 `이티에스아이(ETSI)', `티미트(TIMIT)' 등에서 데이터 세트를 수집했다. 이 중 `오디오세트'는 훈련 및 평가 데이터 세트 구성을 위해 사용했고 다른 데이터 세트의 경우 기침 인식 모델이 다양한 배경 소음을 학습할 수 있도록 데이터 증강(data augmentation)을 위한 배경 소음으로 사용했다.

☞ 합성 곱 신경망(convolutional neural network): 시각적 이미지를 분석하는 데 사용되는 인공신경망(생물학의 신경망에서 영감을 얻은 통계학적 학습 알고리즘)의 한 종류

☞ 지도학습(Supervised Learning): 훈련 데이터(Training Data)로부터 하나의 함수를 유추해내기 위한 기계 학습(Machine Learning)의 한 방법

데이터 증강을 위해 배경 소음을 15%~75%의 비율로 `오디오세트'에 섞은 후, 다양한 거리에 적응할 수 있게 음량을 0.25~1.0배로 조정했다. 훈련 및 평가 데이터 세트는 증강된 데이터 세트를 9:1 비율로 나눠 구성했으며, 시험 데이터 세트는 따로 사무실에서 녹음한 것을 사용했다.

모델 최적화를 위해서는 '스펙트로그램(spectrogram)' 등 5개의 음향 특징과 7개의 최적화 기기(optimizer)를 사용해 학습을 진행하고 시험 데이터 세트의 정확도를 측정, 성능을 확인한 결과 87.4%의 시험 정확도를 얻을 수 있었다.

연구팀은 이어 학습된 기침 인식 모델을 소리를 수집하는 마이크로폰 어레이와 카메라 모듈로 구성되는 음향 카메라에 적용했다. 그 결과 수집된 데이터는 음원의 위치를 계산하는 빔 형성 과정을 거쳐 기침 인식 모델이 기침 소리로 인식할 경우 기침 소리가 난 위치에 기침 소리임을 나타내는 등고선과 라벨이 각각 표시된다.

박 교수팀은 마지막 단계로 기침 인식 카메라의 예비 테스트를 진행한 결과, 여러 잡음 환경에서도 기침 소리와 그 이외의 소리로 구분이 가능하며 기침하는 사람과 그 사람의 위치, 횟수 등을 실시간으로 추적해 현장에서의 적용 가능성을 확인했다. 이들은 추후 병원 등 실사용 환경에서 추가 학습이 이뤄진다면 정확도는 87.4%보다 더 높아질 것으로 기대하고 있다.

박용화 교수는 "코로나19가 지속적으로 전파되고 있는 상황에서 공공장소와 다수 밀집 시설에 기침 인식 카메라를 활용하면 전염병의 방역 및 조기 감지에 큰 도움이 될 것ˮ이라고 말했다. 박 교수는 이어 "특히 병실에 적용하면 환자의 상태를 24시간 기록해 치료에 활용할 수 있기 때문에 의료진의 수고를 줄이고 환자 상태를 더 정밀하게 파악할 수 있을 것ˮ 이라고 강조했다.

한편, 이번 연구는 에너지기술평가원(산업통상자원부)의 지원을 받아 수행됐다.

2020.08.03 조회수 32180 -

해상도 높인 곤충 눈 구조 초박형 카메라 개발

바이오및뇌공학과 정기훈 교수 연구팀이 고해상도 이미징을 위한 곤충 눈 구조의 초박형 카메라를 개발했다. 이 카메라는 독특한 시각 구조를 가진 제노스 페키(Xenos peckii)라는 곤충의 눈을 모사해 개발돼, 상용 카메라보다 더 얇은 렌즈 두께와 넓은 광시야각을 갖는다. 이러한 특징을 이용해 모바일, 감시 및 정찰 장비, 의료영상 기기 등 다양한 소형 카메라가 필요한 분야에 적용 가능할 것으로 기대된다.

김기수 박사과정이 주도한 이번 연구결과는 국제 학술지 ‘빛 : 과학과 응용 (Light : Science & Applications)’ 2월 27일 자 온라인판에 게재됐다. (논문명: 고대비 고해상도 이미징을 위한 생체모사 초박형 카메라, Biologically Inspired Ultrathin Arrayed Camera for High Contrast and High Resolution Imaging)

최근 초소형 및 초박형 스마트 기기의 개발로 소형화된 이미징 시스템의 수요가 커지고 있다. 그러나 기존의 카메라는 물체의 상이 일그러지거나 흐려지는 현상인 수차를 줄이기 위해 다층 렌즈 구조를 활용하기 때문에 렌즈 두께를 감소하는 데 한계가 있다. 또한, 기존의 곤충 눈을 모사한 미세렌즈 배열(Microlens arrays)은 렌즈 사이의 광학 크로스토크(Optical crosstalk)로 인해 해상도가 저해되는 단점이 있다.

연구팀은 문제 해결을 위해 제노스 페키 곤충의 시각 구조를 모사한 렌즈를 제작했고 이를 이미지 센서와 결합해 초박형 카메라를 개발했다. 곤충의 눈은 렌즈와 렌즈 사이의 빛을 차단하는 색소 세포(pigment cells)가 존재해 각 렌즈에서 결상(어떤 물체에서 나온 광선 등이 반사 굴절한 다음 다시 모여 그 물체와 닮은꼴의 상을 만드는 현상)되는 영상들 간의 간섭을 막는다. 이러한 구조는 렌즈들 사이의 광학 크로스토크를 막아 고 대비 및 고해상도 영상을 획득하는 데 도움을 준다.

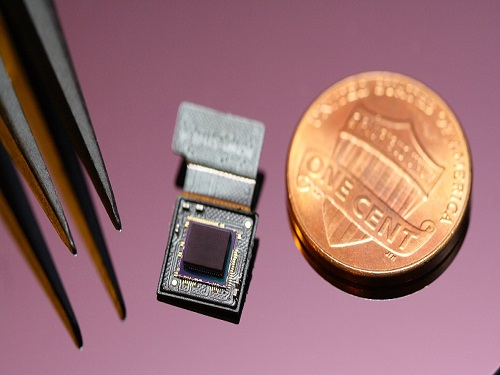

연구팀은 이러한 광 차단 구조를 포토리소그래피(Photolithography) 공정으로 매우 얇게 제작해 렌즈들 사이의 광학 크로스토크를 효율적으로 차단했다. 렌즈의 두께를 최소화하기 위해 렌즈의 방향을 이미지 센서 방향인 역방향으로 배치했으며, 이를 통해 최종 개발된 카메라 렌즈의 두께는 0.74mm로 이는 10원짜리 동전 절반 정도의 두께이다. 연구팀은 카메라의 원거리에 있는 물체를 모든 렌즈에서 같은 시야각을 통해 동일한 영상을 획득하고, 이 배열 영상들은 해상도를 하나의 이미지로 합성했다. 합성된 영상은 합성 전 단일 채널 영상보다 향상된 해상도를 가짐을 확인했다.

정기훈 교수는 “실질적으로 상용화 가능한 초박형 카메라를 제작하는 방법을 개발했다”라며 “이 카메라는 영상획득이 필요한 장치에 통합돼 장치 소형화에 크게 기여할 것으로 확신한다”라고 말했다.

2020.03.23 조회수 21381

해상도 높인 곤충 눈 구조 초박형 카메라 개발

바이오및뇌공학과 정기훈 교수 연구팀이 고해상도 이미징을 위한 곤충 눈 구조의 초박형 카메라를 개발했다. 이 카메라는 독특한 시각 구조를 가진 제노스 페키(Xenos peckii)라는 곤충의 눈을 모사해 개발돼, 상용 카메라보다 더 얇은 렌즈 두께와 넓은 광시야각을 갖는다. 이러한 특징을 이용해 모바일, 감시 및 정찰 장비, 의료영상 기기 등 다양한 소형 카메라가 필요한 분야에 적용 가능할 것으로 기대된다.

김기수 박사과정이 주도한 이번 연구결과는 국제 학술지 ‘빛 : 과학과 응용 (Light : Science & Applications)’ 2월 27일 자 온라인판에 게재됐다. (논문명: 고대비 고해상도 이미징을 위한 생체모사 초박형 카메라, Biologically Inspired Ultrathin Arrayed Camera for High Contrast and High Resolution Imaging)

최근 초소형 및 초박형 스마트 기기의 개발로 소형화된 이미징 시스템의 수요가 커지고 있다. 그러나 기존의 카메라는 물체의 상이 일그러지거나 흐려지는 현상인 수차를 줄이기 위해 다층 렌즈 구조를 활용하기 때문에 렌즈 두께를 감소하는 데 한계가 있다. 또한, 기존의 곤충 눈을 모사한 미세렌즈 배열(Microlens arrays)은 렌즈 사이의 광학 크로스토크(Optical crosstalk)로 인해 해상도가 저해되는 단점이 있다.

연구팀은 문제 해결을 위해 제노스 페키 곤충의 시각 구조를 모사한 렌즈를 제작했고 이를 이미지 센서와 결합해 초박형 카메라를 개발했다. 곤충의 눈은 렌즈와 렌즈 사이의 빛을 차단하는 색소 세포(pigment cells)가 존재해 각 렌즈에서 결상(어떤 물체에서 나온 광선 등이 반사 굴절한 다음 다시 모여 그 물체와 닮은꼴의 상을 만드는 현상)되는 영상들 간의 간섭을 막는다. 이러한 구조는 렌즈들 사이의 광학 크로스토크를 막아 고 대비 및 고해상도 영상을 획득하는 데 도움을 준다.

연구팀은 이러한 광 차단 구조를 포토리소그래피(Photolithography) 공정으로 매우 얇게 제작해 렌즈들 사이의 광학 크로스토크를 효율적으로 차단했다. 렌즈의 두께를 최소화하기 위해 렌즈의 방향을 이미지 센서 방향인 역방향으로 배치했으며, 이를 통해 최종 개발된 카메라 렌즈의 두께는 0.74mm로 이는 10원짜리 동전 절반 정도의 두께이다. 연구팀은 카메라의 원거리에 있는 물체를 모든 렌즈에서 같은 시야각을 통해 동일한 영상을 획득하고, 이 배열 영상들은 해상도를 하나의 이미지로 합성했다. 합성된 영상은 합성 전 단일 채널 영상보다 향상된 해상도를 가짐을 확인했다.

정기훈 교수는 “실질적으로 상용화 가능한 초박형 카메라를 제작하는 방법을 개발했다”라며 “이 카메라는 영상획득이 필요한 장치에 통합돼 장치 소형화에 크게 기여할 것으로 확신한다”라고 말했다.

2020.03.23 조회수 21381 -

정기훈 교수, 곤충 눈 구조 모방한 초박형 카메라 개발

〈 왼쪽부터 장경원 박사과정, 정기훈 교수, 황순홍 박사과정 〉

우리 대학 바이오및뇌공학과 정기훈 교수 연구팀이 독특한 눈 구조를 가진 곤충인 제노스 페키(Xenos peckii)를 모사한 초박형 디지털카메라를 개발했다.

제노스 페키를 모사해 개발한 초박형 디지털카메라는 기존 이미징 시스템보다 더 얇으면서 상대적으로 넓은 광시야각과 높은 분해능을 갖는다. 감시 및 정찰 장비, 의료용 영상기기, 모바일 등 다양한 소형 이미징 시스템에 적용 가능할 것으로 기대된다.

금동민, 장경원 박사과정이 주도한 이번 연구결과는 국제 학술지 ‘빛 : 과학과 응용(Light : Science & Applications)’ 10월 24일 자에 게재됐다. (논문명: 제노스 페키의 시각기관을 모사한 초박형 디지털카메라, Xenos peckii vision inspires an ultrathin digital camera)

정 교수 연구팀은 자연계에서 발견되는 광학 구조를 모방하는 연구를 꾸준히 진행해 왔다. 반딧불이의 배 마디 구조를 분석해 광효율을 높은 LED 렌즈를 개발한 바 있고, 생체모사를 통한 무반사 기판을 제작하는 등 해당 분야를 선도하고 있다.

최근 전자기기 및 광학기기의 소형화로 초박형 디지털카메라에 대한 수요가 증가하고 있다. 그러나 기존의 카메라 모듈은 광학적 수차를 줄이기 위해 광축을 따라 복수의 렌즈로 구성돼 있어 부피가 매우 크다는 단점이 있다. 이런 모듈을 단순히 크기만 줄여 소형기기에 적용하면 분해능과 감도가 떨어지게 된다.

연구팀은 문제 해결을 위해 곤충인 제노스 페키의 시각구조를 적용한 렌즈를 제작했고 이를 이미지 센서와 결합한 초박형 디지털카메라를 개발했다.

곤충의 겹눈구조는 수백, 수천 개의 오마티디아라 불리는 아주 작은 광학 구조로 이뤄져 있다. 일반적인 겹눈구조는 수백, 수천 개의 오마티디아에서 한 개의 영상을 얻지만, 제노스 페키는 다른 곤충과는 달리 각 오마티디아에서 개별의 영상을 획득할 수 있다. 또한 오마티디아 사이에 빛을 흡수할 수 있는 독특한 구조를 가져 각 영상 간 간섭을 막는다.

연구팀이 개발한 카메라는 2mm 이내의 매우 작은 크기로 제노스 페키의 겹눈구조를 모방해 수십 개의 마이크로프리즘 어레이와 마이크로렌즈 어레이로 구성된다. 마이크로프리즘과 마이크로렌즈가 한 쌍으로 채널을 이루고 있으며 각각의 채널 사이에는 빛을 흡수하는 중합체가 존재하며 각 채널 간 간섭을 막는다.

각각의 채널은 화면의 다른 부분들을 보고 있으며 각 채널에서 관측된 영상들은 영상처리를 통해 하나의 영상으로 복원돼 넓은 광시야각과 높은 분해능을 확보할 수 있다.

정기훈 교수는 “초박형 카메라를 제작하는 새로운 방법을 제시했다”며 “이 연구는 기존의 평면 CMOS 이미지 센서 어레이에 마이크로 카메라를 완전히 장착한 초박형 곤충 눈 카메라의 첫 번째 데모이며 다양한 광학 분야에 큰 영향을 미칠 것으로 확신한다.”라고 말했다.

□ 그림 설명

그림1. (좌) 제노스 페키의 SEM 영상. (우) 형광 염색된 제노스 페키의 시각구조

그림2. (좌) MEMS 공정을 통해 제작된 마이크로프리즘 어레이의 SEM 영상. (우) 완성된 초박형 디지털 카메라의 광학 영상

그림3. (좌) Xenos peckii의 시각기관을 통해 얻은 영상. (우) 초박형 디지털 카메라를 통해 얻은 영상

2018.11.20 조회수 11763

정기훈 교수, 곤충 눈 구조 모방한 초박형 카메라 개발

〈 왼쪽부터 장경원 박사과정, 정기훈 교수, 황순홍 박사과정 〉

우리 대학 바이오및뇌공학과 정기훈 교수 연구팀이 독특한 눈 구조를 가진 곤충인 제노스 페키(Xenos peckii)를 모사한 초박형 디지털카메라를 개발했다.

제노스 페키를 모사해 개발한 초박형 디지털카메라는 기존 이미징 시스템보다 더 얇으면서 상대적으로 넓은 광시야각과 높은 분해능을 갖는다. 감시 및 정찰 장비, 의료용 영상기기, 모바일 등 다양한 소형 이미징 시스템에 적용 가능할 것으로 기대된다.

금동민, 장경원 박사과정이 주도한 이번 연구결과는 국제 학술지 ‘빛 : 과학과 응용(Light : Science & Applications)’ 10월 24일 자에 게재됐다. (논문명: 제노스 페키의 시각기관을 모사한 초박형 디지털카메라, Xenos peckii vision inspires an ultrathin digital camera)

정 교수 연구팀은 자연계에서 발견되는 광학 구조를 모방하는 연구를 꾸준히 진행해 왔다. 반딧불이의 배 마디 구조를 분석해 광효율을 높은 LED 렌즈를 개발한 바 있고, 생체모사를 통한 무반사 기판을 제작하는 등 해당 분야를 선도하고 있다.

최근 전자기기 및 광학기기의 소형화로 초박형 디지털카메라에 대한 수요가 증가하고 있다. 그러나 기존의 카메라 모듈은 광학적 수차를 줄이기 위해 광축을 따라 복수의 렌즈로 구성돼 있어 부피가 매우 크다는 단점이 있다. 이런 모듈을 단순히 크기만 줄여 소형기기에 적용하면 분해능과 감도가 떨어지게 된다.

연구팀은 문제 해결을 위해 곤충인 제노스 페키의 시각구조를 적용한 렌즈를 제작했고 이를 이미지 센서와 결합한 초박형 디지털카메라를 개발했다.

곤충의 겹눈구조는 수백, 수천 개의 오마티디아라 불리는 아주 작은 광학 구조로 이뤄져 있다. 일반적인 겹눈구조는 수백, 수천 개의 오마티디아에서 한 개의 영상을 얻지만, 제노스 페키는 다른 곤충과는 달리 각 오마티디아에서 개별의 영상을 획득할 수 있다. 또한 오마티디아 사이에 빛을 흡수할 수 있는 독특한 구조를 가져 각 영상 간 간섭을 막는다.

연구팀이 개발한 카메라는 2mm 이내의 매우 작은 크기로 제노스 페키의 겹눈구조를 모방해 수십 개의 마이크로프리즘 어레이와 마이크로렌즈 어레이로 구성된다. 마이크로프리즘과 마이크로렌즈가 한 쌍으로 채널을 이루고 있으며 각각의 채널 사이에는 빛을 흡수하는 중합체가 존재하며 각 채널 간 간섭을 막는다.

각각의 채널은 화면의 다른 부분들을 보고 있으며 각 채널에서 관측된 영상들은 영상처리를 통해 하나의 영상으로 복원돼 넓은 광시야각과 높은 분해능을 확보할 수 있다.

정기훈 교수는 “초박형 카메라를 제작하는 새로운 방법을 제시했다”며 “이 연구는 기존의 평면 CMOS 이미지 센서 어레이에 마이크로 카메라를 완전히 장착한 초박형 곤충 눈 카메라의 첫 번째 데모이며 다양한 광학 분야에 큰 영향을 미칠 것으로 확신한다.”라고 말했다.

□ 그림 설명

그림1. (좌) 제노스 페키의 SEM 영상. (우) 형광 염색된 제노스 페키의 시각구조

그림2. (좌) MEMS 공정을 통해 제작된 마이크로프리즘 어레이의 SEM 영상. (우) 완성된 초박형 디지털 카메라의 광학 영상

그림3. (좌) Xenos peckii의 시각기관을 통해 얻은 영상. (우) 초박형 디지털 카메라를 통해 얻은 영상

2018.11.20 조회수 11763 -

김상욱 교수, 카메라 플래시로 7나노미터 반도체 패턴 제작 기술 개발

〈 김상욱 교수, 진형민 연구원 〉

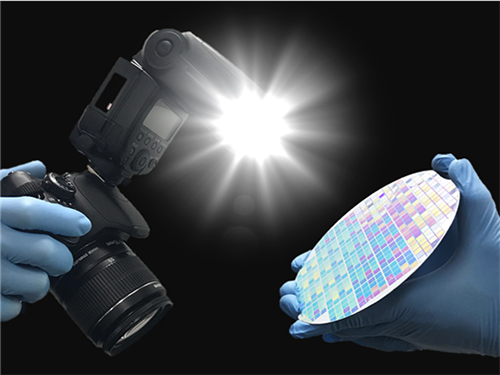

우리 대학 신소재공학과 김상욱 교수 연구팀이 카메라의 플래시를 이용해 반도체를 제작하는 기술을 개발했다.

이 기술은 반도체용 7나노미터 패턴 기법으로 한 번의 플래시를 조사하는 것만으로 대면적에서 초미세 패턴을 제작할 수 있다. 향후 고효율, 고집적 반도체 소자 제작 등에 활용 가능할 것으로 기대된다.

진형민 연구원, 박대용 박사과정이 공동 1저자로 참여한 이번 연구 결과는 국제 학술지 ‘어드밴스드 머티리얼즈(Advanced Materials)’ 8월 21일자 온라인 판에 게재됐다.

4차 산업혁명의 주요 요소인 인공지능, 사물인터넷, 빅데이터 등의 기술에는 고용량, 고성능 반도체 소자가 핵심적으로 필요하다. 이러한 차세대 고집적 반도체 소자를 만들기 위해서는 패턴을 매우 작게 형성하는 리소그래피(Lithography) 기술의 개발이 필수적이다.

현재 관련 업계에서는 작은 패턴 제작에 주로 광 리소그래피(Photolithograph) 기술을 이용하고 있다. 하지만 이 기술은 10나노미터 이하의 패턴을 형성하기엔 한계가 있다.

고분자를 이용한 분자조립 패턴 기술은 공정비용이 저렴하고 10나노미터 이하 패턴 형성이 가능해 광 리소그래피를 대신할 차세대 기술로 각광받고 있다. 그러나 고온 열처리나 유독성 증기 처리에 시간이 많이 소요되기 때문에 대량 생산이 어려워 상용화에 한계가 있다.

연구팀은 고분자 분자조립 패턴 기술의 문제 해결을 위해 순간적으로 강한 빛을 내는 카메라 플래시를 활용했다. 플래시 빛을 이용하면 15 밀리 초(1밀리 초 : 천분의 1초) 내에 7나노미터의 반도체 패턴을 구현할 수 있고, 대면적에서 수십 밀리 초의 짧은 시간 내에 수 백도의 고온을 낼 수 있다.

연구팀은 이 기술을 고분자 분자 조립에 응용해 단 한 번의 플래시를 조사하는 것으로 분자 조립 패턴을 형성할 수 있음을 증명했다.

또한 연구팀은 고온 열처리 공정이 불가능한 고분자 유연 기판에도 적용이 가능함을 확인했다. 이를 통해 차세대 유연 반도체 제작에 응용할 수 있을 것으로 보인다.

연구팀은 카메라 플래시 광열 공정을 분자 조립 기술에 도입해 분자 조립 반도체기술의 실현을 앞당길 수 있는 고효율의 기술이라고 밝혔다.

연구를 주도한 김상욱 교수는 “분자조립 반도체 기술은 그 잠재성에도 불구하고 공정효율 제고가 큰 숙제로 남아 있었다”며 “이번 기술은 분자조립기반 반도체의 실용화에 획기적 해결책이 될 것이다”고 말했다.

신소재공학과 이건재 교수, 부산대학교 재료공학과 김광호 교수와의 공동으로 진행된 이번 연구는 과학기술정보통신부 리더연구자지원사업인 다차원 나노조립제어 창의연구단과 글로벌프론티어사업의 지원을 받아 수행됐다.

□ 사진 설명

사진1. 플래시 광을 이용한 반도체 패턴 형성

사진2. 플래시 광을 이용한 분자조립 패턴 형성 모식도

사진3. 다양한 가이드 패턴을 이용한 자기조립 패턴 제어와 고분자 유연기판에서의 플래시 자기조립 패턴 형성

2017.09.13 조회수 23175

김상욱 교수, 카메라 플래시로 7나노미터 반도체 패턴 제작 기술 개발

〈 김상욱 교수, 진형민 연구원 〉

우리 대학 신소재공학과 김상욱 교수 연구팀이 카메라의 플래시를 이용해 반도체를 제작하는 기술을 개발했다.

이 기술은 반도체용 7나노미터 패턴 기법으로 한 번의 플래시를 조사하는 것만으로 대면적에서 초미세 패턴을 제작할 수 있다. 향후 고효율, 고집적 반도체 소자 제작 등에 활용 가능할 것으로 기대된다.

진형민 연구원, 박대용 박사과정이 공동 1저자로 참여한 이번 연구 결과는 국제 학술지 ‘어드밴스드 머티리얼즈(Advanced Materials)’ 8월 21일자 온라인 판에 게재됐다.

4차 산업혁명의 주요 요소인 인공지능, 사물인터넷, 빅데이터 등의 기술에는 고용량, 고성능 반도체 소자가 핵심적으로 필요하다. 이러한 차세대 고집적 반도체 소자를 만들기 위해서는 패턴을 매우 작게 형성하는 리소그래피(Lithography) 기술의 개발이 필수적이다.

현재 관련 업계에서는 작은 패턴 제작에 주로 광 리소그래피(Photolithograph) 기술을 이용하고 있다. 하지만 이 기술은 10나노미터 이하의 패턴을 형성하기엔 한계가 있다.

고분자를 이용한 분자조립 패턴 기술은 공정비용이 저렴하고 10나노미터 이하 패턴 형성이 가능해 광 리소그래피를 대신할 차세대 기술로 각광받고 있다. 그러나 고온 열처리나 유독성 증기 처리에 시간이 많이 소요되기 때문에 대량 생산이 어려워 상용화에 한계가 있다.

연구팀은 고분자 분자조립 패턴 기술의 문제 해결을 위해 순간적으로 강한 빛을 내는 카메라 플래시를 활용했다. 플래시 빛을 이용하면 15 밀리 초(1밀리 초 : 천분의 1초) 내에 7나노미터의 반도체 패턴을 구현할 수 있고, 대면적에서 수십 밀리 초의 짧은 시간 내에 수 백도의 고온을 낼 수 있다.

연구팀은 이 기술을 고분자 분자 조립에 응용해 단 한 번의 플래시를 조사하는 것으로 분자 조립 패턴을 형성할 수 있음을 증명했다.

또한 연구팀은 고온 열처리 공정이 불가능한 고분자 유연 기판에도 적용이 가능함을 확인했다. 이를 통해 차세대 유연 반도체 제작에 응용할 수 있을 것으로 보인다.

연구팀은 카메라 플래시 광열 공정을 분자 조립 기술에 도입해 분자 조립 반도체기술의 실현을 앞당길 수 있는 고효율의 기술이라고 밝혔다.

연구를 주도한 김상욱 교수는 “분자조립 반도체 기술은 그 잠재성에도 불구하고 공정효율 제고가 큰 숙제로 남아 있었다”며 “이번 기술은 분자조립기반 반도체의 실용화에 획기적 해결책이 될 것이다”고 말했다.

신소재공학과 이건재 교수, 부산대학교 재료공학과 김광호 교수와의 공동으로 진행된 이번 연구는 과학기술정보통신부 리더연구자지원사업인 다차원 나노조립제어 창의연구단과 글로벌프론티어사업의 지원을 받아 수행됐다.

□ 사진 설명

사진1. 플래시 광을 이용한 반도체 패턴 형성

사진2. 플래시 광을 이용한 분자조립 패턴 형성 모식도

사진3. 다양한 가이드 패턴을 이용한 자기조립 패턴 제어와 고분자 유연기판에서의 플래시 자기조립 패턴 형성

2017.09.13 조회수 23175