%EC%A0%95%EB%B3%B4%ED%86%B5%EC%8B%A0%EA%B8%B0%EC%88%A0%EC%A7%84%ED%9D%A5%EC%84%BC%ED%84%B0

-

이상완 교수, 신경과학-인공지능 융합으로 공학적 난제 해결

〈 (왼쪽부터) 안수진 박사과정, 이지항 박사, 이상완 교수 〉

우리 대학 바이오및뇌공학과 이상완 교수 연구팀이 영국 케임브리지 대학, 구글 딥마인드와의 공동 연구를 통해 차세대 뇌 기반 인공지능 시스템 설계의 방향을 제시했다.

이번 연구는 인간의 두뇌가 기존의 인공지능 알고리즘이 해결하지 못하는 부분을 해결할 수 있다는 사실에 기반한 신경과학-인공지능 융합 연구이다.

성능, 효율, 속도의 균형적 설계와 같은 다양한 공학적 난제를 해결할 수 있는 신경과학 기반 강화학습 이론을 제안한 것으로 새로운 인공지능 알고리즘 설계에 긍정적인 영향을 줄 것으로 기대된다.

이상완 교수와 함께 이지항 박사, 안수진 박사과정이 주도한 이번 연구는 국제 학술지 사이언스의 자매지 ‘사이언스 로보틱스(Science Robotics)’ 1월 16일 자 온라인판에 포커스 형식으로 게재됐다.

최적제어 이론에서 출발한 강화학습은 기계 학습의 한 영역으로 지난 20여 년 동안 꾸준히 연구된 분야이다. 특히 지난 5년 동안은 딥러닝 기술을 발전과 맞물려 급격한 성장을 이뤘다.

딥러닝 기반 강화학습 알고리즘은 최근 알파고와 같은 전략 탐색 문제, 로봇 제어, 응급실 비상 대응 시스템과 같은 의료 진단 등 다양한 분야에 적용되고 있다. 그러나 주어진 문제에 맞게 시스템을 설계해야 하는 점, 불확실성이 높은 환경에서는 성능이 보장되지 않는 점 등이 근본적인 해결책으로 남아있다.

강화학습은 의사 결정 및 계산신경과학 분야에서도 지난 20년간 꾸준히 연구되고 있다. 이상완 교수는 2014년 인간의 전두엽-기저핵 뇌 회로에서 이종 강화학습을 제어한다는 신경과학적 증거를 학계에 발표한 바 있다. 2015년에는 같은 뇌 회로에서 고속 추론 과정을 제어한다는 연구를 발표했다.

연구팀은 이번 연구에서 강화학습 등의 개별 인공지능 알고리즘이 해결하지 못하는 공학적 문제를 인간의 두뇌가 이미 해결하고 있다는 사실에 기반한 ‘전두엽 메타 제어’ 이론을 제안했다.

중뇌 도파민-복외측전전두피질 네트워크에서 외부 환경에 대한 학습의 신뢰도를 스스로 평가할 수 있는 보상 예측 신호나 상태 예측 신호와 같은 정보를 처리하며, 인간의 두뇌는 이 정보들을 경쟁적-협력적으로 통합하는 프로세스를 통해 외부 환경에 가장 적합한 학습 및 추론 전략을 찾는다는 것이 이론의 핵심이다.

이러한 원리를 단일 인공지능 알고리즘이나 로봇설계에 적용하면 외부 상황변화에 강인하게 성능, 효율, 속도 세 조건(performance-efficiency-speed tradeoff) 사이의 균형점을 유지하는 최적의 제어 시스템을 설계할 수 있다. 더 나아가 다수의 인공지능 개체가 협력하는 상황에서는 서로의 전략을 이용함으로 협력-경쟁 사이의 균형점을 유지할 수 있다.

1 저자인 이지항 박사는 “현대 인공지능의 우수한 성능은 사람의 행동 수준 관찰뿐 아니라 두뇌의 저수준 신경 시스템을 알고리즘으로 구현해 적극적으로 발전시킨 결과라고 보고 있다”라며 “이번 연구는 계산신경과학에 기반한 결과로 현대 딥러닝과 강화학습에서 겪는 성능, 효율, 속도 사이의 난제를 해결하는 실마리가 될 수 있고, 새로운 인공지능 알고리즘 설계에 많은 영감을 줄 것이다”라고 말했다.

이상완 교수는 “연구를 하다 보면 우리의 두뇌는 공학적 난제를 의외로 쉽게 해결하고 있음을 알 수 있다. 이 원리를 인공지능 알고리즘 설계에 적용하는 뇌 기반 인공지능 연구는 구글 딥마인드, MIT, 캘리포니아 공과대학, UCL 등 해외 유수 기관에서도 관심을 두는 신경과학-인공지능 융합 연구 분야이다”라며 “장기적으로는 차세대 인공지능 핵심 연구 분야 중의 하나로 자리를 잡을 것으로 기대한다”라고 말했다.

이번 연구는 과학기술정보통신부 및 정보통신기술진흥센터 연구개발 사업, 삼성전자 미래기술육성센터의 지원을 받아 수행됐다.

□ 그림 설명

그림1. 외부 환경에 따라 성능-효율-속도 문제 균형점을 찾는 뇌기반 강화학습 이론 (좌), 이를 최적 제어하는 ‘전두엽 메타 제어’(중) 및 로보틱스 분야 문제 해결 적용 사례 (우)

2019.01.24 조회수 13750

이상완 교수, 신경과학-인공지능 융합으로 공학적 난제 해결

〈 (왼쪽부터) 안수진 박사과정, 이지항 박사, 이상완 교수 〉

우리 대학 바이오및뇌공학과 이상완 교수 연구팀이 영국 케임브리지 대학, 구글 딥마인드와의 공동 연구를 통해 차세대 뇌 기반 인공지능 시스템 설계의 방향을 제시했다.

이번 연구는 인간의 두뇌가 기존의 인공지능 알고리즘이 해결하지 못하는 부분을 해결할 수 있다는 사실에 기반한 신경과학-인공지능 융합 연구이다.

성능, 효율, 속도의 균형적 설계와 같은 다양한 공학적 난제를 해결할 수 있는 신경과학 기반 강화학습 이론을 제안한 것으로 새로운 인공지능 알고리즘 설계에 긍정적인 영향을 줄 것으로 기대된다.

이상완 교수와 함께 이지항 박사, 안수진 박사과정이 주도한 이번 연구는 국제 학술지 사이언스의 자매지 ‘사이언스 로보틱스(Science Robotics)’ 1월 16일 자 온라인판에 포커스 형식으로 게재됐다.

최적제어 이론에서 출발한 강화학습은 기계 학습의 한 영역으로 지난 20여 년 동안 꾸준히 연구된 분야이다. 특히 지난 5년 동안은 딥러닝 기술을 발전과 맞물려 급격한 성장을 이뤘다.

딥러닝 기반 강화학습 알고리즘은 최근 알파고와 같은 전략 탐색 문제, 로봇 제어, 응급실 비상 대응 시스템과 같은 의료 진단 등 다양한 분야에 적용되고 있다. 그러나 주어진 문제에 맞게 시스템을 설계해야 하는 점, 불확실성이 높은 환경에서는 성능이 보장되지 않는 점 등이 근본적인 해결책으로 남아있다.

강화학습은 의사 결정 및 계산신경과학 분야에서도 지난 20년간 꾸준히 연구되고 있다. 이상완 교수는 2014년 인간의 전두엽-기저핵 뇌 회로에서 이종 강화학습을 제어한다는 신경과학적 증거를 학계에 발표한 바 있다. 2015년에는 같은 뇌 회로에서 고속 추론 과정을 제어한다는 연구를 발표했다.

연구팀은 이번 연구에서 강화학습 등의 개별 인공지능 알고리즘이 해결하지 못하는 공학적 문제를 인간의 두뇌가 이미 해결하고 있다는 사실에 기반한 ‘전두엽 메타 제어’ 이론을 제안했다.

중뇌 도파민-복외측전전두피질 네트워크에서 외부 환경에 대한 학습의 신뢰도를 스스로 평가할 수 있는 보상 예측 신호나 상태 예측 신호와 같은 정보를 처리하며, 인간의 두뇌는 이 정보들을 경쟁적-협력적으로 통합하는 프로세스를 통해 외부 환경에 가장 적합한 학습 및 추론 전략을 찾는다는 것이 이론의 핵심이다.

이러한 원리를 단일 인공지능 알고리즘이나 로봇설계에 적용하면 외부 상황변화에 강인하게 성능, 효율, 속도 세 조건(performance-efficiency-speed tradeoff) 사이의 균형점을 유지하는 최적의 제어 시스템을 설계할 수 있다. 더 나아가 다수의 인공지능 개체가 협력하는 상황에서는 서로의 전략을 이용함으로 협력-경쟁 사이의 균형점을 유지할 수 있다.

1 저자인 이지항 박사는 “현대 인공지능의 우수한 성능은 사람의 행동 수준 관찰뿐 아니라 두뇌의 저수준 신경 시스템을 알고리즘으로 구현해 적극적으로 발전시킨 결과라고 보고 있다”라며 “이번 연구는 계산신경과학에 기반한 결과로 현대 딥러닝과 강화학습에서 겪는 성능, 효율, 속도 사이의 난제를 해결하는 실마리가 될 수 있고, 새로운 인공지능 알고리즘 설계에 많은 영감을 줄 것이다”라고 말했다.

이상완 교수는 “연구를 하다 보면 우리의 두뇌는 공학적 난제를 의외로 쉽게 해결하고 있음을 알 수 있다. 이 원리를 인공지능 알고리즘 설계에 적용하는 뇌 기반 인공지능 연구는 구글 딥마인드, MIT, 캘리포니아 공과대학, UCL 등 해외 유수 기관에서도 관심을 두는 신경과학-인공지능 융합 연구 분야이다”라며 “장기적으로는 차세대 인공지능 핵심 연구 분야 중의 하나로 자리를 잡을 것으로 기대한다”라고 말했다.

이번 연구는 과학기술정보통신부 및 정보통신기술진흥센터 연구개발 사업, 삼성전자 미래기술육성센터의 지원을 받아 수행됐다.

□ 그림 설명

그림1. 외부 환경에 따라 성능-효율-속도 문제 균형점을 찾는 뇌기반 강화학습 이론 (좌), 이를 최적 제어하는 ‘전두엽 메타 제어’(중) 및 로보틱스 분야 문제 해결 적용 사례 (우)

2019.01.24 조회수 13750 -

한동수, 신진우 교수, 느린 인터넷 환경에서도 고화질 영상 감상 기술 개발

〈 (왼쪽부터) 김재홍, 정영목 석사과정, 여현호 박사과정, 한동수, 신진우 교수 〉

우리 대학 전기및전자공학부 신진우, 한동수 교수 연구팀이 딥러닝 기술을 이용한 인터넷 비디오 전송 기술을 개발했다.

여현호, 정영목, 김재홍 학생이 주도한 이번 연구 결과는 격년으로 개최되는 컴퓨터 시스템 분야의 유명 학술회의인 ‘유즈닉스 OSDI(USENIX OSDI)’에서 10월 10일 발표됐고 현재 국제 특허 출원을 완료했다.

이 기술은 유튜브, 넷플릭스 등에서 비디오를 사용자에게 전송할 때 사용하는 적응형 스트리밍(HTTP adaptive streaming) 비디오 전송기술과 딥러닝 기술인 심층 콘볼루션 신경망(CNN) 기반의 초해상화를 접목한 새로운 방식이다.

이는 열악한 인터넷 환경에서도 고품질, 고화질(HD)의 비디오 시청이 가능할 뿐 아니라 4K, AV/VR 등을 시청할 수 있는 새로운 기반 기술이 될 것으로 기대된다.

기존의 적응형 스트리밍은 시시각각 변화하는 인터넷 대역폭에 맞춰 스트리밍 중인 비디오 화질을 실시간으로 조절한다. 이를 위해 다양한 알고리즘이 연구되고 있으나 네트워크 환경이 좋지 않을 때는 어느 알고리즘이라도 고화질의 비디오를 감상할 수 없다는 한계가 있다.

연구팀은 적응형 스트리밍에 초해상화를 접목해 인터넷 대역폭에 의존하는 기존 적응형 스트리밍의 한계를 극복했다. 기존 기술은 비디오를 시청 시 긴 영상을 짧은 시간의 여러 비디오 조각으로 나눠 다운받는다. 이를 위해 비디오를 제공하는 서버에서는 비디오를 미리 일정 시간 길이로 나눠 준비해놓는 방식이다.

연구팀이 새롭게 개발한 시스템은 추가로 신경망 조각을 비디오 조각과 같이 다운받게 했다. 이를 위해 비디오 서버에서는 각 비디오에 대해 학습이 된 신경망을 제공하며 또 사용자 컴퓨터의 사양을 고려해 다양한 크기의 신경망을 제공한다.

제일 큰 신경망의 크기는 총 2메가바이트(MB)이며 비디오에 비해 상당히 작은 크기이다. 신경망을 사용자 비디오 플레이어에서 다운받을 때는 여러 개의 조각으로 나눠 다운받으며 신경망의 일부만 다운받아도 조금 떨어지는 성능의 초해상화 기술을 이용할 수 있도록 설계했다.

사용자의 컴퓨터에서는 동영상 시청과 함께 병렬적으로 심층 콘볼루션 신경망(CNN) 기반의 초해상화 기술을 사용해 비디오 플레이어 버퍼에 저장된 저화질 비디오를 고화질로 바꾸게 된다. 모든 과정은 실시간으로 이뤄지며 이를 통해 사용자들이 고화질의 비디오를 시청할 수 있다.

연구팀이 개발한 시스템을 이용하면 최대 26.9%의 적은 인터넷 대역폭으로도 최신 적응형 스트리밍과 같은 체감 품질(QoE, Quality of Experience)을 제공할 수 있다. 또한 같은 인터넷 대역폭이 주어진 경우에는 최신 적응형 스트리밍보다 평균 40% 높은 체감 품질을 제공할 수 있다.

이 시스템은 딥러닝 방식을 이용해 기존의 비디오 압축 방식보다 더 많은 압축을 이뤄낸 것으로 볼 수 있다. 연구팀의 기술은 콘볼루션 신경망 기반의 초해상화를 인터넷 비디오에 적용한 차세대 인터넷 비디오 시스템으로 권위 잇는 학회로부터 효용성을 인정받았다.

한 교수는 “지금은 데스크톱에서만 구현했지만 향후 모바일 기기에서도 작동하도록 발전시킬 예정이다”며 “이 기술은 현재 유튜브, 넷플릭스 등 스트리밍 기업에서 사용하는 비디오 전송 시스템에 적용한 것으로 실용성에 큰 의의가 있다”고 말했다.

이번 연구는 과학기술정보통신부 정보통신기술진흥센터(IITP) 방송통신연구개발 사업의 지원을 받아 수행됐다.

비디오 자료 링크 주소 1.

https://www.dropbox.com/sh/z2hvw1iv1459698/AADk3NB5EBgDhv3J4aiZo9nta?dl=0&lst =

□ 그림 설명

그림1. 기술이 적용되기 전 화질(좌)과 적용된 후 화질 비교(우)

그림2. 기술 개념도

그림3. 비디오 서버로부터 비디오가 전송된 후 저화질의 비디오가 고화질의 비디오로 변환되는 과정

2018.10.30 조회수 14623

한동수, 신진우 교수, 느린 인터넷 환경에서도 고화질 영상 감상 기술 개발

〈 (왼쪽부터) 김재홍, 정영목 석사과정, 여현호 박사과정, 한동수, 신진우 교수 〉

우리 대학 전기및전자공학부 신진우, 한동수 교수 연구팀이 딥러닝 기술을 이용한 인터넷 비디오 전송 기술을 개발했다.

여현호, 정영목, 김재홍 학생이 주도한 이번 연구 결과는 격년으로 개최되는 컴퓨터 시스템 분야의 유명 학술회의인 ‘유즈닉스 OSDI(USENIX OSDI)’에서 10월 10일 발표됐고 현재 국제 특허 출원을 완료했다.

이 기술은 유튜브, 넷플릭스 등에서 비디오를 사용자에게 전송할 때 사용하는 적응형 스트리밍(HTTP adaptive streaming) 비디오 전송기술과 딥러닝 기술인 심층 콘볼루션 신경망(CNN) 기반의 초해상화를 접목한 새로운 방식이다.

이는 열악한 인터넷 환경에서도 고품질, 고화질(HD)의 비디오 시청이 가능할 뿐 아니라 4K, AV/VR 등을 시청할 수 있는 새로운 기반 기술이 될 것으로 기대된다.

기존의 적응형 스트리밍은 시시각각 변화하는 인터넷 대역폭에 맞춰 스트리밍 중인 비디오 화질을 실시간으로 조절한다. 이를 위해 다양한 알고리즘이 연구되고 있으나 네트워크 환경이 좋지 않을 때는 어느 알고리즘이라도 고화질의 비디오를 감상할 수 없다는 한계가 있다.

연구팀은 적응형 스트리밍에 초해상화를 접목해 인터넷 대역폭에 의존하는 기존 적응형 스트리밍의 한계를 극복했다. 기존 기술은 비디오를 시청 시 긴 영상을 짧은 시간의 여러 비디오 조각으로 나눠 다운받는다. 이를 위해 비디오를 제공하는 서버에서는 비디오를 미리 일정 시간 길이로 나눠 준비해놓는 방식이다.

연구팀이 새롭게 개발한 시스템은 추가로 신경망 조각을 비디오 조각과 같이 다운받게 했다. 이를 위해 비디오 서버에서는 각 비디오에 대해 학습이 된 신경망을 제공하며 또 사용자 컴퓨터의 사양을 고려해 다양한 크기의 신경망을 제공한다.

제일 큰 신경망의 크기는 총 2메가바이트(MB)이며 비디오에 비해 상당히 작은 크기이다. 신경망을 사용자 비디오 플레이어에서 다운받을 때는 여러 개의 조각으로 나눠 다운받으며 신경망의 일부만 다운받아도 조금 떨어지는 성능의 초해상화 기술을 이용할 수 있도록 설계했다.

사용자의 컴퓨터에서는 동영상 시청과 함께 병렬적으로 심층 콘볼루션 신경망(CNN) 기반의 초해상화 기술을 사용해 비디오 플레이어 버퍼에 저장된 저화질 비디오를 고화질로 바꾸게 된다. 모든 과정은 실시간으로 이뤄지며 이를 통해 사용자들이 고화질의 비디오를 시청할 수 있다.

연구팀이 개발한 시스템을 이용하면 최대 26.9%의 적은 인터넷 대역폭으로도 최신 적응형 스트리밍과 같은 체감 품질(QoE, Quality of Experience)을 제공할 수 있다. 또한 같은 인터넷 대역폭이 주어진 경우에는 최신 적응형 스트리밍보다 평균 40% 높은 체감 품질을 제공할 수 있다.

이 시스템은 딥러닝 방식을 이용해 기존의 비디오 압축 방식보다 더 많은 압축을 이뤄낸 것으로 볼 수 있다. 연구팀의 기술은 콘볼루션 신경망 기반의 초해상화를 인터넷 비디오에 적용한 차세대 인터넷 비디오 시스템으로 권위 잇는 학회로부터 효용성을 인정받았다.

한 교수는 “지금은 데스크톱에서만 구현했지만 향후 모바일 기기에서도 작동하도록 발전시킬 예정이다”며 “이 기술은 현재 유튜브, 넷플릭스 등 스트리밍 기업에서 사용하는 비디오 전송 시스템에 적용한 것으로 실용성에 큰 의의가 있다”고 말했다.

이번 연구는 과학기술정보통신부 정보통신기술진흥센터(IITP) 방송통신연구개발 사업의 지원을 받아 수행됐다.

비디오 자료 링크 주소 1.

https://www.dropbox.com/sh/z2hvw1iv1459698/AADk3NB5EBgDhv3J4aiZo9nta?dl=0&lst =

□ 그림 설명

그림1. 기술이 적용되기 전 화질(좌)과 적용된 후 화질 비교(우)

그림2. 기술 개념도

그림3. 비디오 서버로부터 비디오가 전송된 후 저화질의 비디오가 고화질의 비디오로 변환되는 과정

2018.10.30 조회수 14623 -

김문철 교수, 인공지능 통해 풀HD영상 4K UHD로 실시간 변환

〈 김 문 철 교수 〉

우리 대학 전기및전자공학부 김문철 교수 연구팀이 딥러닝 기술을 이용해 풀 HD 비디오 영상을 4K UHD 초고화질 영상으로 초해상화 변환할 수 있는 기술을 개발했다.

이 기술은 인공지능의 핵심 기술인 심층 콘볼루션 신경망(Deep Convolutional Neural Network, DCNN)을 하드웨어로 구현했다. 초당 60프레임의 초고해상도 4K UHD 화면을 실시간으로 생성할 수 있는 알고리즘 및 하드웨어 개발을 통해 향후 프리미엄 UHD TV, 360 VR, 4K IPTV 등에 기여할 것으로 기대된다.

이번 연구는 KAIST 전기및전자공학부 김용우, 최재석 박사과정 등이 주도했고 현재 특허 출원을 준비 중이다.

최근 영상 화질 개선 연구에 인공지능의 핵심 기술인 심층 콘볼루션 신경망을 적용시키려는 노력이 활발히 이뤄지고 있다. 그러나 이러한 심층 콘볼루션 신경망 기술은 연산 복잡도와 매우 높고 사용되는 메모리가 커 작은 규모의 하드웨어를 통해 초고해상도 영상으로 실시간 변환하는 데 한계가 있다.

기존의 프레임 단위로 영상을 처리하던 방식은 DRAM과 같은 외부 메모리 사용이 필수적인데 이로 인해 영상 데이터를 처리할 때 지나친 외부 메모리 접근으로 인한 메모리 병목현상과 전력 소모 현상이 발생했다.

김 교수 연구팀은 프레임 단위 대신 라인 단위로 데이터를 처리할 수 있는 효율적인 심층 콘볼루션 신경망 구조를 개발해 외부 메모리를 사용하지 않고도 작은 규모의 하드웨어에서 초당 60 프레임의 4K UHD 초해상화를 구현했다.

연구팀은 기존 소프트웨어 방식의 심층 콘볼루션 신경망 기반의 고속 알고리즘과 비교해 필터 파라미터를 65% 정도만 적용하고도 유사한 화질을 유지했다.

이는 딥러닝 기술을 이용한 고해상도 영상 변환 기술이 활발히 진행되는 가운데 초당 60프레임의 4K UHD 초해상화를 하드웨어로 실현한 첫 사례로 꼽힌다.

김 교수는 “이번 연구는 심층 콘볼루션 신경망이 작은 규모의 하드웨어에서 초고품질 영상 처리에 실질적으로 응요 가능한 기술임을 보인 매우 중요한 사례다”며 “현재 프리미엄 UHD TV 및 UHD 방송 콘텐츠 생성, 360도 VR 콘텐츠, 4K IPTV 서비스에 매우 효과적으로 적용할 수 있다”고 말했다.

이번 연구는 과학기술정보통신부 정보통신기술진흥센터(IITP) ICT 기초연구실지원사업의 지원을 받아 수행됐다.

□ 그림 설명

그림1. 실시간 AI(딥러닝) 기반 고속 초고해상도 업스케일링 기술

그림2.심층 신경망 AI 기반 4K UHD 60fps 실시간 초해상화 하드웨어 (FPGA)

그림3. 심층 신경망 AI 기반 4K UHD 60fps 실시간 초해상화 하드웨어 시연

2018.01.16 조회수 22166

김문철 교수, 인공지능 통해 풀HD영상 4K UHD로 실시간 변환

〈 김 문 철 교수 〉

우리 대학 전기및전자공학부 김문철 교수 연구팀이 딥러닝 기술을 이용해 풀 HD 비디오 영상을 4K UHD 초고화질 영상으로 초해상화 변환할 수 있는 기술을 개발했다.

이 기술은 인공지능의 핵심 기술인 심층 콘볼루션 신경망(Deep Convolutional Neural Network, DCNN)을 하드웨어로 구현했다. 초당 60프레임의 초고해상도 4K UHD 화면을 실시간으로 생성할 수 있는 알고리즘 및 하드웨어 개발을 통해 향후 프리미엄 UHD TV, 360 VR, 4K IPTV 등에 기여할 것으로 기대된다.

이번 연구는 KAIST 전기및전자공학부 김용우, 최재석 박사과정 등이 주도했고 현재 특허 출원을 준비 중이다.

최근 영상 화질 개선 연구에 인공지능의 핵심 기술인 심층 콘볼루션 신경망을 적용시키려는 노력이 활발히 이뤄지고 있다. 그러나 이러한 심층 콘볼루션 신경망 기술은 연산 복잡도와 매우 높고 사용되는 메모리가 커 작은 규모의 하드웨어를 통해 초고해상도 영상으로 실시간 변환하는 데 한계가 있다.

기존의 프레임 단위로 영상을 처리하던 방식은 DRAM과 같은 외부 메모리 사용이 필수적인데 이로 인해 영상 데이터를 처리할 때 지나친 외부 메모리 접근으로 인한 메모리 병목현상과 전력 소모 현상이 발생했다.

김 교수 연구팀은 프레임 단위 대신 라인 단위로 데이터를 처리할 수 있는 효율적인 심층 콘볼루션 신경망 구조를 개발해 외부 메모리를 사용하지 않고도 작은 규모의 하드웨어에서 초당 60 프레임의 4K UHD 초해상화를 구현했다.

연구팀은 기존 소프트웨어 방식의 심층 콘볼루션 신경망 기반의 고속 알고리즘과 비교해 필터 파라미터를 65% 정도만 적용하고도 유사한 화질을 유지했다.

이는 딥러닝 기술을 이용한 고해상도 영상 변환 기술이 활발히 진행되는 가운데 초당 60프레임의 4K UHD 초해상화를 하드웨어로 실현한 첫 사례로 꼽힌다.

김 교수는 “이번 연구는 심층 콘볼루션 신경망이 작은 규모의 하드웨어에서 초고품질 영상 처리에 실질적으로 응요 가능한 기술임을 보인 매우 중요한 사례다”며 “현재 프리미엄 UHD TV 및 UHD 방송 콘텐츠 생성, 360도 VR 콘텐츠, 4K IPTV 서비스에 매우 효과적으로 적용할 수 있다”고 말했다.

이번 연구는 과학기술정보통신부 정보통신기술진흥센터(IITP) ICT 기초연구실지원사업의 지원을 받아 수행됐다.

□ 그림 설명

그림1. 실시간 AI(딥러닝) 기반 고속 초고해상도 업스케일링 기술

그림2.심층 신경망 AI 기반 4K UHD 60fps 실시간 초해상화 하드웨어 (FPGA)

그림3. 심층 신경망 AI 기반 4K UHD 60fps 실시간 초해상화 하드웨어 시연

2018.01.16 조회수 22166 -

하동수 교수, 양 날개를 개별 제어할 수 있는 드론 개발

〈 이 상 민 학생, 하 동 수 교수〉

우리 대학 조천식녹색교통대학원 하동수 교수 연구팀이 양 날개(주익[主翼], 비행기 몸체 중앙에서 양쪽으로 뻗은 날개)를 각각 분리시켜 개별적으로 제어할 수 있는 드론을 개발했다.

하 교수 연구팀이 개발한 분리형 주익 개별제어 비행체는 주익을 두 개로 완전히 분리해 별개로 제어할 수 있기 때문에 높은 에너지 효율, 기민한 운행, 작은 반경의 회전 운행이 가능하다.

우리에게 익숙한 일반항공기는 일체형 주익을 사용한다. 이는 공기 양력을 이용한 비행체이기 때문에 에너지 효율은 높지만 회전반경이 커 기민한 동작이 어렵다.

반면 여러 개의 프로펠러를 회전시켜 양력을 얻는 기존 방식은 회전반경이 작아 기민하게 동작할 수 있지만 공기 양력을 이용하지 못해 에너지 효율이 낮다.

하 교수 연구팀은 이러한 한계를 극복하기 위해 주익이 분리된 개별 제어형 비행체를 개발했다. 이는 분리된 주익의 회전을 개별적으로 제어하고 꼬리에 달린 모터의 추진방향을 바꾸는 방식으로 이를 통해 수직비행 및 수평비행의 전환을 구현했다.

주익을 분리하는 방법에는 두 가지가 있다. 몸체와 주익을 동시에 지지하는 지지대와 분리된 주익을 개별적으로 지지하는 지지대를 따로 사용하는 방식, 몸체의 측면을 주익 제어용 기기의 일부로 활용하며 개별적 지지대를 이용하는 방식이 있다.

이번에 개발한 드론은 몸체와 주익을 동시에 지지하는 지지대와 분리된 주익을 개별적으로 지지하는 지지대를 이용하는 방식으로 제작됐다.

연구팀의 기술은 원하는 운행방식에 따라 분리된 주익의 개별제어를 실행하며 제어결과는 비행체에 장착된 센서를 통해 다시 조정되는 과정을 거친다. 이러한 운행방식으로 일반 항공기가 만들 수 없는 다양한 동작이 가능해진다.

연구팀의 기술은 지난 11월 미국 우버와 나사가 발표한 도심지역 근거리 항공택시처럼 점차 보급될 중, 단거리 지역의 항공 교통에 속도, 기민성, 에너지 효율을 갖춘 비행체로 쓰일 것으로 기대된다.

하 교수는 “개발한 비행체는 민수용 항공교통, 군용 항공무기체계, 일반 안전관리 등 다양한 분야에 폭넓게 활용 가능하다”며 “주익 분리 및 독립제어는 비행 방식의 다양하고 효과적인 구현에 영향을 미친다. 2016년 설계 시점부터 한국, 미국, 중국등에 다양한 분리제어 구현방식에 대한 관련 특허를 출원했다”고 말했다.

이번 연구는 정보통신기술진흥센터의 ITRC 사업의 지원을 받아 수행됐다.

□ 그림 설명

그림1. 수직 이착륙, 수직 및 수평비행이 가능한 분리형 주익(主翼) 독립제어기술

2018.01.04 조회수 12156

하동수 교수, 양 날개를 개별 제어할 수 있는 드론 개발

〈 이 상 민 학생, 하 동 수 교수〉

우리 대학 조천식녹색교통대학원 하동수 교수 연구팀이 양 날개(주익[主翼], 비행기 몸체 중앙에서 양쪽으로 뻗은 날개)를 각각 분리시켜 개별적으로 제어할 수 있는 드론을 개발했다.

하 교수 연구팀이 개발한 분리형 주익 개별제어 비행체는 주익을 두 개로 완전히 분리해 별개로 제어할 수 있기 때문에 높은 에너지 효율, 기민한 운행, 작은 반경의 회전 운행이 가능하다.

우리에게 익숙한 일반항공기는 일체형 주익을 사용한다. 이는 공기 양력을 이용한 비행체이기 때문에 에너지 효율은 높지만 회전반경이 커 기민한 동작이 어렵다.

반면 여러 개의 프로펠러를 회전시켜 양력을 얻는 기존 방식은 회전반경이 작아 기민하게 동작할 수 있지만 공기 양력을 이용하지 못해 에너지 효율이 낮다.

하 교수 연구팀은 이러한 한계를 극복하기 위해 주익이 분리된 개별 제어형 비행체를 개발했다. 이는 분리된 주익의 회전을 개별적으로 제어하고 꼬리에 달린 모터의 추진방향을 바꾸는 방식으로 이를 통해 수직비행 및 수평비행의 전환을 구현했다.

주익을 분리하는 방법에는 두 가지가 있다. 몸체와 주익을 동시에 지지하는 지지대와 분리된 주익을 개별적으로 지지하는 지지대를 따로 사용하는 방식, 몸체의 측면을 주익 제어용 기기의 일부로 활용하며 개별적 지지대를 이용하는 방식이 있다.

이번에 개발한 드론은 몸체와 주익을 동시에 지지하는 지지대와 분리된 주익을 개별적으로 지지하는 지지대를 이용하는 방식으로 제작됐다.

연구팀의 기술은 원하는 운행방식에 따라 분리된 주익의 개별제어를 실행하며 제어결과는 비행체에 장착된 센서를 통해 다시 조정되는 과정을 거친다. 이러한 운행방식으로 일반 항공기가 만들 수 없는 다양한 동작이 가능해진다.

연구팀의 기술은 지난 11월 미국 우버와 나사가 발표한 도심지역 근거리 항공택시처럼 점차 보급될 중, 단거리 지역의 항공 교통에 속도, 기민성, 에너지 효율을 갖춘 비행체로 쓰일 것으로 기대된다.

하 교수는 “개발한 비행체는 민수용 항공교통, 군용 항공무기체계, 일반 안전관리 등 다양한 분야에 폭넓게 활용 가능하다”며 “주익 분리 및 독립제어는 비행 방식의 다양하고 효과적인 구현에 영향을 미친다. 2016년 설계 시점부터 한국, 미국, 중국등에 다양한 분리제어 구현방식에 대한 관련 특허를 출원했다”고 말했다.

이번 연구는 정보통신기술진흥센터의 ITRC 사업의 지원을 받아 수행됐다.

□ 그림 설명

그림1. 수직 이착륙, 수직 및 수평비행이 가능한 분리형 주익(主翼) 독립제어기술

2018.01.04 조회수 12156 -

김순태 교수, 무선인터넷 시뮬레이션 기술 모파이심(MofySim) 개발

〈 김 순 태 교수 〉

스마트폰 사용자의 75%가 하루 1회 이상 인터넷 검색, 사회연결망서비스(SNS) 관련 서비스를 이용할 만큼 무선 네트워크는 모바일 기기에서 가장 핵심적인 요소이다.

무선 네트워크에서는 상황에 따라 패킷 손실, 손상 등의 오류가 발생할 수 있고 이것이 배터리 소모의 원인이 된다. 따라서 모바일 기기를 설계할 때 네트워크 상황에 따라 기기의 성능 및 소비 에너지 등을 고려해야 한다.

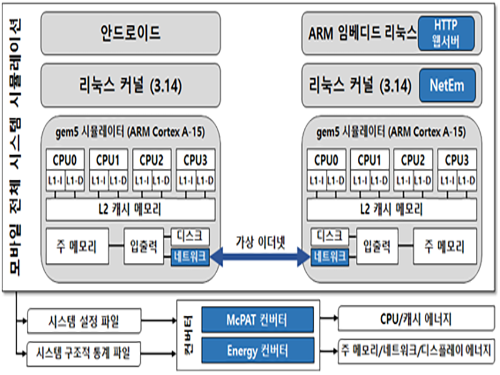

우리 대학 전산학부 김순태 교수 연구팀은 스마트폰, 컴퓨터 등에서 사용되는 무선 인터넷 환경을 컴퓨터 시뮬레이션을 통해 미리 구현할 수 있는 시뮬레이션 플랫폼 모파이심(MofySim)을 개발했다.

이를 통해 스마트폰의 인터넷 환경과 비슷하게 시뮬레이션을 수행할 수 있어 하드웨어, 소프트웨어의 문제점과 개선 사항을 쉽게 파악 수 있다.

실제 시스템에서는 추출하기 어려운 하드웨어 상에서 발생하는 다양한 현상 및 시스템 소프트웨어의 활동 상황, 네트워크 상황에 따라 생기는 하드웨어와 소프트웨어의 문제점을 찾을 수 있다는 점이다. 이를 통해 모바일 시스템의 성능, 전력소비, 신뢰성을 측정할 수 있다.

이번 성과는 4월 19일 스웨덴 웁살라에서 열린 ISPASS(International Symposium on Performance Analysis of Systems and Software)학회에서 발표됐다.

기존 시뮬레이션 시스템은 통신을 통한 인터넷 연결을 완벽히 지원하지 못하고 로컬(local) 디스크에서 데이터를 읽는 형태로 지원했다. 즉, 로컬 디스크에 있는 오프라인 상의 자료만을 토대로 웹 서핑을 시뮬레이션 하는 제한된 환경 때문에 네트워크의 변동성을 반영하지 못하고 이는 신뢰도 하락으로 이어진다.

모파이심은 문제 해결을 할 수 있도록 3G, 4G, 와이파이 등 무선통신 네트워크와 통신 대역폭(bandwidth), 패킷(packet) 분실, 지연시간 등 발생 가능한 네트워크 상황을 모델링하는 모바일 시스템 시뮬레이션을 지원한다.

실제 모바일 시스템에서 무선통신으로 인터넷에 접속해 웹 서핑을 하는 것과 동일한 효과를 시뮬레이션 상에서도 구현할 수 있다.

모파이심은 모바일 시스템, 서버 시스템, 두 시스템부를 연결하는 무선 통신부로 구성된다. 모바실 시스템부는 CPU, 메모리, 저장장치, 디스플레이 등의 하드웨어를 모델링하고, 리눅스 운영체제와 안드로이드 시스템을 구동한다.

서버 시스템부는 모바일 시스템이 접속하는 인터넷에 연결된 원격 서버를 모델링한다. 마지막으로 무선 통신부는 두 시스템을 무선 통신을 통해 연결하는 모파이심의 핵심이다.

연구팀은 모파이심이 교육 분야에서도 활용이 가능해 관련 분야 교육 수준을 향상시키는 데 기여할 것으로 예상했다.

김 교수는 “모파이심을 이용해 현재 뿐 아니라 미래의 모바일 시스템 모델링이 가능해진다”며 “하드웨어가 개발되지 않은 상황에서 미래 시스템을 실험할 수 있는 유용한 플랫폼이 될 것이다”고 말했다.

이 시스템은 홈페이지(http://ecl.kaist.ac.kr/tools)에서 등록 후 무료 다운로드할 수 있다.

전산학부 김형규 박사과정과 삼성전자 소프트웨어센터 주민호 책임연구원의 참여로 이뤄진 이번 연구는 한국연구재단 중견연구자지원사업과 정보통신기술진흥센터 SW컴퓨팅산업원천기술개발사업의 지원을 받아 수행됐다.

ㅁ 그림 설명

그림1. 모파이심 시스템 시뮬레이션 플랫폼 구조도

2016.05.16 조회수 13314

김순태 교수, 무선인터넷 시뮬레이션 기술 모파이심(MofySim) 개발

〈 김 순 태 교수 〉

스마트폰 사용자의 75%가 하루 1회 이상 인터넷 검색, 사회연결망서비스(SNS) 관련 서비스를 이용할 만큼 무선 네트워크는 모바일 기기에서 가장 핵심적인 요소이다.

무선 네트워크에서는 상황에 따라 패킷 손실, 손상 등의 오류가 발생할 수 있고 이것이 배터리 소모의 원인이 된다. 따라서 모바일 기기를 설계할 때 네트워크 상황에 따라 기기의 성능 및 소비 에너지 등을 고려해야 한다.

우리 대학 전산학부 김순태 교수 연구팀은 스마트폰, 컴퓨터 등에서 사용되는 무선 인터넷 환경을 컴퓨터 시뮬레이션을 통해 미리 구현할 수 있는 시뮬레이션 플랫폼 모파이심(MofySim)을 개발했다.

이를 통해 스마트폰의 인터넷 환경과 비슷하게 시뮬레이션을 수행할 수 있어 하드웨어, 소프트웨어의 문제점과 개선 사항을 쉽게 파악 수 있다.

실제 시스템에서는 추출하기 어려운 하드웨어 상에서 발생하는 다양한 현상 및 시스템 소프트웨어의 활동 상황, 네트워크 상황에 따라 생기는 하드웨어와 소프트웨어의 문제점을 찾을 수 있다는 점이다. 이를 통해 모바일 시스템의 성능, 전력소비, 신뢰성을 측정할 수 있다.

이번 성과는 4월 19일 스웨덴 웁살라에서 열린 ISPASS(International Symposium on Performance Analysis of Systems and Software)학회에서 발표됐다.

기존 시뮬레이션 시스템은 통신을 통한 인터넷 연결을 완벽히 지원하지 못하고 로컬(local) 디스크에서 데이터를 읽는 형태로 지원했다. 즉, 로컬 디스크에 있는 오프라인 상의 자료만을 토대로 웹 서핑을 시뮬레이션 하는 제한된 환경 때문에 네트워크의 변동성을 반영하지 못하고 이는 신뢰도 하락으로 이어진다.

모파이심은 문제 해결을 할 수 있도록 3G, 4G, 와이파이 등 무선통신 네트워크와 통신 대역폭(bandwidth), 패킷(packet) 분실, 지연시간 등 발생 가능한 네트워크 상황을 모델링하는 모바일 시스템 시뮬레이션을 지원한다.

실제 모바일 시스템에서 무선통신으로 인터넷에 접속해 웹 서핑을 하는 것과 동일한 효과를 시뮬레이션 상에서도 구현할 수 있다.

모파이심은 모바일 시스템, 서버 시스템, 두 시스템부를 연결하는 무선 통신부로 구성된다. 모바실 시스템부는 CPU, 메모리, 저장장치, 디스플레이 등의 하드웨어를 모델링하고, 리눅스 운영체제와 안드로이드 시스템을 구동한다.

서버 시스템부는 모바일 시스템이 접속하는 인터넷에 연결된 원격 서버를 모델링한다. 마지막으로 무선 통신부는 두 시스템을 무선 통신을 통해 연결하는 모파이심의 핵심이다.

연구팀은 모파이심이 교육 분야에서도 활용이 가능해 관련 분야 교육 수준을 향상시키는 데 기여할 것으로 예상했다.

김 교수는 “모파이심을 이용해 현재 뿐 아니라 미래의 모바일 시스템 모델링이 가능해진다”며 “하드웨어가 개발되지 않은 상황에서 미래 시스템을 실험할 수 있는 유용한 플랫폼이 될 것이다”고 말했다.

이 시스템은 홈페이지(http://ecl.kaist.ac.kr/tools)에서 등록 후 무료 다운로드할 수 있다.

전산학부 김형규 박사과정과 삼성전자 소프트웨어센터 주민호 책임연구원의 참여로 이뤄진 이번 연구는 한국연구재단 중견연구자지원사업과 정보통신기술진흥센터 SW컴퓨팅산업원천기술개발사업의 지원을 받아 수행됐다.

ㅁ 그림 설명

그림1. 모파이심 시스템 시뮬레이션 플랫폼 구조도

2016.05.16 조회수 13314 -

와이파이만 자동 감지해 다운로드하는 기술 개발

해외출장이 잦은 김 모 씨는 스마트폰에 영화를 다운받아 기내에서의 무료함을 달랜다. 그는 아침 회의에 들어가기 전 오후 5시까지만 다운을 완료하면 된다는 데드라인을 설정하고, 여러 일정을 마친 후 시간이 되자 기내에 탑승했다.

스마트폰을 확인하니 다운이 완료됐고, 자동으로 와이파이만 인식해 다운로드 했기 때문에 LTE 데이터는 전혀 소비되지 않았다.

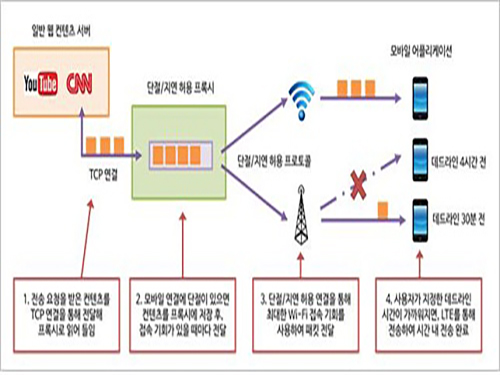

우리 대학 전기및전자공학과 박경수, 이융, 정송 교수 연구팀은 와이파이와 이동통신 망의 단절을 자동으로 감지해 모바일 콘텐츠를 전달하는 기술 및 시스템을 개발했다.

이동통신 망에서 와이파이 망으로 데이터를 분산시키고 이양하는 것을 와이파이 오프로딩이라 한다. 이는 스마트폰에서 쉽게 볼 수 있는 기능이다.

그런데 현재의 와이파이 오프로딩은 원활하지 않아 자동적 시스템이 아닌 개인의 선택에 의해 이뤄지고 있다. 와이파이 망을 벗어나 이동하는 경우 연결이 단절되고 버퍼링이 발생해, 사용자들은 한 곳에서만 와이파이를 사용하거나 아예 해제하고 이동통신망을 이용하는 것이다.

원활한 오프로딩을 위해 관련 미래 표준을 만들고 있지만 LTE 망 통합 등의 변화가 필요하고 추후 장비 업그레이드 비용이 문제가 된다.

연구팀은 이러한 네트워크 단절 문제를 자동으로 처리하면서 와이파이 망을 최대한 사용하게 만드는 모바일 네트워크 플랫폼을 구축했다. 우선 네트워크 단절을 트랜스포트 계층에서 직접 처리해 네트워크간 이동 시에도 연결의 끊김 없이 전송이 가능한 프로토콜을 개발했다.

더불어 연구팀은 지연 허용 와이파이 오프로딩 기법을 개발했다. 다운로드 완료 시간을 예약하면 잔여 시간과 용량 등의 정보를 계산한 뒤, LTE와 와이파이를 스스로 조절해 최소의 LTE 데이터로 원하는 시간대에 다운로드를 완료할 수 있는 알고리즘이다.

이 기술은 스트리밍 플레이어에도 적용 가능해 와이파이 망에 있는 동안 더 많은 트래픽을 전송해 구역을 벗어나도 버퍼링 없는 동영상 시청이 가능하다.

이 기술로 사용자는 적은 요금으로 질 높은 콘텐츠를 이용할 수 있고, 사업자는 기존 LTE망의 재투자 및 효율적인 와이파이 망 유도가 가능하다. 또한 모바일 동영상 콘텐츠 사업자에겐 더 많은 수요자를 확보할 수 있다.

이융 교수는 “와이파이 오프로딩과 LTE 망의 관계를 최소화함으로써 모바일 콘텐츠 사업자, 망 사업자, 사용자 모두가 윈윈할 수 있는 기술이 될 것이다”고 말했다.

이번 연구는 미래창조과학부 정보통신기술진흥센터 (IITP) 네트워크 CP실(임용재 CP)의 지원을 받아 수행됐고, 5월에 개최하는 모바일 시스템 분야 최고 권위의 국제 학회인 에이씨엠 모비시스(ACM MobiSys)에서 발표될 예정이다.

□ 그림설명

그림 1. 지연 허용 와이파이 오프로딩 기법 개념도

2015.04.20 조회수 15671

와이파이만 자동 감지해 다운로드하는 기술 개발

해외출장이 잦은 김 모 씨는 스마트폰에 영화를 다운받아 기내에서의 무료함을 달랜다. 그는 아침 회의에 들어가기 전 오후 5시까지만 다운을 완료하면 된다는 데드라인을 설정하고, 여러 일정을 마친 후 시간이 되자 기내에 탑승했다.

스마트폰을 확인하니 다운이 완료됐고, 자동으로 와이파이만 인식해 다운로드 했기 때문에 LTE 데이터는 전혀 소비되지 않았다.

우리 대학 전기및전자공학과 박경수, 이융, 정송 교수 연구팀은 와이파이와 이동통신 망의 단절을 자동으로 감지해 모바일 콘텐츠를 전달하는 기술 및 시스템을 개발했다.

이동통신 망에서 와이파이 망으로 데이터를 분산시키고 이양하는 것을 와이파이 오프로딩이라 한다. 이는 스마트폰에서 쉽게 볼 수 있는 기능이다.

그런데 현재의 와이파이 오프로딩은 원활하지 않아 자동적 시스템이 아닌 개인의 선택에 의해 이뤄지고 있다. 와이파이 망을 벗어나 이동하는 경우 연결이 단절되고 버퍼링이 발생해, 사용자들은 한 곳에서만 와이파이를 사용하거나 아예 해제하고 이동통신망을 이용하는 것이다.

원활한 오프로딩을 위해 관련 미래 표준을 만들고 있지만 LTE 망 통합 등의 변화가 필요하고 추후 장비 업그레이드 비용이 문제가 된다.

연구팀은 이러한 네트워크 단절 문제를 자동으로 처리하면서 와이파이 망을 최대한 사용하게 만드는 모바일 네트워크 플랫폼을 구축했다. 우선 네트워크 단절을 트랜스포트 계층에서 직접 처리해 네트워크간 이동 시에도 연결의 끊김 없이 전송이 가능한 프로토콜을 개발했다.

더불어 연구팀은 지연 허용 와이파이 오프로딩 기법을 개발했다. 다운로드 완료 시간을 예약하면 잔여 시간과 용량 등의 정보를 계산한 뒤, LTE와 와이파이를 스스로 조절해 최소의 LTE 데이터로 원하는 시간대에 다운로드를 완료할 수 있는 알고리즘이다.

이 기술은 스트리밍 플레이어에도 적용 가능해 와이파이 망에 있는 동안 더 많은 트래픽을 전송해 구역을 벗어나도 버퍼링 없는 동영상 시청이 가능하다.

이 기술로 사용자는 적은 요금으로 질 높은 콘텐츠를 이용할 수 있고, 사업자는 기존 LTE망의 재투자 및 효율적인 와이파이 망 유도가 가능하다. 또한 모바일 동영상 콘텐츠 사업자에겐 더 많은 수요자를 확보할 수 있다.

이융 교수는 “와이파이 오프로딩과 LTE 망의 관계를 최소화함으로써 모바일 콘텐츠 사업자, 망 사업자, 사용자 모두가 윈윈할 수 있는 기술이 될 것이다”고 말했다.

이번 연구는 미래창조과학부 정보통신기술진흥센터 (IITP) 네트워크 CP실(임용재 CP)의 지원을 받아 수행됐고, 5월에 개최하는 모바일 시스템 분야 최고 권위의 국제 학회인 에이씨엠 모비시스(ACM MobiSys)에서 발표될 예정이다.

□ 그림설명

그림 1. 지연 허용 와이파이 오프로딩 기법 개념도

2015.04.20 조회수 15671