-

설명해주는 인공지능 구현을 위한 초저전력 하드웨어 기술 개발

우리 대학 신소재공학과 김경민 교수 연구팀이 다양한 멤리스터* 소자를 이용한 설명 가능한 인공지능 (XAI) 시스템을 구현하는데 성공했다고 25일 밝혔다.

*멤리스터 (Memristor): 메모리 (Memory)와 저항 (Resistor)의 합성어로, 입력 신호에 따라 소자의 저항 상태가 변하는 소자

최근 인공지능 (AI) 기술의 급속한 발전이 다양한 분야에서 성과를 이루고 있다. 이미지 인식, 음성 인식, 자연어 처리 등에서 AI의 적용 범위가 확대되며 우리의 일상생활에 깊숙이 자리 잡고 있다.

AI는 인간의 뉴런 구조를 모방해 만든 ‘인공신경망’을 기반으로, 적게는 수백만 개에서 많게는 수조 개에 달하는 매개변수를 통해 데이터를 분석하고 의사 결정을 내린다. 그러나 이 많은 매개변수로 인해 AI 모델의 동작 원리를 정확하게 이해하기 어렵고, 이는 통상적으로 블랙박스에 비유되곤 한다. AI가 어떤 기준으로 결정을 내는지 알 수 없다면, AI에 결함이나 오작동이 발생했을 때 이를 해결하기 어렵고, 이로 인해 AI가 적용되는 다양한 산업 분야에서 문제가 발생할 수 있다.

이에 대한 해답으로 제시된 것이 바로 설명 가능한 인공지능 (XAI)이다. XAI는 AI가 어떠한 결정을 내렸을 때, 그 근거가 무엇인지를 사람이 이해할 수 있도록 만드는 기술이다. <그림1> 생성형 AI 등 점점 더 복잡해지는 AI 기술의 등장으로 개발자, 사용자, 규제 기관 모두에게 XAI 시스템의 필요성이 강조되고 있다. 하지만, XAI는 일반적으로 엄청난 양의 데이터 처리를 요구하기 때문에, 이를 보다 효율적으로 동작할 수 있는 하드웨어 개발이 필요한 상황이다.

김경민 교수 연구팀은 교란(Perturbation) 기반 XAI 시스템을 서로 다른 멤리스터 소자를 이용해 하드웨어로 구현하는데 성공하였다. 세 가지 멤리스터 소자는 각각 휘발성 저항변화 특성, 아날로그 비휘발성 저항변화 특성, 아날로그 휘발성 저항변화 특성을 가지며 <그림 2>, 각 소자는 교란 기반 XAI 시스템의 필수적인 기능인 입력 데이터 교란, 벡터곱 연산, 그리고 신호 통합 기능을 수행한다.

연구팀은 개발된 XAI 하드웨어를 평가하기 위해, 흑백 패턴을 인식하는 신경망을 설계하였다. 여기에 개발한 XAI 하드웨어 시스템으로 설계한 신경망이 흑백 패턴을 인식하는 근거를 설명하였다. <그림3> 그 결과 기존 CMOS 기술 기반 시스템 대비 에너지 소비를 24배 감소하여 AI 판단의 이유를 제공하는 것을 확인하였다. <그림4>

KAIST 김경민 교수는 “AI 기술이 일상화되면서 AI 동작의 투명성 및 해석가능성이 중요해지고 있는데, 이번 연구는 다양한 종류의 멤리스터 소자를 이용해 AI 판단에 대한 근거를 제공하는 XAI 하드웨어 시스템을 구현할 수 있었다는 점에 큰 의의가 있다”며 “이 연구는 AI 의사 결정에 도달하는 과정을 이해하기 쉽게 설명을 제공함으로써 AI 시스템의 신뢰성 향상에 기여할 수 있어, 향후 의료, 금융, 법률 등 민감한 정보를 다루는 AI 기반 서비스에 적용될 수 있을 것으로 기대된다”고 밝혔다.

이번 연구는 KAIST 신소재공학과 송한찬 박사과정, 박우준 박사과정 학생이 공동 제1 저자로 참여했으며, 국제 학술지 ‘어드밴스드 머티리얼즈(Advanced Materials, IF: 29.4)’에 03월 20일 字 온라인 게재됐으며, 한국연구재단 중견연구사업, 차세대지능형반도체기술개발사업, PIM인공지능반도체핵심기술개발사업, 나노종합기술원 및 KAIST 도약연구사업의 지원을 받아 수행됐다. (논문명: Memristive Explainable Artificial Intelligence Hardware, 논문링크: https://doi.org/10.1002/adma.202400977)

설명해주는 인공지능 구현을 위한 초저전력 하드웨어 기술 개발

우리 대학 신소재공학과 김경민 교수 연구팀이 다양한 멤리스터* 소자를 이용한 설명 가능한 인공지능 (XAI) 시스템을 구현하는데 성공했다고 25일 밝혔다.

*멤리스터 (Memristor): 메모리 (Memory)와 저항 (Resistor)의 합성어로, 입력 신호에 따라 소자의 저항 상태가 변하는 소자

최근 인공지능 (AI) 기술의 급속한 발전이 다양한 분야에서 성과를 이루고 있다. 이미지 인식, 음성 인식, 자연어 처리 등에서 AI의 적용 범위가 확대되며 우리의 일상생활에 깊숙이 자리 잡고 있다.

AI는 인간의 뉴런 구조를 모방해 만든 ‘인공신경망’을 기반으로, 적게는 수백만 개에서 많게는 수조 개에 달하는 매개변수를 통해 데이터를 분석하고 의사 결정을 내린다. 그러나 이 많은 매개변수로 인해 AI 모델의 동작 원리를 정확하게 이해하기 어렵고, 이는 통상적으로 블랙박스에 비유되곤 한다. AI가 어떤 기준으로 결정을 내는지 알 수 없다면, AI에 결함이나 오작동이 발생했을 때 이를 해결하기 어렵고, 이로 인해 AI가 적용되는 다양한 산업 분야에서 문제가 발생할 수 있다.

이에 대한 해답으로 제시된 것이 바로 설명 가능한 인공지능 (XAI)이다. XAI는 AI가 어떠한 결정을 내렸을 때, 그 근거가 무엇인지를 사람이 이해할 수 있도록 만드는 기술이다. <그림1> 생성형 AI 등 점점 더 복잡해지는 AI 기술의 등장으로 개발자, 사용자, 규제 기관 모두에게 XAI 시스템의 필요성이 강조되고 있다. 하지만, XAI는 일반적으로 엄청난 양의 데이터 처리를 요구하기 때문에, 이를 보다 효율적으로 동작할 수 있는 하드웨어 개발이 필요한 상황이다.

김경민 교수 연구팀은 교란(Perturbation) 기반 XAI 시스템을 서로 다른 멤리스터 소자를 이용해 하드웨어로 구현하는데 성공하였다. 세 가지 멤리스터 소자는 각각 휘발성 저항변화 특성, 아날로그 비휘발성 저항변화 특성, 아날로그 휘발성 저항변화 특성을 가지며 <그림 2>, 각 소자는 교란 기반 XAI 시스템의 필수적인 기능인 입력 데이터 교란, 벡터곱 연산, 그리고 신호 통합 기능을 수행한다.

연구팀은 개발된 XAI 하드웨어를 평가하기 위해, 흑백 패턴을 인식하는 신경망을 설계하였다. 여기에 개발한 XAI 하드웨어 시스템으로 설계한 신경망이 흑백 패턴을 인식하는 근거를 설명하였다. <그림3> 그 결과 기존 CMOS 기술 기반 시스템 대비 에너지 소비를 24배 감소하여 AI 판단의 이유를 제공하는 것을 확인하였다. <그림4>

KAIST 김경민 교수는 “AI 기술이 일상화되면서 AI 동작의 투명성 및 해석가능성이 중요해지고 있는데, 이번 연구는 다양한 종류의 멤리스터 소자를 이용해 AI 판단에 대한 근거를 제공하는 XAI 하드웨어 시스템을 구현할 수 있었다는 점에 큰 의의가 있다”며 “이 연구는 AI 의사 결정에 도달하는 과정을 이해하기 쉽게 설명을 제공함으로써 AI 시스템의 신뢰성 향상에 기여할 수 있어, 향후 의료, 금융, 법률 등 민감한 정보를 다루는 AI 기반 서비스에 적용될 수 있을 것으로 기대된다”고 밝혔다.

이번 연구는 KAIST 신소재공학과 송한찬 박사과정, 박우준 박사과정 학생이 공동 제1 저자로 참여했으며, 국제 학술지 ‘어드밴스드 머티리얼즈(Advanced Materials, IF: 29.4)’에 03월 20일 字 온라인 게재됐으며, 한국연구재단 중견연구사업, 차세대지능형반도체기술개발사업, PIM인공지능반도체핵심기술개발사업, 나노종합기술원 및 KAIST 도약연구사업의 지원을 받아 수행됐다. (논문명: Memristive Explainable Artificial Intelligence Hardware, 논문링크: https://doi.org/10.1002/adma.202400977)

2024.03.25

조회수 7393

-

정밀한 시각적 판단을 추론한 새로운 인공지능 가속칩 개발

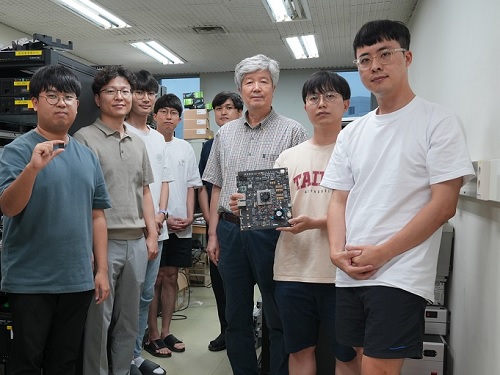

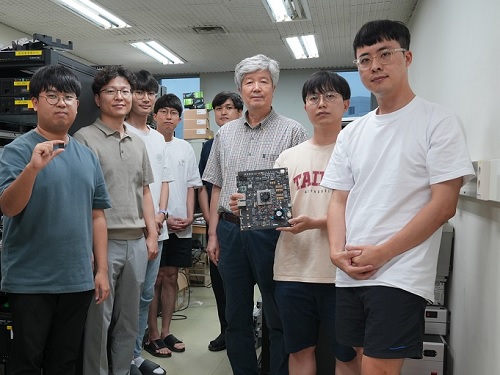

우리 대학 전기및전자공학부 윤찬현, 김주영 교수 연구팀이 설명 가능한 인공지능(eXplainable AI, XAI) 기법을 처리하기 위한 노이즈(잡음)에 강한 다중 피라미드 활성화 맵 기반 주의집중 구조가 탑재된 인공지능 칩을 설계하고, 삼성전자 DS부문의 지원으로 설명가능 뉴로프로세싱 유닛(이하 EPU, Explainable neuro-Processing Unit)을 개발했다고 24일 밝혔다.

설명가능 인공지능이란 사람이 이해할 수 있고 신뢰할 수 있는 설명을 제공할 수 있는 인공지능 기법이다. 기존의 수학적 알고리즘으로 학습되는 인공지능은 학습예제에 편향되어 신뢰할 수 없거나, 수천억개의 매개변수를 사람이 이해할 수 없다는 문제점을 해결하기 위해, 왜 인공지능이 특정 결과를 추론했는지 판단근거를 설명할 수 있도록 개발되었다. 설명가능한 인공지능은 어떤 이유에 의해서 인공지능의 의사결정에 큰 영향을 주었는지 설명할 수 있다는 점에서 기존의 인공지능보다 정확성, 공정성, 신뢰성을 보장할 수 있다는 특징을 가진다.

공동연구팀은 다중 규모 및 다중물체의 특징 추출 구조인 피라미드형 신경망 구조에서 추론 결과에 영향을 주는 인공지능 내부의 신경층별 활성화되는 정도를 복합적으로 해석할 수 있는 인공지능 모델과 이를 가속처리 특화된 채널 방향 합성곱 연산 및 정확도를 유지하는 EPU칩을 구현했다.

다중 규모 및 다중물체 특징 추출에 특화된 피라미드형 인공지능 모델에서 설명 시각화 구현을 위해서는 추론 과정의 역방향으로 모든 합성곱 층별 활성화 맵에서 모델 파라미터의 변화도를 추출할 수 있는 구조가 요구된다.

그러나 역전파 계산 과정은 기존의 추론처리 가속을 위한 인공지능 칩 설계와 달리 이전 파라미터 및 상태를 기억해야 하며 이는 한정된 온 칩 메모리 크기 및 인공지능 모델 전체를 특정한 용도에 맞게 주문 제작(ASIC; Application Specific Integrated Circuit)해 구현하기에는 물리적 한계가 있다.

또한, 피라미드형 구조의 설명 가능한 인공지능 모델은 설명성 보장을 위한 N개 층의 활성화 맵으로부터 기울기 기반의 클래스 활성 맵핑 시각화 처리 각각 필요해 복잡도를 높이는 문제가 있다. 그리고, 입력의 매우 작은 노이즈에도 클래스 활성화 맵핑 시각화 설명이 완전히 달라져 설명 가능한 인공지능 모델의 신뢰도 저하가 큰 문제점이었다.

전기및전자공학부 윤찬현 교수 연구팀은 문제해결을 위해(그림1 참조) 설명 가능한 인공지능의 다중 활성화 맵 고유의 특성 정보를 융합해 전역 주의 집중 맵을 생성하는 네트워크 구조와 입력 이미지 노이즈에 강건한 모델 생성을 위한 상호학습 방법을 개발해, 단일 활성화 맵 기반 주의집중 맵 생성 기술에 비해 설명성 지표를 최대 6배가량 높였다.

또한, 다중 스케일의 다양한 주의집중 맵들의 상호 보완적인 특성을 일원화된 주의집중 맵으로 정교하게 재구성함으로써 사람이 해석 가능한 수준의 정밀한 설명성을 제공할 수 있게 했다. 이번 연구 성과를 통해 위성 영상과 같이 객체 크기 변화가 큰 이미지 분석에서 인공지능 모델의 설명성을 크게 향상할 수 있을 것으로 기대된다고 연구팀 관계자는 설명했다.

전기및전자공학부 김주영 교수 연구팀은 제안된 설명 가능한 인공지능 모델을 가속하기 위해 기존 모델의 추론과 역전파 과정에 더해 활성화 맵 생성까지 처리할 수 있는 XAI 코어를 개발하고, 다양한 연산 태스크를 유연하게 분할해 동시에 처리할 수 있는 멀티 데이터 플로우 방식을 제안했다. 또한, 많은 0 값을 포함하는 활성화 맵의 특성을 활용해, 연속된 0을 건너뛸 수 있는 새로운 데이터 압축 포맷을 제안하고 이를 지원하는 가속 유닛을 개발해 최대 10배 이상의 활성화 맵을 칩 내부에서 처리할 수 있도록 했다.

연구팀이 개발한 EPU 칩은 광학 위성, 전천후 관측 영상레이더(Synthetic Aperture Radar) 위성 등 특수 목적과 고정밀 인공지능 영상처리시스템에 적용할 수 있으며, 저지연‧저전력으로 인공지능 시스템의 판단 근거에 대한 설명성을 획기적으로 높일 수 있을 것으로 기대된다. 연구팀은 EPU 칩 개발 후속 연구를 진행할 계획이다.

정밀한 시각적 판단을 추론한 새로운 인공지능 가속칩 개발

우리 대학 전기및전자공학부 윤찬현, 김주영 교수 연구팀이 설명 가능한 인공지능(eXplainable AI, XAI) 기법을 처리하기 위한 노이즈(잡음)에 강한 다중 피라미드 활성화 맵 기반 주의집중 구조가 탑재된 인공지능 칩을 설계하고, 삼성전자 DS부문의 지원으로 설명가능 뉴로프로세싱 유닛(이하 EPU, Explainable neuro-Processing Unit)을 개발했다고 24일 밝혔다.

설명가능 인공지능이란 사람이 이해할 수 있고 신뢰할 수 있는 설명을 제공할 수 있는 인공지능 기법이다. 기존의 수학적 알고리즘으로 학습되는 인공지능은 학습예제에 편향되어 신뢰할 수 없거나, 수천억개의 매개변수를 사람이 이해할 수 없다는 문제점을 해결하기 위해, 왜 인공지능이 특정 결과를 추론했는지 판단근거를 설명할 수 있도록 개발되었다. 설명가능한 인공지능은 어떤 이유에 의해서 인공지능의 의사결정에 큰 영향을 주었는지 설명할 수 있다는 점에서 기존의 인공지능보다 정확성, 공정성, 신뢰성을 보장할 수 있다는 특징을 가진다.

공동연구팀은 다중 규모 및 다중물체의 특징 추출 구조인 피라미드형 신경망 구조에서 추론 결과에 영향을 주는 인공지능 내부의 신경층별 활성화되는 정도를 복합적으로 해석할 수 있는 인공지능 모델과 이를 가속처리 특화된 채널 방향 합성곱 연산 및 정확도를 유지하는 EPU칩을 구현했다.

다중 규모 및 다중물체 특징 추출에 특화된 피라미드형 인공지능 모델에서 설명 시각화 구현을 위해서는 추론 과정의 역방향으로 모든 합성곱 층별 활성화 맵에서 모델 파라미터의 변화도를 추출할 수 있는 구조가 요구된다.

그러나 역전파 계산 과정은 기존의 추론처리 가속을 위한 인공지능 칩 설계와 달리 이전 파라미터 및 상태를 기억해야 하며 이는 한정된 온 칩 메모리 크기 및 인공지능 모델 전체를 특정한 용도에 맞게 주문 제작(ASIC; Application Specific Integrated Circuit)해 구현하기에는 물리적 한계가 있다.

또한, 피라미드형 구조의 설명 가능한 인공지능 모델은 설명성 보장을 위한 N개 층의 활성화 맵으로부터 기울기 기반의 클래스 활성 맵핑 시각화 처리 각각 필요해 복잡도를 높이는 문제가 있다. 그리고, 입력의 매우 작은 노이즈에도 클래스 활성화 맵핑 시각화 설명이 완전히 달라져 설명 가능한 인공지능 모델의 신뢰도 저하가 큰 문제점이었다.

전기및전자공학부 윤찬현 교수 연구팀은 문제해결을 위해(그림1 참조) 설명 가능한 인공지능의 다중 활성화 맵 고유의 특성 정보를 융합해 전역 주의 집중 맵을 생성하는 네트워크 구조와 입력 이미지 노이즈에 강건한 모델 생성을 위한 상호학습 방법을 개발해, 단일 활성화 맵 기반 주의집중 맵 생성 기술에 비해 설명성 지표를 최대 6배가량 높였다.

또한, 다중 스케일의 다양한 주의집중 맵들의 상호 보완적인 특성을 일원화된 주의집중 맵으로 정교하게 재구성함으로써 사람이 해석 가능한 수준의 정밀한 설명성을 제공할 수 있게 했다. 이번 연구 성과를 통해 위성 영상과 같이 객체 크기 변화가 큰 이미지 분석에서 인공지능 모델의 설명성을 크게 향상할 수 있을 것으로 기대된다고 연구팀 관계자는 설명했다.

전기및전자공학부 김주영 교수 연구팀은 제안된 설명 가능한 인공지능 모델을 가속하기 위해 기존 모델의 추론과 역전파 과정에 더해 활성화 맵 생성까지 처리할 수 있는 XAI 코어를 개발하고, 다양한 연산 태스크를 유연하게 분할해 동시에 처리할 수 있는 멀티 데이터 플로우 방식을 제안했다. 또한, 많은 0 값을 포함하는 활성화 맵의 특성을 활용해, 연속된 0을 건너뛸 수 있는 새로운 데이터 압축 포맷을 제안하고 이를 지원하는 가속 유닛을 개발해 최대 10배 이상의 활성화 맵을 칩 내부에서 처리할 수 있도록 했다.

연구팀이 개발한 EPU 칩은 광학 위성, 전천후 관측 영상레이더(Synthetic Aperture Radar) 위성 등 특수 목적과 고정밀 인공지능 영상처리시스템에 적용할 수 있으며, 저지연‧저전력으로 인공지능 시스템의 판단 근거에 대한 설명성을 획기적으로 높일 수 있을 것으로 기대된다. 연구팀은 EPU 칩 개발 후속 연구를 진행할 계획이다.

2022.08.25

조회수 9301

설명해주는 인공지능 구현을 위한 초저전력 하드웨어 기술 개발

우리 대학 신소재공학과 김경민 교수 연구팀이 다양한 멤리스터* 소자를 이용한 설명 가능한 인공지능 (XAI) 시스템을 구현하는데 성공했다고 25일 밝혔다.

*멤리스터 (Memristor): 메모리 (Memory)와 저항 (Resistor)의 합성어로, 입력 신호에 따라 소자의 저항 상태가 변하는 소자

최근 인공지능 (AI) 기술의 급속한 발전이 다양한 분야에서 성과를 이루고 있다. 이미지 인식, 음성 인식, 자연어 처리 등에서 AI의 적용 범위가 확대되며 우리의 일상생활에 깊숙이 자리 잡고 있다.

AI는 인간의 뉴런 구조를 모방해 만든 ‘인공신경망’을 기반으로, 적게는 수백만 개에서 많게는 수조 개에 달하는 매개변수를 통해 데이터를 분석하고 의사 결정을 내린다. 그러나 이 많은 매개변수로 인해 AI 모델의 동작 원리를 정확하게 이해하기 어렵고, 이는 통상적으로 블랙박스에 비유되곤 한다. AI가 어떤 기준으로 결정을 내는지 알 수 없다면, AI에 결함이나 오작동이 발생했을 때 이를 해결하기 어렵고, 이로 인해 AI가 적용되는 다양한 산업 분야에서 문제가 발생할 수 있다.

이에 대한 해답으로 제시된 것이 바로 설명 가능한 인공지능 (XAI)이다. XAI는 AI가 어떠한 결정을 내렸을 때, 그 근거가 무엇인지를 사람이 이해할 수 있도록 만드는 기술이다. <그림1> 생성형 AI 등 점점 더 복잡해지는 AI 기술의 등장으로 개발자, 사용자, 규제 기관 모두에게 XAI 시스템의 필요성이 강조되고 있다. 하지만, XAI는 일반적으로 엄청난 양의 데이터 처리를 요구하기 때문에, 이를 보다 효율적으로 동작할 수 있는 하드웨어 개발이 필요한 상황이다.

김경민 교수 연구팀은 교란(Perturbation) 기반 XAI 시스템을 서로 다른 멤리스터 소자를 이용해 하드웨어로 구현하는데 성공하였다. 세 가지 멤리스터 소자는 각각 휘발성 저항변화 특성, 아날로그 비휘발성 저항변화 특성, 아날로그 휘발성 저항변화 특성을 가지며 <그림 2>, 각 소자는 교란 기반 XAI 시스템의 필수적인 기능인 입력 데이터 교란, 벡터곱 연산, 그리고 신호 통합 기능을 수행한다.

연구팀은 개발된 XAI 하드웨어를 평가하기 위해, 흑백 패턴을 인식하는 신경망을 설계하였다. 여기에 개발한 XAI 하드웨어 시스템으로 설계한 신경망이 흑백 패턴을 인식하는 근거를 설명하였다. <그림3> 그 결과 기존 CMOS 기술 기반 시스템 대비 에너지 소비를 24배 감소하여 AI 판단의 이유를 제공하는 것을 확인하였다. <그림4>

KAIST 김경민 교수는 “AI 기술이 일상화되면서 AI 동작의 투명성 및 해석가능성이 중요해지고 있는데, 이번 연구는 다양한 종류의 멤리스터 소자를 이용해 AI 판단에 대한 근거를 제공하는 XAI 하드웨어 시스템을 구현할 수 있었다는 점에 큰 의의가 있다”며 “이 연구는 AI 의사 결정에 도달하는 과정을 이해하기 쉽게 설명을 제공함으로써 AI 시스템의 신뢰성 향상에 기여할 수 있어, 향후 의료, 금융, 법률 등 민감한 정보를 다루는 AI 기반 서비스에 적용될 수 있을 것으로 기대된다”고 밝혔다.

이번 연구는 KAIST 신소재공학과 송한찬 박사과정, 박우준 박사과정 학생이 공동 제1 저자로 참여했으며, 국제 학술지 ‘어드밴스드 머티리얼즈(Advanced Materials, IF: 29.4)’에 03월 20일 字 온라인 게재됐으며, 한국연구재단 중견연구사업, 차세대지능형반도체기술개발사업, PIM인공지능반도체핵심기술개발사업, 나노종합기술원 및 KAIST 도약연구사업의 지원을 받아 수행됐다. (논문명: Memristive Explainable Artificial Intelligence Hardware, 논문링크: https://doi.org/10.1002/adma.202400977)

2024.03.25 조회수 7393

설명해주는 인공지능 구현을 위한 초저전력 하드웨어 기술 개발

우리 대학 신소재공학과 김경민 교수 연구팀이 다양한 멤리스터* 소자를 이용한 설명 가능한 인공지능 (XAI) 시스템을 구현하는데 성공했다고 25일 밝혔다.

*멤리스터 (Memristor): 메모리 (Memory)와 저항 (Resistor)의 합성어로, 입력 신호에 따라 소자의 저항 상태가 변하는 소자

최근 인공지능 (AI) 기술의 급속한 발전이 다양한 분야에서 성과를 이루고 있다. 이미지 인식, 음성 인식, 자연어 처리 등에서 AI의 적용 범위가 확대되며 우리의 일상생활에 깊숙이 자리 잡고 있다.

AI는 인간의 뉴런 구조를 모방해 만든 ‘인공신경망’을 기반으로, 적게는 수백만 개에서 많게는 수조 개에 달하는 매개변수를 통해 데이터를 분석하고 의사 결정을 내린다. 그러나 이 많은 매개변수로 인해 AI 모델의 동작 원리를 정확하게 이해하기 어렵고, 이는 통상적으로 블랙박스에 비유되곤 한다. AI가 어떤 기준으로 결정을 내는지 알 수 없다면, AI에 결함이나 오작동이 발생했을 때 이를 해결하기 어렵고, 이로 인해 AI가 적용되는 다양한 산업 분야에서 문제가 발생할 수 있다.

이에 대한 해답으로 제시된 것이 바로 설명 가능한 인공지능 (XAI)이다. XAI는 AI가 어떠한 결정을 내렸을 때, 그 근거가 무엇인지를 사람이 이해할 수 있도록 만드는 기술이다. <그림1> 생성형 AI 등 점점 더 복잡해지는 AI 기술의 등장으로 개발자, 사용자, 규제 기관 모두에게 XAI 시스템의 필요성이 강조되고 있다. 하지만, XAI는 일반적으로 엄청난 양의 데이터 처리를 요구하기 때문에, 이를 보다 효율적으로 동작할 수 있는 하드웨어 개발이 필요한 상황이다.

김경민 교수 연구팀은 교란(Perturbation) 기반 XAI 시스템을 서로 다른 멤리스터 소자를 이용해 하드웨어로 구현하는데 성공하였다. 세 가지 멤리스터 소자는 각각 휘발성 저항변화 특성, 아날로그 비휘발성 저항변화 특성, 아날로그 휘발성 저항변화 특성을 가지며 <그림 2>, 각 소자는 교란 기반 XAI 시스템의 필수적인 기능인 입력 데이터 교란, 벡터곱 연산, 그리고 신호 통합 기능을 수행한다.

연구팀은 개발된 XAI 하드웨어를 평가하기 위해, 흑백 패턴을 인식하는 신경망을 설계하였다. 여기에 개발한 XAI 하드웨어 시스템으로 설계한 신경망이 흑백 패턴을 인식하는 근거를 설명하였다. <그림3> 그 결과 기존 CMOS 기술 기반 시스템 대비 에너지 소비를 24배 감소하여 AI 판단의 이유를 제공하는 것을 확인하였다. <그림4>

KAIST 김경민 교수는 “AI 기술이 일상화되면서 AI 동작의 투명성 및 해석가능성이 중요해지고 있는데, 이번 연구는 다양한 종류의 멤리스터 소자를 이용해 AI 판단에 대한 근거를 제공하는 XAI 하드웨어 시스템을 구현할 수 있었다는 점에 큰 의의가 있다”며 “이 연구는 AI 의사 결정에 도달하는 과정을 이해하기 쉽게 설명을 제공함으로써 AI 시스템의 신뢰성 향상에 기여할 수 있어, 향후 의료, 금융, 법률 등 민감한 정보를 다루는 AI 기반 서비스에 적용될 수 있을 것으로 기대된다”고 밝혔다.

이번 연구는 KAIST 신소재공학과 송한찬 박사과정, 박우준 박사과정 학생이 공동 제1 저자로 참여했으며, 국제 학술지 ‘어드밴스드 머티리얼즈(Advanced Materials, IF: 29.4)’에 03월 20일 字 온라인 게재됐으며, 한국연구재단 중견연구사업, 차세대지능형반도체기술개발사업, PIM인공지능반도체핵심기술개발사업, 나노종합기술원 및 KAIST 도약연구사업의 지원을 받아 수행됐다. (논문명: Memristive Explainable Artificial Intelligence Hardware, 논문링크: https://doi.org/10.1002/adma.202400977)

2024.03.25 조회수 7393 정밀한 시각적 판단을 추론한 새로운 인공지능 가속칩 개발

우리 대학 전기및전자공학부 윤찬현, 김주영 교수 연구팀이 설명 가능한 인공지능(eXplainable AI, XAI) 기법을 처리하기 위한 노이즈(잡음)에 강한 다중 피라미드 활성화 맵 기반 주의집중 구조가 탑재된 인공지능 칩을 설계하고, 삼성전자 DS부문의 지원으로 설명가능 뉴로프로세싱 유닛(이하 EPU, Explainable neuro-Processing Unit)을 개발했다고 24일 밝혔다.

설명가능 인공지능이란 사람이 이해할 수 있고 신뢰할 수 있는 설명을 제공할 수 있는 인공지능 기법이다. 기존의 수학적 알고리즘으로 학습되는 인공지능은 학습예제에 편향되어 신뢰할 수 없거나, 수천억개의 매개변수를 사람이 이해할 수 없다는 문제점을 해결하기 위해, 왜 인공지능이 특정 결과를 추론했는지 판단근거를 설명할 수 있도록 개발되었다. 설명가능한 인공지능은 어떤 이유에 의해서 인공지능의 의사결정에 큰 영향을 주었는지 설명할 수 있다는 점에서 기존의 인공지능보다 정확성, 공정성, 신뢰성을 보장할 수 있다는 특징을 가진다.

공동연구팀은 다중 규모 및 다중물체의 특징 추출 구조인 피라미드형 신경망 구조에서 추론 결과에 영향을 주는 인공지능 내부의 신경층별 활성화되는 정도를 복합적으로 해석할 수 있는 인공지능 모델과 이를 가속처리 특화된 채널 방향 합성곱 연산 및 정확도를 유지하는 EPU칩을 구현했다.

다중 규모 및 다중물체 특징 추출에 특화된 피라미드형 인공지능 모델에서 설명 시각화 구현을 위해서는 추론 과정의 역방향으로 모든 합성곱 층별 활성화 맵에서 모델 파라미터의 변화도를 추출할 수 있는 구조가 요구된다.

그러나 역전파 계산 과정은 기존의 추론처리 가속을 위한 인공지능 칩 설계와 달리 이전 파라미터 및 상태를 기억해야 하며 이는 한정된 온 칩 메모리 크기 및 인공지능 모델 전체를 특정한 용도에 맞게 주문 제작(ASIC; Application Specific Integrated Circuit)해 구현하기에는 물리적 한계가 있다.

또한, 피라미드형 구조의 설명 가능한 인공지능 모델은 설명성 보장을 위한 N개 층의 활성화 맵으로부터 기울기 기반의 클래스 활성 맵핑 시각화 처리 각각 필요해 복잡도를 높이는 문제가 있다. 그리고, 입력의 매우 작은 노이즈에도 클래스 활성화 맵핑 시각화 설명이 완전히 달라져 설명 가능한 인공지능 모델의 신뢰도 저하가 큰 문제점이었다.

전기및전자공학부 윤찬현 교수 연구팀은 문제해결을 위해(그림1 참조) 설명 가능한 인공지능의 다중 활성화 맵 고유의 특성 정보를 융합해 전역 주의 집중 맵을 생성하는 네트워크 구조와 입력 이미지 노이즈에 강건한 모델 생성을 위한 상호학습 방법을 개발해, 단일 활성화 맵 기반 주의집중 맵 생성 기술에 비해 설명성 지표를 최대 6배가량 높였다.

또한, 다중 스케일의 다양한 주의집중 맵들의 상호 보완적인 특성을 일원화된 주의집중 맵으로 정교하게 재구성함으로써 사람이 해석 가능한 수준의 정밀한 설명성을 제공할 수 있게 했다. 이번 연구 성과를 통해 위성 영상과 같이 객체 크기 변화가 큰 이미지 분석에서 인공지능 모델의 설명성을 크게 향상할 수 있을 것으로 기대된다고 연구팀 관계자는 설명했다.

전기및전자공학부 김주영 교수 연구팀은 제안된 설명 가능한 인공지능 모델을 가속하기 위해 기존 모델의 추론과 역전파 과정에 더해 활성화 맵 생성까지 처리할 수 있는 XAI 코어를 개발하고, 다양한 연산 태스크를 유연하게 분할해 동시에 처리할 수 있는 멀티 데이터 플로우 방식을 제안했다. 또한, 많은 0 값을 포함하는 활성화 맵의 특성을 활용해, 연속된 0을 건너뛸 수 있는 새로운 데이터 압축 포맷을 제안하고 이를 지원하는 가속 유닛을 개발해 최대 10배 이상의 활성화 맵을 칩 내부에서 처리할 수 있도록 했다.

연구팀이 개발한 EPU 칩은 광학 위성, 전천후 관측 영상레이더(Synthetic Aperture Radar) 위성 등 특수 목적과 고정밀 인공지능 영상처리시스템에 적용할 수 있으며, 저지연‧저전력으로 인공지능 시스템의 판단 근거에 대한 설명성을 획기적으로 높일 수 있을 것으로 기대된다. 연구팀은 EPU 칩 개발 후속 연구를 진행할 계획이다.

2022.08.25 조회수 9301

정밀한 시각적 판단을 추론한 새로운 인공지능 가속칩 개발

우리 대학 전기및전자공학부 윤찬현, 김주영 교수 연구팀이 설명 가능한 인공지능(eXplainable AI, XAI) 기법을 처리하기 위한 노이즈(잡음)에 강한 다중 피라미드 활성화 맵 기반 주의집중 구조가 탑재된 인공지능 칩을 설계하고, 삼성전자 DS부문의 지원으로 설명가능 뉴로프로세싱 유닛(이하 EPU, Explainable neuro-Processing Unit)을 개발했다고 24일 밝혔다.

설명가능 인공지능이란 사람이 이해할 수 있고 신뢰할 수 있는 설명을 제공할 수 있는 인공지능 기법이다. 기존의 수학적 알고리즘으로 학습되는 인공지능은 학습예제에 편향되어 신뢰할 수 없거나, 수천억개의 매개변수를 사람이 이해할 수 없다는 문제점을 해결하기 위해, 왜 인공지능이 특정 결과를 추론했는지 판단근거를 설명할 수 있도록 개발되었다. 설명가능한 인공지능은 어떤 이유에 의해서 인공지능의 의사결정에 큰 영향을 주었는지 설명할 수 있다는 점에서 기존의 인공지능보다 정확성, 공정성, 신뢰성을 보장할 수 있다는 특징을 가진다.

공동연구팀은 다중 규모 및 다중물체의 특징 추출 구조인 피라미드형 신경망 구조에서 추론 결과에 영향을 주는 인공지능 내부의 신경층별 활성화되는 정도를 복합적으로 해석할 수 있는 인공지능 모델과 이를 가속처리 특화된 채널 방향 합성곱 연산 및 정확도를 유지하는 EPU칩을 구현했다.

다중 규모 및 다중물체 특징 추출에 특화된 피라미드형 인공지능 모델에서 설명 시각화 구현을 위해서는 추론 과정의 역방향으로 모든 합성곱 층별 활성화 맵에서 모델 파라미터의 변화도를 추출할 수 있는 구조가 요구된다.

그러나 역전파 계산 과정은 기존의 추론처리 가속을 위한 인공지능 칩 설계와 달리 이전 파라미터 및 상태를 기억해야 하며 이는 한정된 온 칩 메모리 크기 및 인공지능 모델 전체를 특정한 용도에 맞게 주문 제작(ASIC; Application Specific Integrated Circuit)해 구현하기에는 물리적 한계가 있다.

또한, 피라미드형 구조의 설명 가능한 인공지능 모델은 설명성 보장을 위한 N개 층의 활성화 맵으로부터 기울기 기반의 클래스 활성 맵핑 시각화 처리 각각 필요해 복잡도를 높이는 문제가 있다. 그리고, 입력의 매우 작은 노이즈에도 클래스 활성화 맵핑 시각화 설명이 완전히 달라져 설명 가능한 인공지능 모델의 신뢰도 저하가 큰 문제점이었다.

전기및전자공학부 윤찬현 교수 연구팀은 문제해결을 위해(그림1 참조) 설명 가능한 인공지능의 다중 활성화 맵 고유의 특성 정보를 융합해 전역 주의 집중 맵을 생성하는 네트워크 구조와 입력 이미지 노이즈에 강건한 모델 생성을 위한 상호학습 방법을 개발해, 단일 활성화 맵 기반 주의집중 맵 생성 기술에 비해 설명성 지표를 최대 6배가량 높였다.

또한, 다중 스케일의 다양한 주의집중 맵들의 상호 보완적인 특성을 일원화된 주의집중 맵으로 정교하게 재구성함으로써 사람이 해석 가능한 수준의 정밀한 설명성을 제공할 수 있게 했다. 이번 연구 성과를 통해 위성 영상과 같이 객체 크기 변화가 큰 이미지 분석에서 인공지능 모델의 설명성을 크게 향상할 수 있을 것으로 기대된다고 연구팀 관계자는 설명했다.

전기및전자공학부 김주영 교수 연구팀은 제안된 설명 가능한 인공지능 모델을 가속하기 위해 기존 모델의 추론과 역전파 과정에 더해 활성화 맵 생성까지 처리할 수 있는 XAI 코어를 개발하고, 다양한 연산 태스크를 유연하게 분할해 동시에 처리할 수 있는 멀티 데이터 플로우 방식을 제안했다. 또한, 많은 0 값을 포함하는 활성화 맵의 특성을 활용해, 연속된 0을 건너뛸 수 있는 새로운 데이터 압축 포맷을 제안하고 이를 지원하는 가속 유닛을 개발해 최대 10배 이상의 활성화 맵을 칩 내부에서 처리할 수 있도록 했다.

연구팀이 개발한 EPU 칩은 광학 위성, 전천후 관측 영상레이더(Synthetic Aperture Radar) 위성 등 특수 목적과 고정밀 인공지능 영상처리시스템에 적용할 수 있으며, 저지연‧저전력으로 인공지능 시스템의 판단 근거에 대한 설명성을 획기적으로 높일 수 있을 것으로 기대된다. 연구팀은 EPU 칩 개발 후속 연구를 진행할 계획이다.

2022.08.25 조회수 9301