%EC%95%88%EC%84%B1%EC%A7%84

-

딥러닝 대부 요슈아 벤지오 교수와 AI 연구센터 설립

우리 대학 전산학부 안성진 교수 연구팀이 세계적인 인공지능 권위자인 캐나다의 요슈아 벤지오(Yoshua Bengio) 교수와 함께 ‘KAIST-밀라(MILA) 프리프론탈 인공지능 연구센터’를 KAIST에 7월 1일부로 설립했다고 4일 밝혔다.

이 사업은 과학기술정보통신부와 한국연구재단이 지원하는 ‘2024년도 해외우수연구기관 협력허브구축사업’의 일환으로, 안성진 교수 연구팀은 2024년 7월부터 2028년 12월까지 총 27억 원의 지원을 받게 된다. 이 센터는 차세대 인공지능 기술 개발을 위한 국제공동연구의 중심지로서 역할을 하게 될 예정이다.

요슈아 벤지오 교수는 딥러닝 분야의 창시자 중 한 명으로, 현대 인공지능 연구에 지대한 영향을 미친 인물이다. 그의 연구는 현재의 딥러닝 기술을 탄생시키고 발전시키는 데 중요한 역할을 했다. KAIST 안성진 교수팀과의 이번 협력은 요슈아 벤지오 교수의 몬트리올 학습 알고리즘 연구소(MILA, Montreal Institute for Learning Algorithms)와 KAIST의 선도적인 인공지능 연구 역량을 결합해, 차세대 인공지능 기술 발전에 새로운 지평을 열 것으로 기대된다.

이번 연구의 핵심은 인간의 고위인지 능력을 모방하는 ‘시스템2’ AI 기술의 개발이다. 시스템2는 데니얼 카네만의 듀얼프로세스 이론에서 제시된 개념으로, 직관적이고 빠른 인지를 담당하는 ‘시스템1‘과 달리, 수학적 논리 추론 같이 복잡하고 순차적인 사고 과정을 담당하는 기능을 수행한다. 이 과정은 주로 뇌의 전두엽에서 이뤄지며, 계획, 판단, 추론 등 고차원적인 인지 기능을 관리한다. 대형언어모델의 발전에도 불구하고, 현재의 딥러닝 기술은 이러한 고위인지 기능을 효과적으로 구현하는 데 여전히 한계를 보이고 있다.

이번 연구는 이러한 한계를 극복하고, 전두엽이 담당하는 고위인지 기능을 AI에 통합하는 ‘프리프론탈 AI’를 구현하기 위한 기반 기술을 확보하는 것을 목표로 한다.

또한, 이번 연구에는 우리 대학 홍승훈 교수와 포항공과대학교(POSTECH)의 안성수 교수도 공동 연구진으로 참여할 예정이다. 홍승훈 교수는 시스템2 메타 학습 알고리즘을 연구하며, 안성수 교수는 시스템2 기능을 ‘과학을 위한 AI(AI4Science)’ 응용에 적용하기 위한 연구를 진행할 예정이다.

안성진 교수는 “요슈아 벤지오 교수와의 협력은 차세대 인공지능 기술 개발에 있어 중요한 이정표가 될 것이다”라며, “이 연구를 통해 인간의 전두엽이 수행하는 고위인지 기능을 모방하는 딥러닝 알고리즘을 개발하고, 안전하고 신뢰할 수 있는 인공지능 에이전트를 구현하는 기술적 기반을 마련할 수 있을 것이다”라고 연구의 의의를 설명했다.

이번 연구센터 설립을 통해 우리 대학은 국제적인 연구 네트워크를 강화하고, 인공지능 분야에서 세계적인 선도 기관으로서의 위치를 더욱 공고히 할 전망이다.

2024.09.04 조회수 7852

딥러닝 대부 요슈아 벤지오 교수와 AI 연구센터 설립

우리 대학 전산학부 안성진 교수 연구팀이 세계적인 인공지능 권위자인 캐나다의 요슈아 벤지오(Yoshua Bengio) 교수와 함께 ‘KAIST-밀라(MILA) 프리프론탈 인공지능 연구센터’를 KAIST에 7월 1일부로 설립했다고 4일 밝혔다.

이 사업은 과학기술정보통신부와 한국연구재단이 지원하는 ‘2024년도 해외우수연구기관 협력허브구축사업’의 일환으로, 안성진 교수 연구팀은 2024년 7월부터 2028년 12월까지 총 27억 원의 지원을 받게 된다. 이 센터는 차세대 인공지능 기술 개발을 위한 국제공동연구의 중심지로서 역할을 하게 될 예정이다.

요슈아 벤지오 교수는 딥러닝 분야의 창시자 중 한 명으로, 현대 인공지능 연구에 지대한 영향을 미친 인물이다. 그의 연구는 현재의 딥러닝 기술을 탄생시키고 발전시키는 데 중요한 역할을 했다. KAIST 안성진 교수팀과의 이번 협력은 요슈아 벤지오 교수의 몬트리올 학습 알고리즘 연구소(MILA, Montreal Institute for Learning Algorithms)와 KAIST의 선도적인 인공지능 연구 역량을 결합해, 차세대 인공지능 기술 발전에 새로운 지평을 열 것으로 기대된다.

이번 연구의 핵심은 인간의 고위인지 능력을 모방하는 ‘시스템2’ AI 기술의 개발이다. 시스템2는 데니얼 카네만의 듀얼프로세스 이론에서 제시된 개념으로, 직관적이고 빠른 인지를 담당하는 ‘시스템1‘과 달리, 수학적 논리 추론 같이 복잡하고 순차적인 사고 과정을 담당하는 기능을 수행한다. 이 과정은 주로 뇌의 전두엽에서 이뤄지며, 계획, 판단, 추론 등 고차원적인 인지 기능을 관리한다. 대형언어모델의 발전에도 불구하고, 현재의 딥러닝 기술은 이러한 고위인지 기능을 효과적으로 구현하는 데 여전히 한계를 보이고 있다.

이번 연구는 이러한 한계를 극복하고, 전두엽이 담당하는 고위인지 기능을 AI에 통합하는 ‘프리프론탈 AI’를 구현하기 위한 기반 기술을 확보하는 것을 목표로 한다.

또한, 이번 연구에는 우리 대학 홍승훈 교수와 포항공과대학교(POSTECH)의 안성수 교수도 공동 연구진으로 참여할 예정이다. 홍승훈 교수는 시스템2 메타 학습 알고리즘을 연구하며, 안성수 교수는 시스템2 기능을 ‘과학을 위한 AI(AI4Science)’ 응용에 적용하기 위한 연구를 진행할 예정이다.

안성진 교수는 “요슈아 벤지오 교수와의 협력은 차세대 인공지능 기술 개발에 있어 중요한 이정표가 될 것이다”라며, “이 연구를 통해 인간의 전두엽이 수행하는 고위인지 기능을 모방하는 딥러닝 알고리즘을 개발하고, 안전하고 신뢰할 수 있는 인공지능 에이전트를 구현하는 기술적 기반을 마련할 수 있을 것이다”라고 연구의 의의를 설명했다.

이번 연구센터 설립을 통해 우리 대학은 국제적인 연구 네트워크를 강화하고, 인공지능 분야에서 세계적인 선도 기관으로서의 위치를 더욱 공고히 할 전망이다.

2024.09.04 조회수 7852 -

구글딥마인드와 공동연구를 통해 인공지능으로 시각을 상상하다

‘노란 포도'나 `보라색 바나나'와 같이 본 적 없는 시각 개념을 이해하고 상상하는 인공지능 능력 구현이 가능해졌다.

우리 대학 전산학부 안성진 교수 연구팀이 구글 딥마인드 및 미국 럿거스 대학교와의 국제 공동 연구를 통해 시각적 지식을 체계적으로 조합해 새로운 개념을 이해하는 인공지능 새로운 모델과 프로그램을 수행하는 벤치마크를 개발했다고 30일 밝혔다.

인간은 `보라색 포도'와 `노란 바나나' 같은 개념을 학습하고, 이를 분리한 뒤 재조합해 `노란 포도'나 `보라색 바나나'와 같이 본 적 없는 개념을 상상하는 능력이 있다. 이런 능력은 체계적 일반화 혹은 조합적 일반화라고 불리며, 범용 인공지능을 구현하는 데 있어 핵심적인 요소로 여겨진다.

체계적 일반화 문제는 1988년 미국의 저명한 인지과학자 제리 포더(Jerry Fodor)와 제논 필리쉰(Zenon Pylyshyn)이 인공신경망이 이 문제를 해결할 수 없다고 주장한 이후, 35년 동안 인공지능 딥러닝 분야에서 큰 도전 과제로 남아 있다. 이 문제는 언어뿐만 아니라 시각 정보에서도 발생하지만, 지금까지는 주로 언어의 체계적 일반화에만 초점이 맞춰져 있었고, 시각 정보에 관한 연구는 상대적으로 부족했다.

안성진 교수가 이끄는 국제 공동 연구팀은 이러한 공백을 메우고자 시각 정보에 대한 체계적 일반화를 연구할 수 있는 벤치마크를 개발했다. 시각 정보는 언어와는 달리 명확한 `단어'나 `토큰'의 구조가 없어, 이 구조를 학습하고 체계적 일반화를 달성하는 것이 큰 도전이다.

연구를 주도한 안성진 교수는 “시각 정보의 체계적 일반화가 범용 인공지능을 달성하기 위해 필수적인 능력이며 이 연구를 통해 인공지능의 추론능력과 상상능력 관련 분야의 발전을 가속할 것으로 기대한다”고 말했다.

또한, 딥마인드의 책임 연구원으로 연구에 참여한 연구원이자 현재 스위스 로잔연방공과대학교(EPFL)의 찰라 걸셔(Caglar Gulcehre) 교수는 “체계적 일반화가 가능해지면 현재보다 훨씬 적은 데이터로 더 높은 성능을 낼 수 있게 될 것이다”라고 전했다.

이번 연구는 12월 10일부터 16일까지 미국 뉴올리언스에서 열리는 제37회 신경정보처리학회(NeurIPS)에서 발표될 예정이다.

관련논문: “Imagine the Unseen World: A Benchmark for Systematic Generalization in Visual World Models”, Yeongbin Kim, Gautam Singh, Junyeong Park, Caglar Gulcehre, Sungjin Ahn, NeurIPS 23

2023.11.30 조회수 8310

구글딥마인드와 공동연구를 통해 인공지능으로 시각을 상상하다

‘노란 포도'나 `보라색 바나나'와 같이 본 적 없는 시각 개념을 이해하고 상상하는 인공지능 능력 구현이 가능해졌다.

우리 대학 전산학부 안성진 교수 연구팀이 구글 딥마인드 및 미국 럿거스 대학교와의 국제 공동 연구를 통해 시각적 지식을 체계적으로 조합해 새로운 개념을 이해하는 인공지능 새로운 모델과 프로그램을 수행하는 벤치마크를 개발했다고 30일 밝혔다.

인간은 `보라색 포도'와 `노란 바나나' 같은 개념을 학습하고, 이를 분리한 뒤 재조합해 `노란 포도'나 `보라색 바나나'와 같이 본 적 없는 개념을 상상하는 능력이 있다. 이런 능력은 체계적 일반화 혹은 조합적 일반화라고 불리며, 범용 인공지능을 구현하는 데 있어 핵심적인 요소로 여겨진다.

체계적 일반화 문제는 1988년 미국의 저명한 인지과학자 제리 포더(Jerry Fodor)와 제논 필리쉰(Zenon Pylyshyn)이 인공신경망이 이 문제를 해결할 수 없다고 주장한 이후, 35년 동안 인공지능 딥러닝 분야에서 큰 도전 과제로 남아 있다. 이 문제는 언어뿐만 아니라 시각 정보에서도 발생하지만, 지금까지는 주로 언어의 체계적 일반화에만 초점이 맞춰져 있었고, 시각 정보에 관한 연구는 상대적으로 부족했다.

안성진 교수가 이끄는 국제 공동 연구팀은 이러한 공백을 메우고자 시각 정보에 대한 체계적 일반화를 연구할 수 있는 벤치마크를 개발했다. 시각 정보는 언어와는 달리 명확한 `단어'나 `토큰'의 구조가 없어, 이 구조를 학습하고 체계적 일반화를 달성하는 것이 큰 도전이다.

연구를 주도한 안성진 교수는 “시각 정보의 체계적 일반화가 범용 인공지능을 달성하기 위해 필수적인 능력이며 이 연구를 통해 인공지능의 추론능력과 상상능력 관련 분야의 발전을 가속할 것으로 기대한다”고 말했다.

또한, 딥마인드의 책임 연구원으로 연구에 참여한 연구원이자 현재 스위스 로잔연방공과대학교(EPFL)의 찰라 걸셔(Caglar Gulcehre) 교수는 “체계적 일반화가 가능해지면 현재보다 훨씬 적은 데이터로 더 높은 성능을 낼 수 있게 될 것이다”라고 전했다.

이번 연구는 12월 10일부터 16일까지 미국 뉴올리언스에서 열리는 제37회 신경정보처리학회(NeurIPS)에서 발표될 예정이다.

관련논문: “Imagine the Unseen World: A Benchmark for Systematic Generalization in Visual World Models”, Yeongbin Kim, Gautam Singh, Junyeong Park, Caglar Gulcehre, Sungjin Ahn, NeurIPS 23

2023.11.30 조회수 8310 -

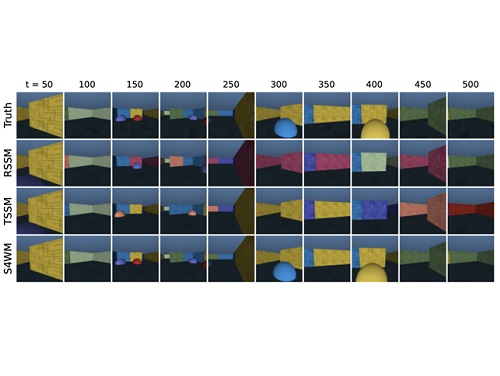

트랜스포머 대체할 차세대 월드모델 기술 세계 최초 개발

우리 대학 전산학부 안성진 교수 연구팀이 미국 럿거스 대학교와 협력하여 트랜스포머 및 재귀신경망 기반의 월드모델을 대체할 차세대 에이전트 월드모델 기술을 세계 최초로 개발했다.

월드모델은 인간의 뇌가 현실 세계의 경험을 바탕으로 환경 모델을 구축하는 과정과 유사하다. 이러한 월드모델을 활용하는 인공지능은 특정 행동의 결과를 미리 시뮬레이션해보고 다양한 가설을 검증할 수 있어, 범용 인공지능의 핵심 구성 요소로 여겨진다.

특히, 로봇이나 자율주행 차량과 같은 인공지능 에이전트는 학습을 위해 여러 가지 행동을 시도해 보아야하는데, 이는 위험성과 고장 가능성을 높인다는 단점을 갖는다. 이에 반해, 월드모델을 갖춘 인공지능은 실세계 상호작용 없이도 상상모델 속에서 학습을 가능케 해 큰 이점을 제공한다.

그러나 월드모델은 자연어처리 등에서 큰 발전을 가능하게 한 트랜스포머와 S4와 같은 새로운 시퀀스 모델링 아키텍처의 적용에 한계가 있었다. 이로 인해, 대부분의 월드모델이 성능과 효율성 면에서 제약이 있는 고전적인 재귀적 신경망에 의존하고 있었고 안성진 교수팀은 작년 세계최초로 트랜스포머 기반의 월드모델을 개발하였으나 추론 계산속도나 메모리능력에서 여전히 개선할 문제를 갖고 있었다.

이러한 문제를 해결하기 위해, 안성진 교수가 이끄는 KAIST와 럿거스 대학교 공동연구팀은 재귀적 신경망과 트랜스포머 기반 월드모델의 단점을 극복한 새로운 월드모델의 개발에 성공했다. 연구팀은 S4 시퀀스 모델에 기반한 S4 World Model (S4WM)을 개발하여, 재귀적 신경망의 최대 단점인 병렬처리가 가능한 시퀀스 학습이 불가능하다는 문제를 해결하였다. 또한, 재귀적 신경망의 장점인 빠른 추론시간을 유지하도록 하여 느린 추론 시간을 제공하는 트랜스포머 기반 월드모델의 단점을 극복했다.

연구를 주도한 안성진 교수는 "병렬 학습과 빠른 추론이 가능한 에이전트 월드모델을 세계 최초로 개발했다ˮ며, 이는 "모델기반 강화학습 능력을 획기적으로 개선해 지능형 로봇, 자율주행 차량, 그리고 자율형 인공지능 에이전트 기술 전반에 비용절감과 성능 향상이 예상된다ˮ고 밝혔다.

이번 연구는 12월 10일부터 16일까지 미국 뉴올리언스에서 열리는 세계 최고 수준의 인공지능 학회인 제37회 신경정보처리학회(NeurIPS)에서 발표될 예정이다.

관련논문: “Facing off World Model Backbones: RNNs, Transformers, and S4”Fei Deng, Junyeong Park, Sungjin Ahn, NeurIPS 23, https://arxiv.org/abs/2307.02064

2023.11.09 조회수 7140

트랜스포머 대체할 차세대 월드모델 기술 세계 최초 개발

우리 대학 전산학부 안성진 교수 연구팀이 미국 럿거스 대학교와 협력하여 트랜스포머 및 재귀신경망 기반의 월드모델을 대체할 차세대 에이전트 월드모델 기술을 세계 최초로 개발했다.

월드모델은 인간의 뇌가 현실 세계의 경험을 바탕으로 환경 모델을 구축하는 과정과 유사하다. 이러한 월드모델을 활용하는 인공지능은 특정 행동의 결과를 미리 시뮬레이션해보고 다양한 가설을 검증할 수 있어, 범용 인공지능의 핵심 구성 요소로 여겨진다.

특히, 로봇이나 자율주행 차량과 같은 인공지능 에이전트는 학습을 위해 여러 가지 행동을 시도해 보아야하는데, 이는 위험성과 고장 가능성을 높인다는 단점을 갖는다. 이에 반해, 월드모델을 갖춘 인공지능은 실세계 상호작용 없이도 상상모델 속에서 학습을 가능케 해 큰 이점을 제공한다.

그러나 월드모델은 자연어처리 등에서 큰 발전을 가능하게 한 트랜스포머와 S4와 같은 새로운 시퀀스 모델링 아키텍처의 적용에 한계가 있었다. 이로 인해, 대부분의 월드모델이 성능과 효율성 면에서 제약이 있는 고전적인 재귀적 신경망에 의존하고 있었고 안성진 교수팀은 작년 세계최초로 트랜스포머 기반의 월드모델을 개발하였으나 추론 계산속도나 메모리능력에서 여전히 개선할 문제를 갖고 있었다.

이러한 문제를 해결하기 위해, 안성진 교수가 이끄는 KAIST와 럿거스 대학교 공동연구팀은 재귀적 신경망과 트랜스포머 기반 월드모델의 단점을 극복한 새로운 월드모델의 개발에 성공했다. 연구팀은 S4 시퀀스 모델에 기반한 S4 World Model (S4WM)을 개발하여, 재귀적 신경망의 최대 단점인 병렬처리가 가능한 시퀀스 학습이 불가능하다는 문제를 해결하였다. 또한, 재귀적 신경망의 장점인 빠른 추론시간을 유지하도록 하여 느린 추론 시간을 제공하는 트랜스포머 기반 월드모델의 단점을 극복했다.

연구를 주도한 안성진 교수는 "병렬 학습과 빠른 추론이 가능한 에이전트 월드모델을 세계 최초로 개발했다ˮ며, 이는 "모델기반 강화학습 능력을 획기적으로 개선해 지능형 로봇, 자율주행 차량, 그리고 자율형 인공지능 에이전트 기술 전반에 비용절감과 성능 향상이 예상된다ˮ고 밝혔다.

이번 연구는 12월 10일부터 16일까지 미국 뉴올리언스에서 열리는 세계 최고 수준의 인공지능 학회인 제37회 신경정보처리학회(NeurIPS)에서 발표될 예정이다.

관련논문: “Facing off World Model Backbones: RNNs, Transformers, and S4”Fei Deng, Junyeong Park, Sungjin Ahn, NeurIPS 23, https://arxiv.org/abs/2307.02064

2023.11.09 조회수 7140 -

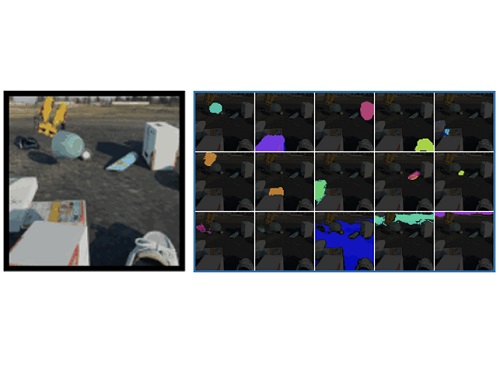

세계 최초로 사람처럼 사물의 개념을 스스로 학습하는 장면 인식 기술 개발

우리 대학 전산학부 안성진 교수 연구팀이 미국 럿거스(Rutgers) 대학교와 공동연구를 통해 사람의 라벨링 없이 스스로 영상 속 객체를 식별할 수 있는 인공지능 기술을 개발했다고 1일 밝혔다. 이 모델은 복잡한 영상에서 각 장면의 객체들에 대한 명시적인 라벨링 없이도 객체를 식별하는 최초의 인공지능 모델이다.

기계가 주변 환경을 지능적으로 인지하고 추론하기 위해서는 시각적 장면을 구성하는 객체들과 그들의 관계를 파악하는 능력이 필수적이다. 하지만 이 분야의 연구는 대부분 영상의 각 픽셀에 대응하는 객체의 라벨을 사람이 일일이 표시해야 하는 지도적 학습 방식을 사용했다. 이 같은 수작업은 오류가 발생하기 쉽고 많은 시간과 비용을 요구한다는 단점이 있다.

이에 반해 이번에 연구팀이 개발한 기술은 인간과 유사하게 환경에 대한 관측만으로 객체의 개념을 스스로 자가 학습하는 방식을 취한다. 이렇게 인간의 지도 없이 스스로 객체의 개념을 학습할 수 있는 인공지능은 차세대 인지 기술의 핵심으로 기대돼왔다.

비지도 학습을 이용한 이전 연구들은 단순한 객체 형태와 배경이 명확히 구분될 수 있는 단순한 장면에서만 객체를 식별하는 단점이 있었다. 이와 달리 이번에 안성진 교수 연구팀이 개발한 기술은 복잡한 형태의 많은 객체가 존재하는 사실적인 장면에도 적용될 수 있는 최초의 모델이다.

이 연구는 그림 인공지능 소프트웨어인 DALL-E와 같이 텍스트 입력을 통해 사실적인 이미지를 생성할 수 있는 이미지 생성 연구에서 영감을 얻었다. 연구팀은 텍스트를 입력하는 대신, 모델이 장면에서 객체를 감지하고 그 객체의 표상(representation)으로부터 이미지를 생성하는 방식으로 모델을 학습시켰다. 또한, 모델에 DALL-E와 유사한 트랜스포머 디코더를 사용하는 것이 사실적이고 복잡한 영상을 처리할 수 있게 한 주요 요인이라고 밝혔다.

연구팀은 복잡하고 정제되지 않은 영상뿐만 아니라, 많은 물고기가 있는 수족관과 교통이 혼잡한 도로의 상황을 담은 유튜브 영상과 같이 복잡한 실제 영상에서도 모델의 성능을 측정했다. 그 결과, 제시된 모델이 기존 모델보다 객체를 훨씬 더 정확하게 분할하고 일반화하는 것을 확인할 수 있었다.

연구팀을 이끈 안성진 교수는 "인간과 유사한 자가 학습 방식으로 상황을 인지하고 해석하는 혁신적인 기술ˮ이라며 "시각적 상황인지 능력을 획기적으로 개선해 지능형 로봇 분야, 자율 주행 분야뿐만 아니라 시각적 인공지능 기술 전반에 비용 절감과 성능향상을 가져올 수 있다ˮ고 말했다.

이번 연구는 미국 뉴올리언스에서 지난 11월 28일부터 개최되어 12월 9일까지 진행 예정인 세계 최고 수준의 기계학습(머신러닝) 학회인 제36회 신경정보처리학회(NeurIPS)에서 발표됐다.

2022.12.02 조회수 9011

세계 최초로 사람처럼 사물의 개념을 스스로 학습하는 장면 인식 기술 개발

우리 대학 전산학부 안성진 교수 연구팀이 미국 럿거스(Rutgers) 대학교와 공동연구를 통해 사람의 라벨링 없이 스스로 영상 속 객체를 식별할 수 있는 인공지능 기술을 개발했다고 1일 밝혔다. 이 모델은 복잡한 영상에서 각 장면의 객체들에 대한 명시적인 라벨링 없이도 객체를 식별하는 최초의 인공지능 모델이다.

기계가 주변 환경을 지능적으로 인지하고 추론하기 위해서는 시각적 장면을 구성하는 객체들과 그들의 관계를 파악하는 능력이 필수적이다. 하지만 이 분야의 연구는 대부분 영상의 각 픽셀에 대응하는 객체의 라벨을 사람이 일일이 표시해야 하는 지도적 학습 방식을 사용했다. 이 같은 수작업은 오류가 발생하기 쉽고 많은 시간과 비용을 요구한다는 단점이 있다.

이에 반해 이번에 연구팀이 개발한 기술은 인간과 유사하게 환경에 대한 관측만으로 객체의 개념을 스스로 자가 학습하는 방식을 취한다. 이렇게 인간의 지도 없이 스스로 객체의 개념을 학습할 수 있는 인공지능은 차세대 인지 기술의 핵심으로 기대돼왔다.

비지도 학습을 이용한 이전 연구들은 단순한 객체 형태와 배경이 명확히 구분될 수 있는 단순한 장면에서만 객체를 식별하는 단점이 있었다. 이와 달리 이번에 안성진 교수 연구팀이 개발한 기술은 복잡한 형태의 많은 객체가 존재하는 사실적인 장면에도 적용될 수 있는 최초의 모델이다.

이 연구는 그림 인공지능 소프트웨어인 DALL-E와 같이 텍스트 입력을 통해 사실적인 이미지를 생성할 수 있는 이미지 생성 연구에서 영감을 얻었다. 연구팀은 텍스트를 입력하는 대신, 모델이 장면에서 객체를 감지하고 그 객체의 표상(representation)으로부터 이미지를 생성하는 방식으로 모델을 학습시켰다. 또한, 모델에 DALL-E와 유사한 트랜스포머 디코더를 사용하는 것이 사실적이고 복잡한 영상을 처리할 수 있게 한 주요 요인이라고 밝혔다.

연구팀은 복잡하고 정제되지 않은 영상뿐만 아니라, 많은 물고기가 있는 수족관과 교통이 혼잡한 도로의 상황을 담은 유튜브 영상과 같이 복잡한 실제 영상에서도 모델의 성능을 측정했다. 그 결과, 제시된 모델이 기존 모델보다 객체를 훨씬 더 정확하게 분할하고 일반화하는 것을 확인할 수 있었다.

연구팀을 이끈 안성진 교수는 "인간과 유사한 자가 학습 방식으로 상황을 인지하고 해석하는 혁신적인 기술ˮ이라며 "시각적 상황인지 능력을 획기적으로 개선해 지능형 로봇 분야, 자율 주행 분야뿐만 아니라 시각적 인공지능 기술 전반에 비용 절감과 성능향상을 가져올 수 있다ˮ고 말했다.

이번 연구는 미국 뉴올리언스에서 지난 11월 28일부터 개최되어 12월 9일까지 진행 예정인 세계 최고 수준의 기계학습(머신러닝) 학회인 제36회 신경정보처리학회(NeurIPS)에서 발표됐다.

2022.12.02 조회수 9011