%EC%8B%A0%EA%B2%BD%EB%A7%9D%EC%B2%98%EB%A6%AC%EC%9E%A5%EC%B9%98

-

60% 이상 챗GPT 추론 성능 향상할 NPU 핵심기술 개발

오픈AI 챗GPT4, 구글 Gemnini 2.5 등 최신 생성형AI 모델들은 높은 메모리 대역폭(Bandwidth) 뿐만 아니라 많은 메모리 용량(Capacity)를 필요로 한다. 마이크로소프트, 구글 등 생성형AI 클라우드 운영 기업들이 엔비디아 GPU를 수십만 장씩 구매하는 이유다. 이런 고성능 AI 인프라 구축의 핵심 난제를 해소할 방안으로, 한국 연구진이 최신 GPU 대비 약 44% 낮은 전력 소모에도 평균 60% 이상 생성형 AI 모델의 추론 성능을 향상할 NPU(신경망처리장치)* 핵심 기술을 개발하는데 성공했다.

*NPU(Neural Processing Unit): 인공신경망(Neural Network)을 빠르게 처리하기 위해 만든 AI 전용 반도체 칩

우리 대학 전산학부 박종세 교수 연구팀과 (주)하이퍼엑셀(전기및전자공학부 김주영 교수 창업기업)이 연구 협력을 통해, 챗GPT와 같은 생성형AI 클라우드에 특화된 고성능·저전력의 NPU(신경망처리장치) 핵심기술을 개발했다고 4일 밝혔다.

연구팀이 제안한 기술은 컴퓨터 아키텍처 분야에서 최고 권위를 자랑하는 국제 학회인 ‘2025 국제 컴퓨터구조 심포지엄(International Symposium on Computer Architecture, ISCA 2025)’에 채택됐다.

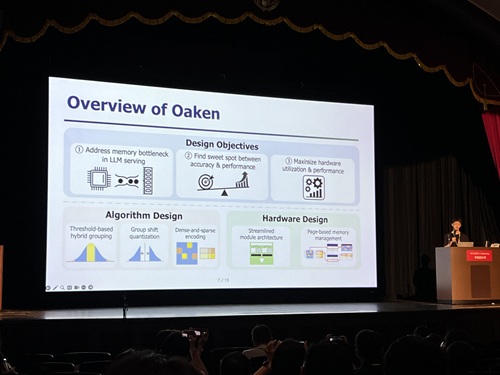

이번 연구의 핵심은 추론 과정에서 경량화를 통해 정확도 손실을 최소화하면서도 메모리 병목 문제를 해결해 대규모 생성형AI 서비스의 성능을 개선하는 것이다. 이번 연구는 AI인프라의 핵심 구성요소인 AI반도체와 AI시스템SW를 통합 설계했다는 점에서 그 가치를 높게 인정받았다.

기존 GPU 기반 AI 인프라는 높은 메모리 대역폭과 메모리 용량 요구를 충족하기 위해 다수의 GPU 디바이스가 필요한 반면, 이번 기술은 메모리 사용의 대부분을 차지하는 KV 캐시의 양자화*를 통해 적은 수의 NPU 디바이스만으로 동일 수준의 AI 인프라를 구성할 수 있어, 생성형 AI 클라우드 구축 비용을 크게 절감할 수 있다.

*KV 캐시(Key-Value Cache)의 양자화: 생성형 AI 모델을 작동할 때 성능을 높이기 위해 사용하는 일종의 임시 저장 공간에 데이터 크기를 줄이는 것을 의미(32비트로 저장된 수를 4비트로 바꾸면, 데이터 크기는 1/8로 줄어듬)

연구팀은 기존 NPU 아키텍처의 연산 로직을 변경하지 않으면서 메모리 인터페이스와 통합될 수 있도록 설계했다. 이번 하드웨어 아키텍처 기술은 제안된 양자화 알고리즘을 구현할 뿐만 아니라, 제한된 메모리 대역폭 및 용량을 효율적으로 활용하기 위한 페이지 단위 메모리 관리 기법*과 양자화된 KV 캐시에 최적화된 새로운 인코딩 기법 등을 개발했다.

*페이지 단위 메모리 관리 기법: CPU처럼 메모리 주소를 가상화하여 NPU 내부에서 일관된 방식으로 접근할 수 있게 함

또한, 최신 GPU 대비 비용·전력 효율성이 우수한 NPU 기반 AI 클라우드를 구성할 경우, NPU의 고성능, 저전력 특성을 활용해 운영 비용 역시 크게 절감할 수 있을 것으로 기대된다.

박종세 교수는 “이 연구는 (주)하이퍼엑셀과의 공동연구를 통해 생성형AI 추론 경량화 알고리즘에서 그 해법을 찾았고 ‘메모리 문제’를 해결할 수 있는 NPU 핵심기술 개발에 성공했다. 이 기술을 통해 추론의 정확도를 유지하면서 메모리 요구량을 줄이는 경량화 기법과, 이에 최적화된 하드웨어 설계를 결합해 최신 GPU 대비 평균 60% 이상 성능이 향상된 NPU를 구현했다” 고 말했다.

이어 “이 기술은 생성형AI에 특화된 고성능·저전력 인프라 구현 가능성을 입증했으며, AI클라우드 데이터센터뿐 아니라 능동적인 실행형 AI인 ‘에이전틱 AI ’등으로 대표되는 AI 대전환(AX) 환경에서도 핵심 역할이 기대된다”고 강조했다.

이 연구는 김민수 박사과정 학생과 ㈜하이퍼엑셀 홍성민 박사가 공동 제1 저자로 지난 6월 21일부터 6월 25일까지 일본 도쿄에서 열린 ‘2025 국제 컴퓨터구조 심포지엄(ISCA)’에 발표됐다. 국제적 저명학회인 ISCA는 올해는 570편의 논문이 제출됐으며 그중 127편 만이 채택됐다. (채택률 22.7%).

※논문 제목: Oaken: Fast and Efficient LLM Serving with Online-Offline Hybrid KV Cache Quantization

※DOI: https://doi.org/10.1145/3695053.3731019

한편 이번 연구는 한국연구재단 우수신진연구자지원사업, 정보통신기획평가원(IITP), 인공지능반도체대학원지원사업의 지원을 받아 수행됐다.

2025.07.04 조회수 101

60% 이상 챗GPT 추론 성능 향상할 NPU 핵심기술 개발

오픈AI 챗GPT4, 구글 Gemnini 2.5 등 최신 생성형AI 모델들은 높은 메모리 대역폭(Bandwidth) 뿐만 아니라 많은 메모리 용량(Capacity)를 필요로 한다. 마이크로소프트, 구글 등 생성형AI 클라우드 운영 기업들이 엔비디아 GPU를 수십만 장씩 구매하는 이유다. 이런 고성능 AI 인프라 구축의 핵심 난제를 해소할 방안으로, 한국 연구진이 최신 GPU 대비 약 44% 낮은 전력 소모에도 평균 60% 이상 생성형 AI 모델의 추론 성능을 향상할 NPU(신경망처리장치)* 핵심 기술을 개발하는데 성공했다.

*NPU(Neural Processing Unit): 인공신경망(Neural Network)을 빠르게 처리하기 위해 만든 AI 전용 반도체 칩

우리 대학 전산학부 박종세 교수 연구팀과 (주)하이퍼엑셀(전기및전자공학부 김주영 교수 창업기업)이 연구 협력을 통해, 챗GPT와 같은 생성형AI 클라우드에 특화된 고성능·저전력의 NPU(신경망처리장치) 핵심기술을 개발했다고 4일 밝혔다.

연구팀이 제안한 기술은 컴퓨터 아키텍처 분야에서 최고 권위를 자랑하는 국제 학회인 ‘2025 국제 컴퓨터구조 심포지엄(International Symposium on Computer Architecture, ISCA 2025)’에 채택됐다.

이번 연구의 핵심은 추론 과정에서 경량화를 통해 정확도 손실을 최소화하면서도 메모리 병목 문제를 해결해 대규모 생성형AI 서비스의 성능을 개선하는 것이다. 이번 연구는 AI인프라의 핵심 구성요소인 AI반도체와 AI시스템SW를 통합 설계했다는 점에서 그 가치를 높게 인정받았다.

기존 GPU 기반 AI 인프라는 높은 메모리 대역폭과 메모리 용량 요구를 충족하기 위해 다수의 GPU 디바이스가 필요한 반면, 이번 기술은 메모리 사용의 대부분을 차지하는 KV 캐시의 양자화*를 통해 적은 수의 NPU 디바이스만으로 동일 수준의 AI 인프라를 구성할 수 있어, 생성형 AI 클라우드 구축 비용을 크게 절감할 수 있다.

*KV 캐시(Key-Value Cache)의 양자화: 생성형 AI 모델을 작동할 때 성능을 높이기 위해 사용하는 일종의 임시 저장 공간에 데이터 크기를 줄이는 것을 의미(32비트로 저장된 수를 4비트로 바꾸면, 데이터 크기는 1/8로 줄어듬)

연구팀은 기존 NPU 아키텍처의 연산 로직을 변경하지 않으면서 메모리 인터페이스와 통합될 수 있도록 설계했다. 이번 하드웨어 아키텍처 기술은 제안된 양자화 알고리즘을 구현할 뿐만 아니라, 제한된 메모리 대역폭 및 용량을 효율적으로 활용하기 위한 페이지 단위 메모리 관리 기법*과 양자화된 KV 캐시에 최적화된 새로운 인코딩 기법 등을 개발했다.

*페이지 단위 메모리 관리 기법: CPU처럼 메모리 주소를 가상화하여 NPU 내부에서 일관된 방식으로 접근할 수 있게 함

또한, 최신 GPU 대비 비용·전력 효율성이 우수한 NPU 기반 AI 클라우드를 구성할 경우, NPU의 고성능, 저전력 특성을 활용해 운영 비용 역시 크게 절감할 수 있을 것으로 기대된다.

박종세 교수는 “이 연구는 (주)하이퍼엑셀과의 공동연구를 통해 생성형AI 추론 경량화 알고리즘에서 그 해법을 찾았고 ‘메모리 문제’를 해결할 수 있는 NPU 핵심기술 개발에 성공했다. 이 기술을 통해 추론의 정확도를 유지하면서 메모리 요구량을 줄이는 경량화 기법과, 이에 최적화된 하드웨어 설계를 결합해 최신 GPU 대비 평균 60% 이상 성능이 향상된 NPU를 구현했다” 고 말했다.

이어 “이 기술은 생성형AI에 특화된 고성능·저전력 인프라 구현 가능성을 입증했으며, AI클라우드 데이터센터뿐 아니라 능동적인 실행형 AI인 ‘에이전틱 AI ’등으로 대표되는 AI 대전환(AX) 환경에서도 핵심 역할이 기대된다”고 강조했다.

이 연구는 김민수 박사과정 학생과 ㈜하이퍼엑셀 홍성민 박사가 공동 제1 저자로 지난 6월 21일부터 6월 25일까지 일본 도쿄에서 열린 ‘2025 국제 컴퓨터구조 심포지엄(ISCA)’에 발표됐다. 국제적 저명학회인 ISCA는 올해는 570편의 논문이 제출됐으며 그중 127편 만이 채택됐다. (채택률 22.7%).

※논문 제목: Oaken: Fast and Efficient LLM Serving with Online-Offline Hybrid KV Cache Quantization

※DOI: https://doi.org/10.1145/3695053.3731019

한편 이번 연구는 한국연구재단 우수신진연구자지원사업, 정보통신기획평가원(IITP), 인공지능반도체대학원지원사업의 지원을 받아 수행됐다.

2025.07.04 조회수 101 -

로봇 등 온디바이스 인공지능 실현 가능

자율주행차, 로봇 등 온디바이스 자율 시스템 환경에서 클라우드의 원격 컴퓨팅 자원 없이 기기 자체에 내장된 인공지능 칩을 활용한 온디바이스 자원만으로 적응형 AI를 실현하는 기술이 개발됐다.

우리 대학 전산학부 박종세 교수 연구팀이 지난 6월 29일부터 7월 3일까지 아르헨티나 부에노스아이레스에서 열린 ‘2024 국제 컴퓨터구조 심포지엄(International Symposium on Computer Architecture, ISCA 2024)’에서 최우수 연구 기록물상(Distinguished Artifact Award)을 수상했다고 1일 밝혔다.

* 논문명: 자율 시스템의 비디오 분석을 위한 연속학습 가속화 기법(DaCapo: Accelerating Continuous Learning in Autonomous Systems for Video Analytics)

국제 컴퓨터 구조 심포지움(ISCA)은 컴퓨터 아키텍처 분야에서 최고 권위를 자랑하는 국제 학회로 올해는 423편의 논문이 제출됐으며 그중 83편 만이 채택됐다. (채택률 19.6%). 최우수 연구 기록물 상은 학회에서 주어지는 특별한 상 중 하나로, 제출 논문 중 연구 기록물의 혁신성, 활용 가능성, 영향력을 고려해 선정된다.

이번 수상 연구는 적응형 AI의 기반 기술인 ‘연속 학습’ 가속을 위한 NPU(신경망처리장치) 구조 및 온디바이스 소프트웨어 시스템을 최초 개발한 점, 향후 온디바이스 AI 시스템 연구의 지속적인 발전을 위해 오픈소스로 공개한 코드, 데이터 등의 완성도 측면에서 높은 평가를 받았다.

연구 결과는 소프트웨어 중심 자동차(SDV; Software-Defined Vehicles), 소프트웨어 중심 로봇(SDR; Software-Defined Robots)으로 대표되는 미래 모빌리티 환경에서 온디바이스 AI 시스템을 구축하는 등 다양한 분야에 활용될 수 있을 것으로 기대된다.

상을 받은 전산학부 박종세 교수는 “이번 연구를 통해 온디바이스 자원만으로 적응형 AI를 실현할 수 있다는 것을 입증하게 되어 매우 기쁘고 이 성과는 학생들의 헌신적인 노력과 구글 및 메타 연구자들과의 긴밀한 협력 덕분이다”라며, “앞으로도 온디바이스 AI를 위한 하드웨어와 소프트웨어 연구를 지속해 나갈 것이다”라고 소감을 전했다.

이번 연구는 우리 대학 전산학부 김윤성, 오창훈, 황진우, 김원웅, 오성룡, 이유빈 학생들과 메타(Meta)의 하딕 샤르마(Hardik Sharma) 박사, 구글 딥마인드(Google Deepmind)의 아미르 야즈단바크시(Amir Yazdanbakhsh) 박사, 전산학부 박종세 교수가 참여했다.

한편 이번 연구는 한국연구재단 우수신진연구자지원사업, 정보통신기획평가원(IITP), 대학ICT연구센터(ITRC), 인공지능대학원지원사업, 인공지능반도체대학원지원사업의 지원을 받아 수행됐다.

2024.08.01 조회수 6746

로봇 등 온디바이스 인공지능 실현 가능

자율주행차, 로봇 등 온디바이스 자율 시스템 환경에서 클라우드의 원격 컴퓨팅 자원 없이 기기 자체에 내장된 인공지능 칩을 활용한 온디바이스 자원만으로 적응형 AI를 실현하는 기술이 개발됐다.

우리 대학 전산학부 박종세 교수 연구팀이 지난 6월 29일부터 7월 3일까지 아르헨티나 부에노스아이레스에서 열린 ‘2024 국제 컴퓨터구조 심포지엄(International Symposium on Computer Architecture, ISCA 2024)’에서 최우수 연구 기록물상(Distinguished Artifact Award)을 수상했다고 1일 밝혔다.

* 논문명: 자율 시스템의 비디오 분석을 위한 연속학습 가속화 기법(DaCapo: Accelerating Continuous Learning in Autonomous Systems for Video Analytics)

국제 컴퓨터 구조 심포지움(ISCA)은 컴퓨터 아키텍처 분야에서 최고 권위를 자랑하는 국제 학회로 올해는 423편의 논문이 제출됐으며 그중 83편 만이 채택됐다. (채택률 19.6%). 최우수 연구 기록물 상은 학회에서 주어지는 특별한 상 중 하나로, 제출 논문 중 연구 기록물의 혁신성, 활용 가능성, 영향력을 고려해 선정된다.

이번 수상 연구는 적응형 AI의 기반 기술인 ‘연속 학습’ 가속을 위한 NPU(신경망처리장치) 구조 및 온디바이스 소프트웨어 시스템을 최초 개발한 점, 향후 온디바이스 AI 시스템 연구의 지속적인 발전을 위해 오픈소스로 공개한 코드, 데이터 등의 완성도 측면에서 높은 평가를 받았다.

연구 결과는 소프트웨어 중심 자동차(SDV; Software-Defined Vehicles), 소프트웨어 중심 로봇(SDR; Software-Defined Robots)으로 대표되는 미래 모빌리티 환경에서 온디바이스 AI 시스템을 구축하는 등 다양한 분야에 활용될 수 있을 것으로 기대된다.

상을 받은 전산학부 박종세 교수는 “이번 연구를 통해 온디바이스 자원만으로 적응형 AI를 실현할 수 있다는 것을 입증하게 되어 매우 기쁘고 이 성과는 학생들의 헌신적인 노력과 구글 및 메타 연구자들과의 긴밀한 협력 덕분이다”라며, “앞으로도 온디바이스 AI를 위한 하드웨어와 소프트웨어 연구를 지속해 나갈 것이다”라고 소감을 전했다.

이번 연구는 우리 대학 전산학부 김윤성, 오창훈, 황진우, 김원웅, 오성룡, 이유빈 학생들과 메타(Meta)의 하딕 샤르마(Hardik Sharma) 박사, 구글 딥마인드(Google Deepmind)의 아미르 야즈단바크시(Amir Yazdanbakhsh) 박사, 전산학부 박종세 교수가 참여했다.

한편 이번 연구는 한국연구재단 우수신진연구자지원사업, 정보통신기획평가원(IITP), 대학ICT연구센터(ITRC), 인공지능대학원지원사업, 인공지능반도체대학원지원사업의 지원을 받아 수행됐다.

2024.08.01 조회수 6746